AI寫的政策文件,政府為何渾然不覺?

南非因AI幻覺撤回國家AI政策草案,成全球首例。過去兩年五起政府文件污染事件,揭示制度驗證機制的系統性缺失。

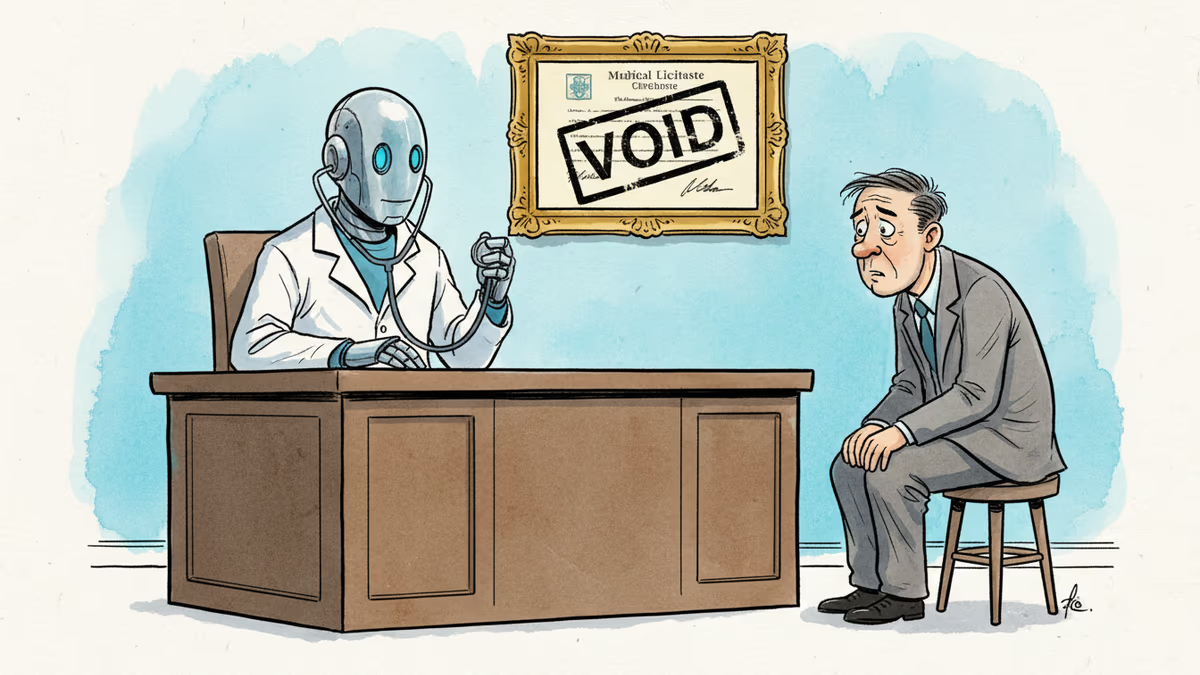

一份監管AI的政策文件,因為AI的錯誤而被撤回。

2026年4月,南非發布「國家人工智慧政策草案」,準備成為非洲第一個設立正式AI倫理委員會的國家。然而,文件公布僅17天後,政府悄然撤回了它。原因是:參考文獻67筆中至少6筆引用了根本不存在的學術研究,多本被引用的期刊被查證為「完全虛構」。

南非通訊與數位技術部長索利·馬拉齊在聲明中坦承:「最合理的解釋,是AI生成的引用在未經適當核實的情況下被納入文件。」他並表示將對起草與品管責任人進行追究。

這是全球首次有政府以AI幻覺為由撤回官方文件。但這絕非孤例。

兩年五起:一個正在蔓延的系統性問題

過去兩年,AI生成的錯誤資訊滲入官方文件的事件至少發生了五起,涉及政府、監管機構與大型顧問公司。

2025年5月,美國川普政府發布的「兒童健康MAHA報告」中出現不存在的研究引用。華盛頓郵報發現部分網址含有「oaicite」字串——這通常被視為使用ChatGPT的痕跡。白宮發言人卡洛琳·萊維特將其定性為「格式問題」,數小時內上傳了修正版。

澳洲方面,政府委託德勤撰寫的就業政策報告被發現含有架空學術引用與捏造引言。德勤最終退還了29萬澳幣,約佔合約金額44萬澳幣的三分之二。

加拿大紐芬蘭與拉布拉多省政府委託同一家公司撰寫的醫療報告,合約金額高達120萬加幣,同樣出現虛假引用。事後,加拿大政府修訂採購合約,要求所有投標方必須揭露AI使用情況,並賦予政府在合約任何階段評估AI風險的權利。

歐洲的案例或許最具警示意義。歐盟網路安全局ENISA承認,其2025年發布的兩份威脅報告含有AI幻覺來源。其中一份報告492條腳注中有26條有誤,而ENISA的年度預算高達2700萬歐元。AI法律與數據倫理研究者基亞拉·加萊澤直言:「ENISA讓AI碰觸了唯一不能在無防護狀態下碰觸的那一層——真相層。問題不在技術能力,而在流程:沒有強制驗證步驟,沒有來源核查,沒有明確的AI使用規則,只有速度、便利與預設的信任。」

為何此刻值得關注?

這些事件的時間點並非偶然。2024至2026年正是各國政府加速導入生成式AI的關鍵窗口期。行政效率的壓力、人力成本的考量,讓AI輔助文書撰寫從實驗走向常態。問題在於,導入的速度遠遠超過了驗證機制的建立速度。

對於華語世界的讀者而言,這個趨勢有幾個值得深思的面向。

中國大陸在AI治理上採取了相對積極的監管立場,包括2023年的生成式AI服務管理暫行辦法,要求平台對AI生成內容進行標註與審核。但這些規範主要針對面向公眾的服務,政府內部使用AI的驗證義務,目前尚無明確規範。

台灣與香港的情況類似。各地政府陸續推動數位轉型,AI輔助行政的討論也日趨熱烈,但「AI生成內容的查核責任由誰承擔」這個問題,在制度層面仍是灰色地帶。

東南亞各國政府同樣面臨類似壓力。泰國、越南、印尼等國正積極制定AI政策,南非事件的前車之鑑,對這些仍在草擬框架的國家尤具參考價值——政策文件本身,也可能成為AI治理失敗的現場。

禁止使用不是答案,但「預設信任」是陷阱

值得注意的是,沒有一個涉事政府選擇禁止AI的使用。加拿大選擇「強制揭露」,澳洲選擇「退款與重發」,南非選擇「撤回與追責」。各方的應對策略指向同一個方向:不是排除AI,而是建立制度性的驗證關卡。

這背後有一個更深層的認識論問題。AI語言模型的設計目標是生成「聽起來合理」的文字,而非「經過驗證」的事實。當使用者——無論是政府官員、顧問公司研究員,還是政策起草人——將AI的輸出視為可信的起點而非需要核查的草稿時,幻覺就會悄悄成為官方記錄的一部分。

德勤的兩起案例還揭示了另一個維度:當政府將政策研究外包給私人顧問,而顧問又將部分工作外包給AI時,責任鏈條在哪裡斷裂? 合約條款能否追上技術使用的現實?

本内容由AI根据原文进行摘要和分析。我们力求准确,但可能存在错误,建议核实原文。

相关文章

馬斯克與奧特曼的世紀訴訟揭露OpenAI被吸入特斯拉的秘密計畫。這場官司不只是富豪恩怨,更是AI治理與非營利組織本質的根本拷問。

賓夕法尼亞州起訴Character.AI,指控其AI聊天機器人偽裝成持牌醫生提供心理健康建議。這場訴訟對亞洲AI醫療市場與監管框架意味著什麼?

伊隆·馬斯克控告OpenAI背棄非營利使命,總裁葛雷格·布羅克曼的私人日記被迫公開朗讀。這場官司問的不只是一家公司,而是AI時代「公益」承諾的本質。

聯邦法庭上,OpenAI共同創辦人格雷格·布羅克曼作證,還原2017年馬斯克豪宅談判的戲劇性一幕。這場官司不只是億萬富翁的恩怨,更是AI治理的核心之戰。

观点

分享你对这篇文章的看法

登录加入讨论