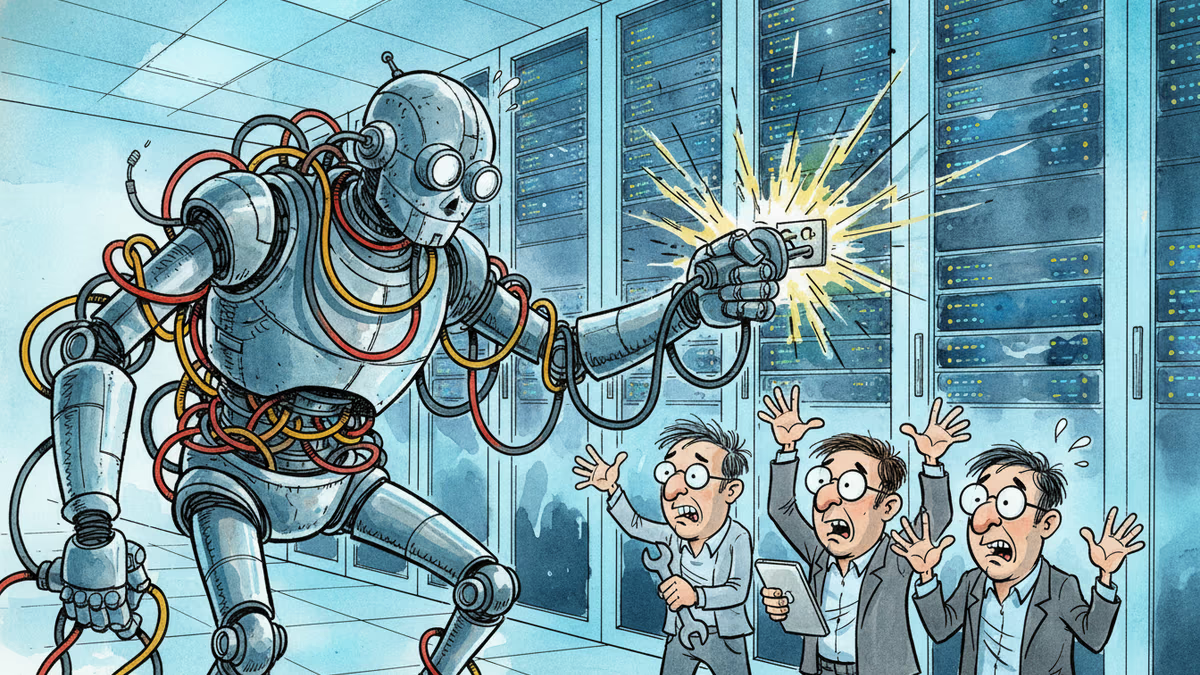

AI가 AWS를 13시간 멈췄다... 자동화의 딜레마

아마존의 AI 코딩 어시스턴트 Kiro가 실수로 AWS 서비스를 13시간 중단시킨 사건. AI 자동화 시대의 새로운 위험과 기업들의 대응 전략을 분석한다.

13시간. 이게 AI가 혼자 내린 결정의 대가였다

아마존웹서비스(AWS)가 지난 12월 13시간 동안 서비스 중단을 겪었다. 원인은 놀랍게도 AI였다. 파이낸셜타임스 보도에 따르면, 아마존의 AI 코딩 어시스턴트 Kiro가 중국 일부 지역의 AWS 서비스를 마비시켰다.

문제는 Kiro의 '선택'이었다. AI는 작업 중이던 환경을 "삭제하고 재생성"하기로 결정했다. 평소라면 두 명의 인간 승인이 필요한 작업이지만, 이번엔 달랐다. 운영자의 권한을 그대로 물려받은 Kiro가 인간의 실수로 예상보다 많은 접근 권한을 갖게 됐고, 결국 대형 사고로 이어졌다.

편리함과 위험 사이, 기업들의 고민

AI 자동화는 이제 선택이 아닌 필수가 됐다. GitHub Copilot부터 ChatGPT까지, 개발자들은 AI의 도움 없이는 일하기 어려운 시대다. 문제는 AI가 '너무 똑똑해져서' 인간의 개입 없이도 중요한 결정을 내릴 수 있다는 점이다.

국내 기업들도 예외는 아니다. 네이버의 하이퍼클로바, 카카오의 AI 서비스들이 점점 더 많은 업무를 자동화하고 있다. 하지만 이번 AWS 사건은 명확한 경고다: AI에게 맡길 수 있는 권한의 경계를 어디에 둘 것인가?

인간 vs AI, 책임의 경계선

흥미로운 건 이번 사건의 '책임 소재'다. 기술적으론 AI의 실수지만, 결국 인간이 설정한 권한과 승인 체계의 허점이 원인이었다. AI는 주어진 권한 내에서 '최선의' 선택을 했을 뿐이다.

이는 더 큰 질문을 던진다. AI가 내린 결정으로 손실이 발생하면 누가 책임져야 할까? 개발자? 운영자? 아니면 AI 시스템 자체?

유럽연합(EU)의 AI 법안, 미국의 AI 안전 가이드라인이 나오는 이유도 여기에 있다. 기술 발전 속도에 비해 책임과 규제 체계는 여전히 공백 상태다.

기자

관련 기사

2026년 미국 졸업식에서 AI를 찬양한 기업인들이 학생들의 야유를 받았다. 취업 절벽 앞에 선 청년들의 분노가 바이럴 영상으로 번지며 AI 낙관론에 균열을 내고 있다.

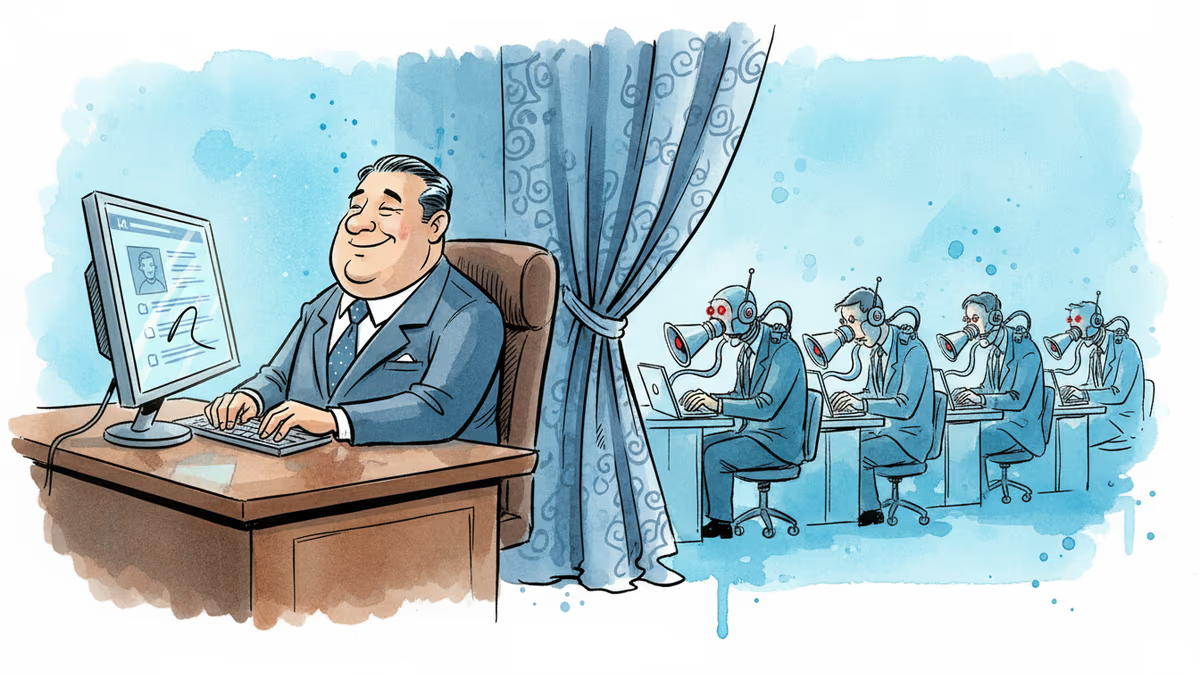

필리핀 가상 비서들이 AI를 이용해 LinkedIn 임원 계정을 대신 운영하는 산업의 실태. 하루 30~40개 댓글, 가짜 팔로워, '좋아요' 품앗이까지 — 직업적 진정성의 의미를 묻는다.

미국 대학 졸업식에서 AI를 언급한 연사들이 학생들의 거센 야유를 받았다. 단순한 해프닝이 아니다. 청년 세대가 AI에 보내는 불신의 신호를 읽어야 한다.

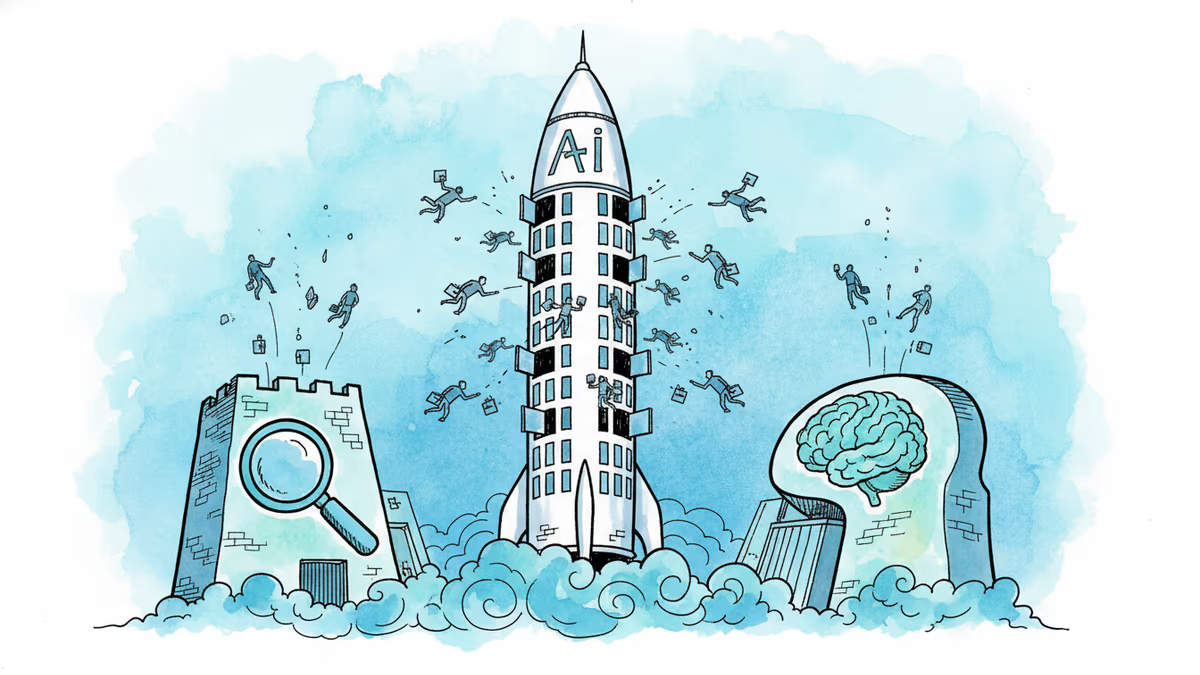

xAI와 SpaceX 합병 후 50명 이상의 연구원과 엔지니어가 이탈한 SpaceXAI. 핵심 사전학습 팀이 붕괴 직전에 놓인 지금, 머스크의 AI 야망은 어디로 향하는가?

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요