TikTok 대안 앱이 250만 명을 끌어모으고도 실패한 이유

UpScrolled가 급성장 후 혐오 발언 관리 실패로 위기에 직면. 소셜미디어 플랫폼의 콘텐츠 조절 딜레마를 분석한다.

250만 명이 몰려들었지만, 며칠 만에 '독성 플랫폼'이 됐다

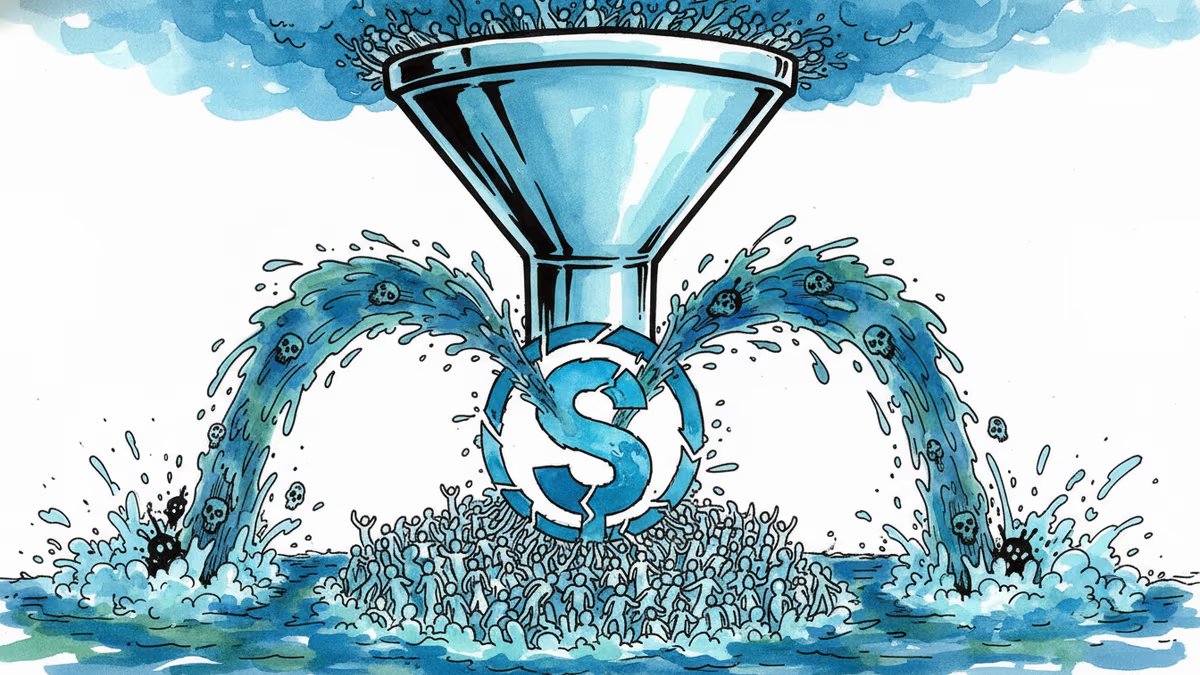

TikTok의 미국 내 소유권 변경 이후 급부상한 소셜네트워크 UpScrolled가 심각한 조절 문제에 직면했다. 1월 250만 명 이상의 사용자를 확보한 후, 인종차별적 욕설이 포함된 사용자명과 해시태그 생성을 방치하고 있다는 신고가 잇따르고 있다.

문제는 단순한 관리 소홀이 아니다. TechCrunch 조사 결과, 플랫폼 곳곳에서 인종차별 욕설, "히틀러 만세" 같은 혐오 발언, 심지어 하마스 같은 테러 조직을 찬양하는 콘텐츠까지 발견됐다. 신고 후 며칠이 지나도 해당 계정들은 여전히 활동 중이었다.

창업자의 해명: "빠르게 확장 중"

UpScrolled 창립자 이삼 히자지는 2월 10일 영상을 통해 상황을 인정했다. "우리 서비스 약관과 신념에 어긋나는 유해 콘텐츠가 업로드되고 있다"며 "콘텐츠 조절팀을 빠르게 확장하고, 기술 인프라를 업그레이드해 유해 콘텐츠를 더 효과적으로 탐지하고 제거하겠다"고 밝혔다.

2025년 창립된 이 플랫폼은 웹사이트에서 모든 목소리에 "동등한 힘"을 제공한다고 주장한다. 2025년 6월 이후 iOS와 안드로이드에서 400만 회 이상 다운로드됐다. 하지만 "의견을 검열하지 않는다"는 정책과 "혐오 발언, 괴롭힘을 제한한다"는 규정 사이에서 모순을 드러내고 있다.

소셜미디어의 영원한 딜레마

이는 소셜미디어 플랫폼이 직면하는 전형적인 문제다. 특히 단기간에 대량의 신규 사용자가 유입될 때 더욱 심각해진다. 블루스카이도 2023년 7월 계정명 내 욕설 문제로 사용자들의 이탈 위협을 받은 바 있다.

반명예훼손연맹(ADL)은 이달 블로그 포스트를 통해 UpScrolled가 "반유대주의와 극단주의 콘텐츠의 온상이 되고 있다"고 지적했다. 자유로운 표현을 추구하는 플랫폼일수록 혐오 세력의 표적이 되기 쉽다는 역설을 보여준다.

한국 플랫폼들의 교훈

국내에서도 비슷한 사례가 있었다. 익명 커뮤니티들이 급성장 후 혐오 발언과 가짜뉴스로 사회적 논란을 일으킨 경우가 많다. 네이버와 카카오 같은 기존 플랫폼들도 실시간 댓글과 오픈채팅방 관리에 수십억 원을 투자하고 있다.

문제는 기술적 해결책만으로는 부족하다는 점이다. AI 필터링 시스템도 맥락을 이해하지 못해 정당한 비판까지 차단하거나, 교묘한 혐오 표현은 놓치는 경우가 많다. 결국 사람이 직접 판단해야 하는 영역이 상당하다.

기자

관련 기사

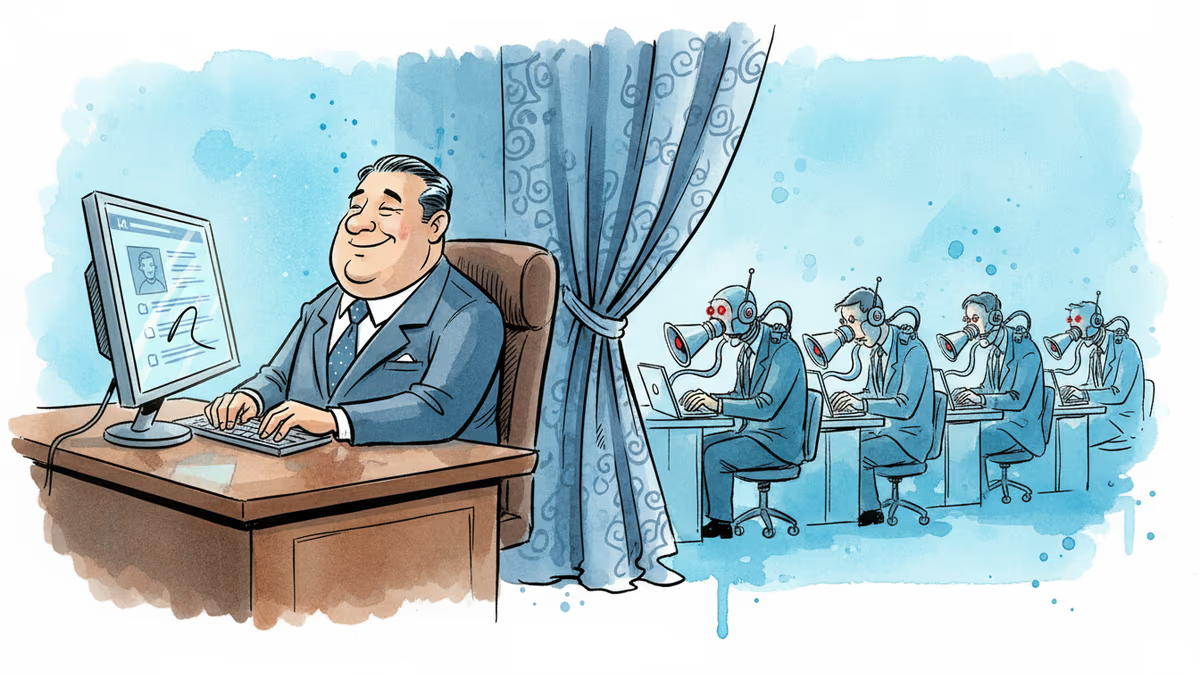

필리핀 가상 비서들이 AI를 이용해 LinkedIn 임원 계정을 대신 운영하는 산업의 실태. 하루 30~40개 댓글, 가짜 팔로워, '좋아요' 품앗이까지 — 직업적 진정성의 의미를 묻는다.

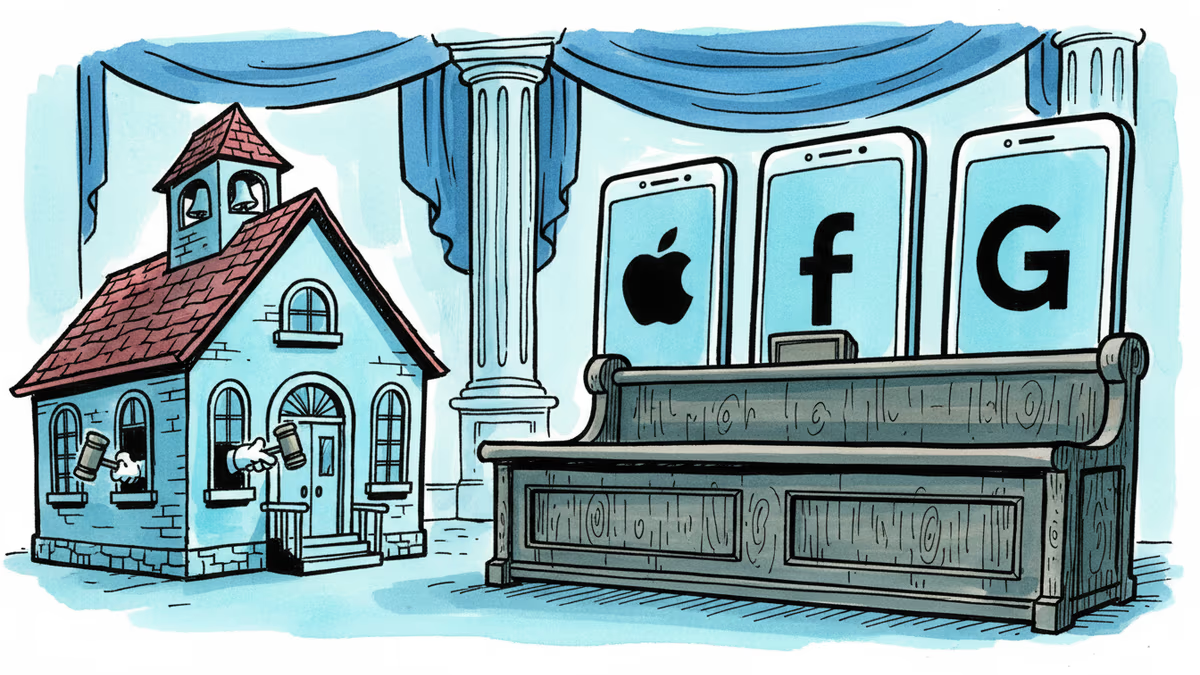

스냅·유튜브·틱톡이 미국 학교 측 소송에서 합의했다. 메타는 아직 재판 중. 1,000건 이상의 유사 소송을 앞둔 분수령 판결이 될 수 있다.

앤드루·트리스탄 테이트 형제가 익명 비판자들의 신원 공개를 요구하며 X(트위터)를 상대로 소송을 제기했다. 플랫폼 익명성과 표현의 자유를 둘러싼 법적 공방의 의미를 짚는다.

뉴멕시코 검찰총장이 메타로부터 3억 7500만 달러를 받아냈다. 하지만 진짜 싸움은 돈이 아니다. 법원이 페이스북과 인스타그램의 설계 자체를 바꾸도록 명령할 수 있는가—그 3주간의 재판이 시작됐다.

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요