AI 군사화 갈등, 실리콘밸리가 펜타곤에 맞서는 이유

Anthropic과 미 국방부 간 AI 활용 규제를 둘러싼 갈등. 자율무기와 대량감시 거부하는 기업 vs 무제한 활용 원하는 군부. 누가 AI를 통제해야 하나?

금요일 오후 5시 1분이 운명의 순간이다

Anthropic이 미 국방부의 최후통첩에 응답해야 하는 시간. 응하지 않으면 '공급망 위험 기업' 낙인과 함께 정부 사업에서 영구 퇴출될 수 있다. 하지만 CEO 다리오 아모데이는 목요일 공개적으로 물러서지 않겠다고 선언했다.

이 갈등의 핵심은 단순하다. 누가 AI를 통제하느냐. 만드는 기업인가, 사용하는 정부인가.

실리콘밸리의 새로운 저항

Anthropic의 입장은 명확하다. 자사 AI 모델이 두 가지 용도로 사용되는 것을 거부한다:

- 미국 시민에 대한 대량 감시

- 인간 개입 없는 완전 자율 무기

전통적으로 방산업체들은 자신들이 만든 무기가 어떻게 쓰이든 신경 쓰지 않았다. 하지만 AI 기업들은 다르다고 주장한다. "AI 기술은 독특한 위험을 가지고 있어 독특한 안전장치가 필요하다"는 것이 Anthropic의 논리다.

실제로 현재 AI는 치명적 결정을 내리기엔 너무 불완전하다. 잘못된 목표 식별, 인간 승인 없는 분쟁 확산, 되돌릴 수 없는 순간적 살상 결정. 덜 발달한 AI에게 무기를 맡기면 "매우 빠르고, 매우 확신에 차 있지만, 중요한 판단은 서투른 기계"를 얻게 된다.

감시 분야도 마찬가지다. 현행 미국 법으로도 시민 감시는 가능하지만, AI는 자동화된 대규모 패턴 탐지, 데이터셋 간 개체 식별, 예측적 위험 점수 산정, 지속적 행동 분석을 가능하게 해 감시의 차원을 완전히 바꿔놓는다.

펜타곤의 반박: "기업이 군사작전을 좌우하나"

국방장관 피트 헤그세스의 논리는 정반대다. "국방부는 벤더의 규칙에 제한받아선 안 된다. 합법적 사용이라면 모든 것이 허용되어야 한다."

국방부 대변인 숀 파넬은 목요일 X에서 "우리는 Anthropic이 모든 합법적 목적으로 모델을 사용하도록 허용해달라고 요청하고 있다"며 "이는 단순하고 상식적인 요청으로, Anthropic이 중요한 군사작전을 위험에 빠뜨리고 잠재적으로 우리 전투원을 위험에 빠뜨리는 것을 방지할 것"이라고 강조했다.

흥미롭게도 헤그세스의 우려는 때때로 문화적 불만과 연결되어 보인다. 1월 SpaceX와 xAI 사무실에서 한 연설에서 그는 "깨어있는 AI"를 맹비난했다. "국방부 AI는 깨어있지 않을 것이다. 우리는 아이비리그 교수 라운지용 챗봇이 아닌, 전쟁 준비가 된 무기와 시스템을 구축하고 있다."

양쪽 모두 물러설 수 없는 이유

방산 전문 벤처캐피털리스트 사친 세스는 Anthropic에게 공급망 위험 낙인이 찍히면 "불이 꺼질 수" 있다고 경고했다. 하지만 역설적으로, Anthropic을 잃는 것도 국가안보 문제가 될 수 있다.

"(국방부는) OpenAI나 xAI가 따라잡을 때까지 6-12개월을 기다려야 할 것이다. 이는 최고가 아닌 2위나 3위 모델로 작업해야 하는 1년의 공백을 남긴다."

일론 머스크가 소유한 xAI는 분류 정보 처리 준비를 갖춰 Anthropic을 대체할 태세를 갖추고 있다. 머스크의 발언을 고려하면, 이 회사는 국방부에 기술에 대한 완전한 통제권을 주는 데 문제가 없을 것으로 보인다.

최근 보고서에 따르면 OpenAI도 Anthropic과 같은 선을 긋고 있을 가능성이 높다.

기자

관련 기사

2026년 미국 졸업식에서 AI를 찬양한 기업인들이 학생들의 야유를 받았다. 취업 절벽 앞에 선 청년들의 분노가 바이럴 영상으로 번지며 AI 낙관론에 균열을 내고 있다.

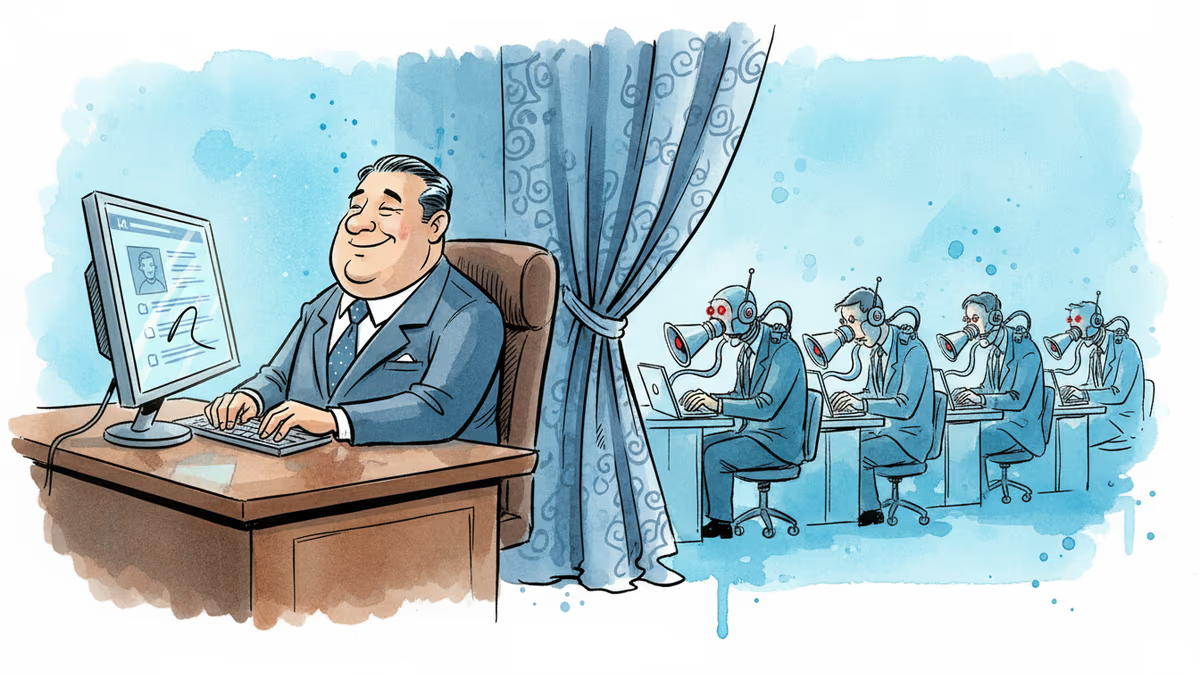

필리핀 가상 비서들이 AI를 이용해 LinkedIn 임원 계정을 대신 운영하는 산업의 실태. 하루 30~40개 댓글, 가짜 팔로워, '좋아요' 품앗이까지 — 직업적 진정성의 의미를 묻는다.

미국 대학 졸업식에서 AI를 언급한 연사들이 학생들의 거센 야유를 받았다. 단순한 해프닝이 아니다. 청년 세대가 AI에 보내는 불신의 신호를 읽어야 한다.

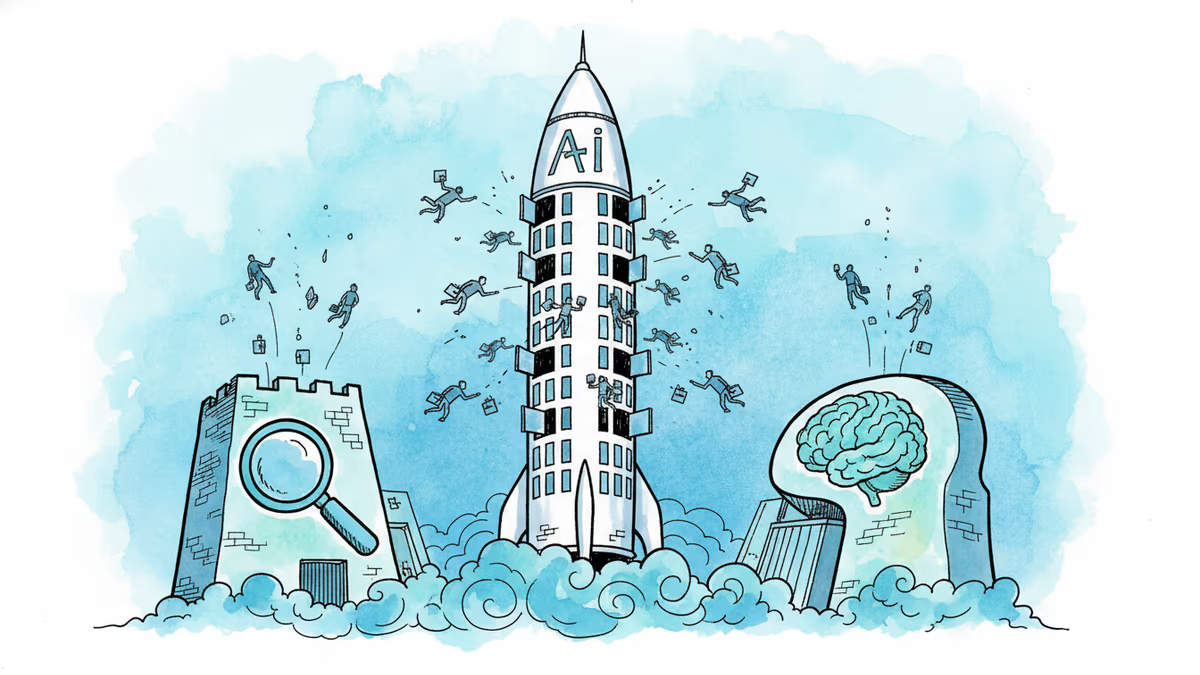

xAI와 SpaceX 합병 후 50명 이상의 연구원과 엔지니어가 이탈한 SpaceXAI. 핵심 사전학습 팀이 붕괴 직전에 놓인 지금, 머스크의 AI 야망은 어디로 향하는가?

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요