샘 올트먼의 장밋빛 미래, 우리는 믿어야 할까?

OpenAI CEO 샘 올트먼은 AI가 순수한 이익만 가져온다고 말한다. 그의 블로그 포스트 '부드러운 특이점'이 60만 명에게 읽혔다. 하지만 낙관론에는 항상 가려진 것이 있다.

세상에서 가장 강력한 AI 기업의 CEO가 '단점은 없다'고 말한다면, 당신은 어떤 표정을 지을 것인가?

OpenAI의 CEO 샘 올트먼은 지난해 "A Gentle Singularity(부드러운 특이점)"라는 제목의 블로그 포스트를 게재했다. 이 글은 약 60만 명이 읽었다. 내용의 핵심은 단순하다. AI는 지금까지 좋았고, 앞으로는 더 좋아질 것이다. 부작용? 사람들은 금방 적응하니까 걱정 없다.

로봇이 로봇을 만드는 세상

올트먼의 비전은 구체적이다. 그는 최초 100만 대의 휴머노이드 로봇을 '구식 방법'으로 만들면, 이후 그 로봇들이 스스로 공급망 전체를 운영할 수 있다고 주장한다. 광물 채굴, 트럭 운전, 공장 가동, 반도체 공장과 데이터센터 건설까지. 로봇이 로봇을 만들고, 그 로봇이 또 다른 로봇을 만드는 '자기강화 루프'가 작동하면 진보의 속도는 지금과는 차원이 다를 것이라는 논리다.

이 비전이 황당하게 들리지 않는 이유가 있다. 테슬라는 이미 옵티머스 로봇을 자사 공장에 투입했고, 피규어 AI, 보스턴 다이나믹스 등도 휴머노이드 로봇 개발에 수천억 원을 쏟아붓고 있다. 올트먼의 상상이 완전히 허황된 것은 아니다.

그러나 문제는 그 다음이다. 올트먼은 이 모든 과정에서 '진짜 단점은 없다'고 말한다. 사람들은 변화에 적응하는 존재이기 때문이라는 것이다.

'적응'은 해결책이 아니다

여기서 잠깐 멈춰야 한다. 인류가 변화에 적응해온 것은 사실이다. 산업혁명 당시 직물 공장에서 일자리를 잃은 노동자들도 결국 다른 일을 찾았다. 하지만 그 '적응'의 과정에는 수십 년의 시간과 엄청난 사회적 고통이 뒤따랐다. 차티스트 운동, 아동 노동, 도시 빈민가. 역사책에는 '결국 잘 됐다'고 쓰여 있지만, 그 과정을 살아낸 사람들에게 그 시간은 '적응'이 아니라 생존이었다.

올트먼의 낙관론이 불편한 이유는 그것이 거짓이어서가 아니다. 절반만 사실이기 때문이다. 장기적으로 기술이 풍요를 가져올 수 있다는 주장과, 그 전환 과정에서 특정 집단이 불균형하게 피해를 입는다는 사실은 동시에 참일 수 있다.

한국의 맥락에서 보면 이 문제는 더욱 선명해진다. 삼성전자, 현대자동차, LG와 같은 제조업 기반 대기업들은 이미 자동화 투자를 확대하고 있다. 현대차 울산 공장의 생산직 노동자, 삼성 반도체 라인의 기술직 직원들이 '로봇이 로봇을 만드는 시대'에 어떤 위치에 서게 될지, 올트먼의 블로그 포스트는 답하지 않는다.

CEO의 낙관론, 어디까지 신뢰할 수 있나

올트먼의 발언을 어떻게 읽어야 할까. 크게 세 가지 시각이 있다.

첫째, 진심 어린 믿음이라는 시각. 그는 실제로 AI가 인류에게 순이익을 가져다줄 것이라고 믿는 기술 낙관론자일 수 있다. 실리콘밸리에는 이런 믿음을 가진 사람들이 많다.

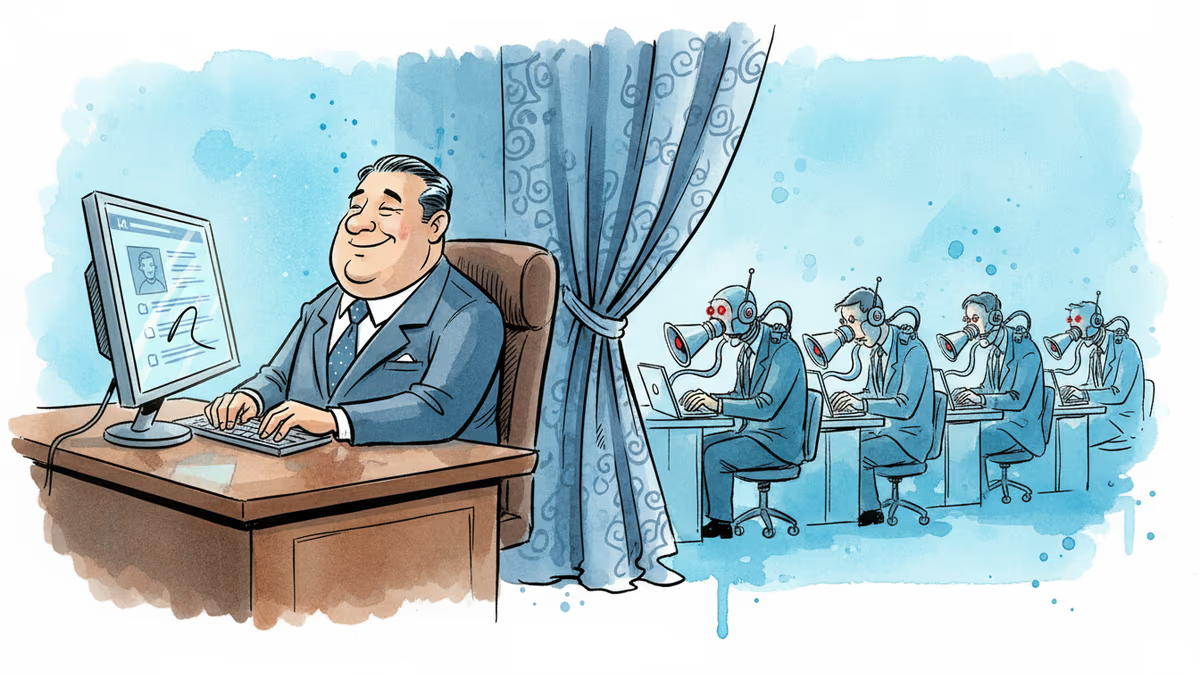

둘째, 전략적 내러티브라는 시각. OpenAI는 현재 수조 원 규모의 투자를 유치하고 있고, 각국 정부의 규제 압박을 받고 있다. '모든 것이 잘 될 것'이라는 메시지는 투자자를 안심시키고 규제 논의를 유리하게 이끄는 효과가 있다.

셋째, 두 가지가 동시에 작동한다는 시각. 믿음과 이해관계가 일치할 때, 그 믿음은 더욱 강해지고 더욱 설득력 있게 전달된다. 올트먼이 거짓말을 하고 있다고 볼 필요는 없다. 다만 그가 보고 싶은 것만 보고 있을 가능성은 충분히 있다.

기자

관련 기사

2026년 미국 졸업식에서 AI를 찬양한 기업인들이 학생들의 야유를 받았다. 취업 절벽 앞에 선 청년들의 분노가 바이럴 영상으로 번지며 AI 낙관론에 균열을 내고 있다.

머스크 대 올트먼 재판이 공소시효 만료로 끝났다. 하지만 한 달간의 법정 공방이 드러낸 건 소송 결과가 아니라 AI 업계 최상층의 민낯이었다.

필리핀 가상 비서들이 AI를 이용해 LinkedIn 임원 계정을 대신 운영하는 산업의 실태. 하루 30~40개 댓글, 가짜 팔로워, '좋아요' 품앗이까지 — 직업적 진정성의 의미를 묻는다.

미국 대학 졸업식에서 AI를 언급한 연사들이 학생들의 거센 야유를 받았다. 단순한 해프닝이 아니다. 청년 세대가 AI에 보내는 불신의 신호를 읽어야 한다.

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요