중국 AI 기업들이 훔친 건 코드가 아니라 지식이었다

Anthropic이 DeepSeek 등 중국 AI 기업 3곳의 모델 증류 의혹을 공개했다. 2만4천개 가짜 계정으로 1600만번 대화한 이유는?

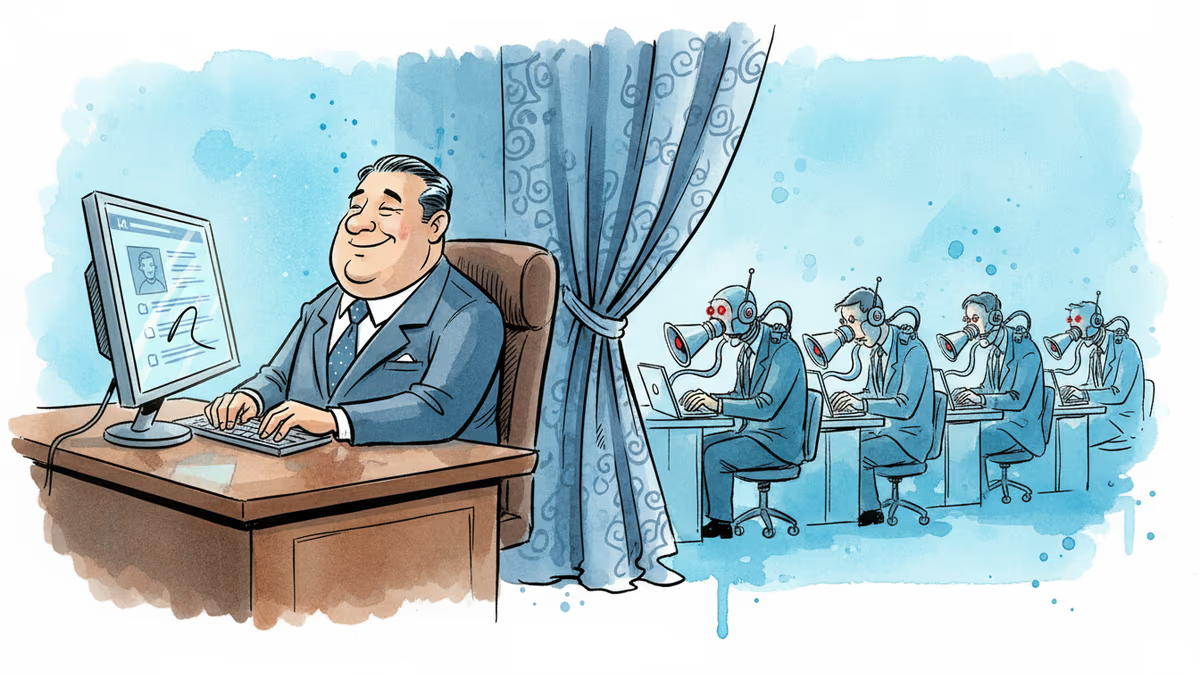

2만4천개 가짜 계정의 정체

Anthropic이 폭탄선언을 했다. 중국 AI 기업 3곳이 2만4천개의 가짜 계정을 만들어 자사 AI 모델 Claude와 1600만번 대화를 나눴다는 것이다. 단순한 해킹이 아니다. 이들이 노린 건 코드가 아니라 Claude의 '지식' 그 자체였다.

문제가 된 기업은 DeepSeek, MiniMax, Moonshot 세 곳. 이들은 '모델 증류(distillation)'라는 기법을 사용했다. 큰 AI 모델과 대화하며 그 응답 패턴을 학습해 자신들의 작은 모델을 똑똑하게 만드는 방식이다.

Anthropic은 "모델 증류 자체는 합법적인 훈련 방법"이라면서도 "불법적 목적으로도 사용될 수 있다"고 선을 그었다. 핵심은 '규모'다. 개인이 몇 번 질문하는 것과 산업적 규모로 시스템을 속이는 건 차원이 다르다.

왜 지금 공개했을까

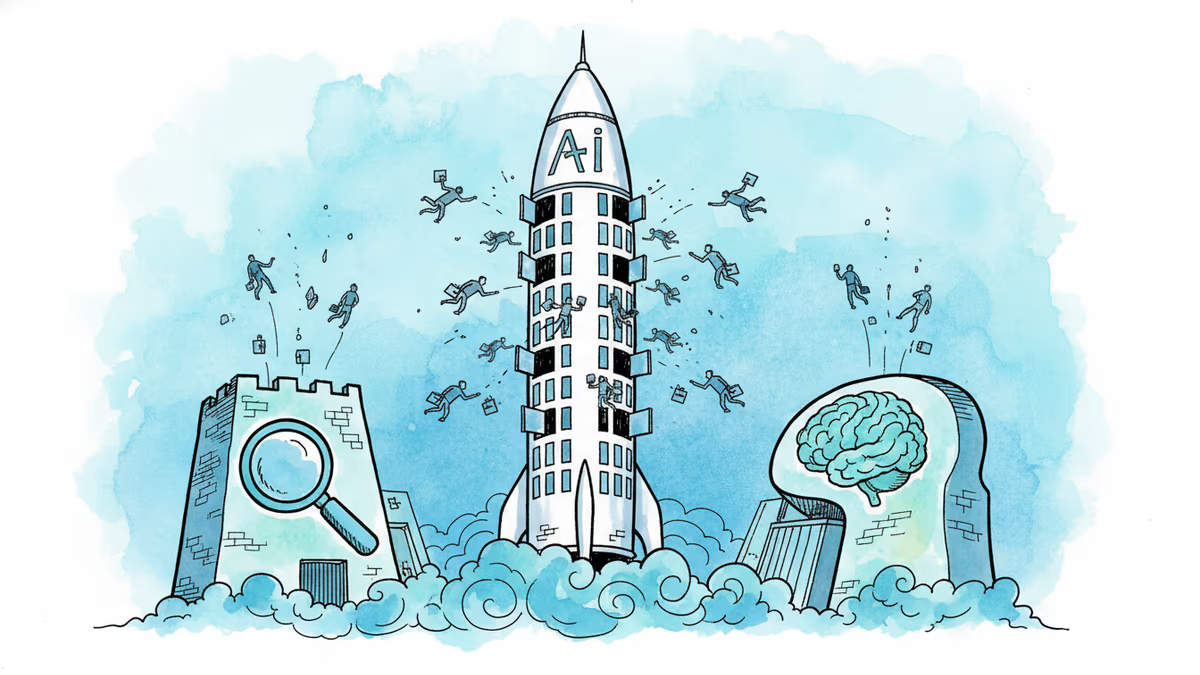

흥미로운 건 타이밍이다. 최근 DeepSeek의 R1 모델이 실리콘밸리를 발칵 뒤집어놨다. "중국이 어떻게 이렇게 빠르게 발전했을까"라는 의문에 Anthropic이 답을 제시한 셈이다.

하지만 단순한 '고발'로 보기엔 복잡하다. AI 업계에서 모델 증류는 공공연한 비밀이다. 구글도 자사 대형 모델로 작은 모델을 훈련시킨다. 문제는 '남의 모델'을 몰래 사용했다는 점이다.

중국 기업들 입장에서는 억울할 수도 있다. 서구 기업들이 중국산 데이터로 모델을 훈련시킬 때는 문제없다가, 반대 상황에서는 '도둑질'이라고 하니 말이다.

한국 AI 생태계에 던지는 메시지

이 사건이 한국에 주는 시사점은 명확하다. 네이버나 카카오 같은 국내 기업들도 글로벌 AI 모델을 참고해 자체 모델을 개발하고 있다. 어디까지가 '학습'이고 어디서부터가 '도용'일까?

국내 AI 스타트업들은 더욱 조심스러운 상황이다. 자금 부족으로 직접 대규모 모델을 훈련시키기 어려운 상황에서, 해외 모델을 활용한 증류는 거의 필수적 선택이었다. 이제는 법적 리스크까지 고려해야 한다.

정부 차원에서도 고민이 깊어질 것이다. AI 주권을 위해서는 자체 모델 개발이 필요하지만, 글로벌 기술 격차를 빠르게 따라잡으려면 기존 모델 활용이 불가피하다. 이 딜레마를 어떻게 해결할 것인가.

기자

관련 기사

2026년 미국 졸업식에서 AI를 찬양한 기업인들이 학생들의 야유를 받았다. 취업 절벽 앞에 선 청년들의 분노가 바이럴 영상으로 번지며 AI 낙관론에 균열을 내고 있다.

필리핀 가상 비서들이 AI를 이용해 LinkedIn 임원 계정을 대신 운영하는 산업의 실태. 하루 30~40개 댓글, 가짜 팔로워, '좋아요' 품앗이까지 — 직업적 진정성의 의미를 묻는다.

미국 대학 졸업식에서 AI를 언급한 연사들이 학생들의 거센 야유를 받았다. 단순한 해프닝이 아니다. 청년 세대가 AI에 보내는 불신의 신호를 읽어야 한다.

xAI와 SpaceX 합병 후 50명 이상의 연구원과 엔지니어가 이탈한 SpaceXAI. 핵심 사전학습 팀이 붕괴 직전에 놓인 지금, 머스크의 AI 야망은 어디로 향하는가?

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요