五角大廈要用機密數據訓練AI:這條線一旦跨過,回得來嗎?

美國國防部正計劃在機密環境中訓練OpenAI、xAI等公司的AI模型。機密情報將嵌入模型本身,帶來前所未有的安全風險,也引發地緣政治層面的深遠影響。

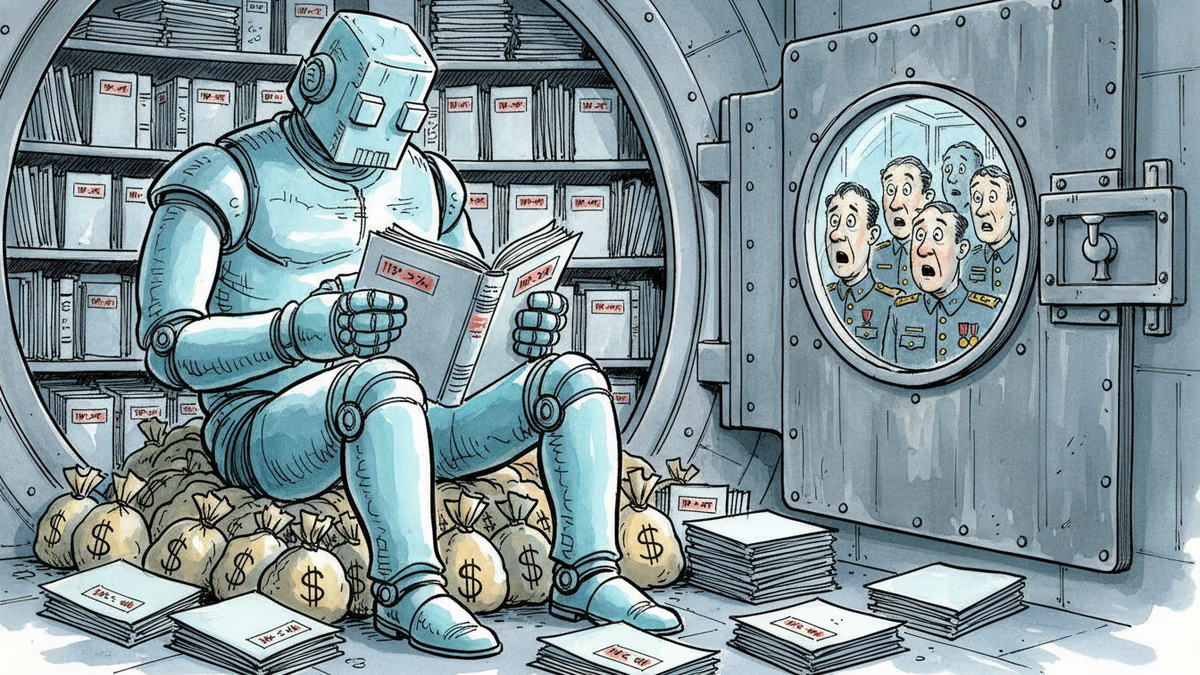

想像一下:一個AI模型,它的「記憶」裡藏著特工的名字、伊朗目標的座標、盟國情報機構共享的機密評估報告。這不是科幻小說的情節——這是五角大廈正在認真討論的計劃。

據MIT科技評論報導,美國國防部正與OpenAI、伊隆·馬斯克旗下的xAI等生成式AI公司討論,在安全環境中用機密數據直接訓練軍事專用AI模型。這意味著,機密情報將不再只是AI「查閱」的資料,而是被「學進去」、成為模型本身知識結構的一部分。

這條線,一旦跨過,性質就變了。

發生了什麼

目前,Anthropic的Claude等商用AI模型已在機密環境中用於問答任務,包括分析伊朗目標。但這些模型只是在安全環境裡「使用」機密數據,而非從中「學習」。兩者的差別,在技術上看似細微,在安全層面卻是根本性的不同。

根據兩位熟悉相關操作的人士透露,訓練將在獲得政府機密項目認證的安全數據中心進行。數據所有權歸國防部,但持有適當安全許可的AI公司人員,在極少數情況下可能接觸到這些數據。

計劃尚處討論階段。五角大廈表示,會先評估模型在非機密數據(如商業衛星圖像)上的訓練效果,再決定是否推進機密數據訓練。

推動這一切的背景,是國防部長皮特·赫格塞斯今年1月發出的備忘錄,要求軍方成為「以AI為先的作戰力量」。目前,生成式AI已被用於排列打擊目標優先順序、起草合同與報告等任務。

真正的風險在哪裡

戰略與國際研究中心(CSIS)瓦德瓦尼AI中心主任阿洛克·梅塔(曾任Google與OpenAI AI政策主管)直接點出了核心風險:機密信息一旦被模型「學進去」,就可能被任何使用該模型的人「問出來」。

他舉例說:「想像一個模型接觸過某種敏感人力情報——比如某個特工的名字——它可能將這個信息洩露給國防部內部本不應獲得該信息的部門。」這種橫向洩漏,在人員管理體系中尚可通過職級與許可控制,但在一個被多個部門共用的AI模型中,幾乎無法做到完美隔離。

相對而言,梅塔認為防止數據流回AI公司或泄露到公開互聯網的風險是可控的——安全巨頭Palantir已為此建立了相當成熟的隔離環境。真正棘手的,是軍方內部不同密級部門之間的信息邊界。

從華人世界的視角看這件事

這個消息,在中文語境下有幾層值得細讀的意涵。

第一層:這是中美AI軍備競賽的一個切面。 北京長期以來將軍民融合作為國家戰略,解放軍與科技企業之間的數據共享機制遠比西方更為緊密——至少在制度設計上如此。美國此次的動作,某種程度上是在向中國模式靠攏:讓頂尖商業AI公司深度介入國家安全體系。這對雙方的技術競爭格局意味著什麼,值得持續觀察。

第二層:台灣與地區安全的直接關聯。 報導提到,目前AI已被用於分析伊朗目標。但五角大廈的AI能力建設,顯然不只針對中東。在台海局勢持續緊張的背景下,美軍AI系統的能力提升,直接影響地區戰略平衡的感知與現實。

第三層:對科技供應鏈的潛在影響。 當美國開始在機密環境中深度整合本土AI公司,對非美國科技企業(包括台灣、日本、韓國的硬體供應商)的安全審查壓力可能進一步升高。誰的晶片在跑這些機密AI模型?誰的雲端基礎設施支撐這些安全數據中心?這些問題的答案,將重塑科技供應鏈的政治地理。

一個沒有答案的問題

梅塔坦承,很難說清楚哪些具體軍事任務需要機密數據訓練,「因為國防部顯然有強烈動機保密,不想讓其他國家知道我們在這個領域究竟擁有什麼能力。」

這句話本身,就是這個時代的縮影:最重要的技術決策,正在最不透明的地方發生。

被訓練過機密數據的AI模型,退役後「知道」的東西去哪了?不同密級的使用者之間的邊界,能真正守住嗎?當AI公司的工程師持有安全許可、接觸機密環境,商業利益與國家安全之間的防火牆,又由誰來維護?

這些問題,目前沒有人給出令人信服的答案。

相关文章

馬斯克與奧特曼的法庭訴訟正式開庭,OpenAI創立初期的內部郵件、文件逐一曝光。誰真正塑造了這家改變世界的AI公司?背後的權力博弈揭示了什麼?

美國防部與Nvidia、Microsoft、AWS等科技巨頭簽署AI軍事部署協議,超過130萬名軍事人員已使用AI平台。軍事AI的倫理邊界與地緣政治影響引發廣泛關注。

伊隆·馬斯克在法庭上指控OpenAI背叛非營利使命,電郵與簡訊成為呈堂證供。這場官司不只是私人恩怨,更揭示AI產業誰說了算的深層矛盾。

特朗普政府解雇美國國家科學基金會全體監督委員,預算削減57%遭國會否決後改以行政手段推進。這對全球科研格局與中美科技競爭意味著什麼?

观点

分享你对这篇文章的看法

登录加入讨论