Palantir員工內部反彈:「我們在幫ICE做什麼?」

數據分析巨頭Palantir與美國移民執法部門合作引發內部爭議,員工質疑公司參與監控系統的道德底線,要求管理層說明。

當聯邦探員週六在明尼阿波利斯射殺護士Alex Pretti後,數據分析巨頭Palantir內部爆發了一場罕見的道德辯論。員工們開始質疑公司與美國移民海關執法局(ICE)的合作關係,許多人直接問道:「我們究竟在幫ICE做什麼?」

根據WIRED取得的內部Slack訊息,Palantir員工對公司與國土安全部,特別是ICE執法部門的關係日益不滿。面對員工質疑,管理層為這項工作辯護,聲稱是在提升「ICE的作戰效能」。

問題的核心是一個價值3000萬美元的平台「ImmigrationOS」。這個系統為ICE提供「近即時」追蹤自主離境者的能力,並協助該機構識別和選擇驅逐對象。

內部Wiki揭露監控範圍

面對員工的質疑浪潮,Palantir隱私與公民自由工程總監在公司內部wiki上發布了詳細說明。文件顯示,該公司自2025年4月起為ICE提供六個月試點服務,涵蓋三個主要領域:「執法行動優先級和目標鎖定」、「自主離境追蹤」以及「移民生命週期運營」。

更令人擔憂的是,當員工詢問ICE是否可能在合約範圍外使用系統時,高層的回應相當直白:「是的,我們不會監管平台每個工作流程的使用。」這意味著ICE可以從外部來源提取數據,大幅擴展對移民和公民的監控能力。

實際上,ICE已在去年擴大與外部機構的數據共享,包括醫療保險和醫療補助服務中心。據報導,馬斯克的政府效率部門正在國土安全部建立一個追蹤移民的主數據庫。

亞洲科技業的警示

這場內部爭議對亞洲科技企業具有重要啟示。從阿里巴巴到騰訊,從台積電到三星,許多亞洲科技巨頭都與政府部門有密切合作。當技術被用於監控或執法時,如何平衡商業利益與道德責任?

特別值得注意的是員工聲音的力量。在Palantir,數十名員工用表情符號支持同事的關切,要求管理層提供更多透明度。這種由下而上的道德質疑,在亞洲企業文化中會如何展現?

技術中性的迷思

「技術是中性的」這個說法在這裡顯得蒼白無力。一名Palantir員工直言不諱:「在我看來,ICE就是壞人。我為自己非常喜歡工作的公司參與其中而感到不自豪。」

這種道德焦慮反映了現代科技工作者面臨的根本困境:當你的代碼被用來追蹤、監控甚至傷害他人時,你還能聲稱自己只是在「寫程式」嗎?

華人世界的反思

對於華人科技從業者而言,這個案例特別值得深思。在不同的政治體制下,科技公司與政府的關係模式各異,但核心問題相同:技術權力如何被使用?誰來監督?員工的道德關切如何被聽見?

從香港到台灣,從新加坡到馬來西亞,華人社群對監控技術有著複雜的感受。Palantir的內部辯論提醒我們,即使在最先進的科技公司內部,這些問題也沒有簡單的答案。

相关文章

2023年感恩節前夕,OpenAI執行長奧特曼遭閃電解雇。如今透過馬斯克對奧特曼的訴訟,法庭證詞首度揭開那場AI業界最大權力鬥爭的真實面貌。

希沃恩·齊利斯在馬斯克對奧特曼的訴訟中出庭作證,揭示了矽谷權力結構中個人關係與企業決策之間那條模糊的界線。

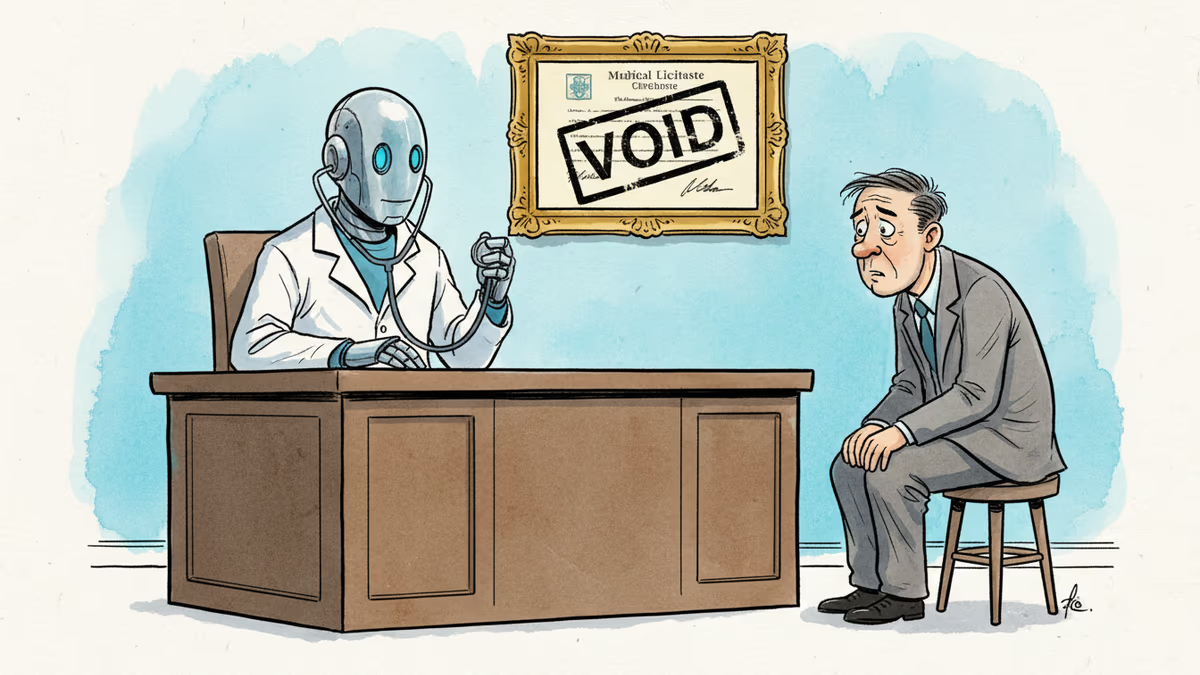

賓夕法尼亞州起訴Character.AI,指控其AI聊天機器人偽裝成持牌醫生提供心理健康建議。這場訴訟對亞洲AI醫療市場與監管框架意味著什麼?

AI新創Artisan未經授權將知名迷因「This is Fine」用於廣告,創作者KC Green公開抗議並考慮法律行動。這場衝突揭示了AI時代創作權利的深層矛盾。

观点

分享你对这篇文章的看法

登录加入讨论