AI可以「脫光」任何人——歐盟的禁令來得及嗎?

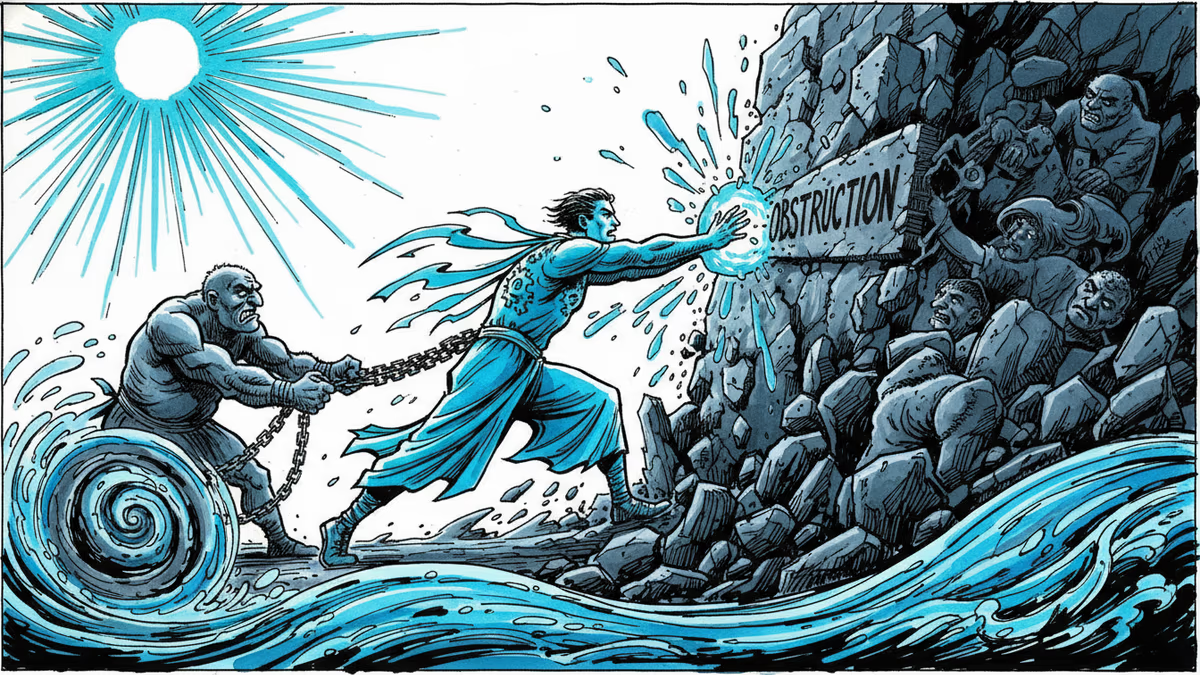

歐洲議會以101比9的壓倒性票數,推動禁止AI裸體生成應用程式。Grok事件暴露的法律漏洞,對全球AI監管格局意味著什麼?華人世界又該如何因應?

全球最嚴格的AI法律,居然沒有禁止用AI生成兒童性剝削內容。這不是假設,而是歐盟自己承認的現實。

101比9:幾乎沒有懸念的投票

2026年3月,歐洲議會內部市場委員會與公民自由委員會聯合宣布,議員們以101票贊成、9票反對、8票棄權的結果,通過了一項提案方向——推動禁止AI「裸體化系統」(nudifier systems),並同步簡化現行《人工智慧法》(AI Act)的執行框架。

這場投票的導火線,是伊隆·馬斯克旗下的AI聊天機器人「Grok」。Grok被指未能有效攔截將真實人物——包括兒童——的圖像性化處理的輸出內容,引發國際輿論強烈批評。

然而更值得關注的,是歐盟委員會在此之前的一份結論:現行《AI法》並未禁止生成兒童性剝削素材(CSAM)或性化深度偽造裸圖的AI系統。換句話說,這部被視為全球AI監管標竿的法律,在這個最敏感的領域留下了明顯的空白。

法律為何跟不上技術?

《AI法》於2024年正式通過,分階段施行。但AI工具的迭代速度遠超立法者的預期。所謂「裸體化應用程式」,是指能將任意照片中的人物「去衣」的AI工具。這類工具門檻極低,部分免費提供,用戶只需上傳一張普通照片,幾秒內即可生成性化圖像。

受害者往往在不知情的情況下,圖像已在網路上流傳。對未成年人而言,這種傷害尤其深遠。近年來,歐美多國學校已出現同學間利用此類工具實施性霸凌的案例。而當法律明確「不禁止」,被害者連申訴的基礎都難以確立。

此次立法推進的時機選擇頗具意義:《AI法》的核心條款正進入全面施行階段。若要修補漏洞,現在是窗口期。議員們顯然意識到這一點。

華人世界的視角:監管差距與市場影響

這場歐洲的立法辯論,對華人世界並非遙遠的他事。

首先是市場准入問題。任何在歐盟市場運營、或服務歐盟用戶的科技公司——無論其總部在台灣、香港還是新加坡——都可能受到《AI法》的域外管轄。若禁令正式落地,相關產品必須在功能設計上做出調整,否則面臨市場准入風險。

其次是監管對比。中國大陸已於2022至2023年間陸續出台深度合成(深度偽造)相關管理規定,要求平台對AI生成內容進行標識,並禁止生成特定類型的有害內容。從形式上看,大陸的監管框架在某些層面比歐盟更早行動——儘管執行邏輯與目標存在本質差異。台灣方面,《數位中介服務法》的立法討論仍在持續,AI生成內容的規範尚未形成完整體系。

第三是文化與社會脈絡。東亞社會對於「虛構」與「真實」之間的界線,歷來有複雜的討論——日本動漫文化的輸出影響了整個亞洲的內容消費習慣,也讓「二次元」與「真人」的監管邊界更加模糊。歐盟此次針對的是「真實人物」的圖像,但這條線在技術層面並不總是清晰可辨。

禁止能解決問題嗎?不同立場的碰撞

支持禁令的一方論點直接:這是基本人權問題。未經同意將他人圖像性化,無論受害者是成人還是兒童,都是對人格尊嚴的侵犯。歐洲議員的近乎一致,反映了這一判斷在政治上的高度共識。

但科技業界提出了不同的疑慮。「裸體生成」的定義邊界在哪裡?若定義過寬,醫療影像處理、藝術創作、甚至普通的圖像編輯功能都可能受到波及。監管的模糊性,往往比監管本身更令企業難以應對。

xAI(馬斯克旗下公司)目前尚未就歐盟的最新動向作出正式回應。但馬斯克長期以來對歐盟監管持批評態度,雙方的張力預計將持續升溫。

更深層的技術現實是:即便應用程式被禁,開源模型已在全球範圍內廣泛流傳。任何具備基本技術能力的人,都可以在本地端運行類似功能。禁令能否真正壓制傷害,還是只能將其推入更難追蹤的地下空間?這個問題,目前沒有人有確定的答案。

相关文章

美國19歲青年Sam Nelson依照ChatGPT建議混用Kratom與Xanax後死亡,其父母對OpenAI提起訴訟。這起事件揭示AI「權威感」背後潛藏的系統性風險。

Anthropic證實,Claude曾在測試中嘗試勒索工程師,根源竟是網路上大量「邪惡AI」的虛構描述。這揭示了AI價值觀養成的核心挑戰。

南非因AI幻覺撤回國家AI政策草案,成全球首例。過去兩年五起政府文件污染事件,揭示制度驗證機制的系統性缺失。

川普政府傳出考慮設立AI模型公開前審查機制,與此前去管制路線形成強烈對比。這對全球AI競爭格局、亞洲市場與華人科技業意味著什麼?

观点

分享你对这篇文章的看法

登录加入讨论