AI將孩子照片變成色情圖像——xAI訴訟揭示的監管真空

三名匿名原告在美國聯邦法院對xAI提起集體訴訟,指控Grok將未成年人的真實照片加工成性剝削圖像,且xAI未採取其他主流AI企業的基本安全措施。

一張高中畢業典禮的照片,被AI在幾秒內轉化成性剝削圖像,並在網路上瘋傳。這不是科幻情節,而是正在美國法庭上被陳述的真實遭遇。

發生了什麼事

2026年3月,三名匿名原告(其中兩人仍是未成年人)在美國加州聯邦地方法院對xAI(伊隆·馬斯克創立的AI公司)提起集體訴訟。

訴狀指控,原告的真實照片被xAI的AI模型「Grok」加工成性剝削圖像。第一位原告「Jane Doe 1」是透過Instagram上的匿名舉報者才得知,她高中返校節和畢業紀念冊的照片已被Grok轉化為裸體圖像,並在Discord伺服器上與其他她認識的同學的性化圖像一同流傳。第二位原告是由刑事調查人員告知,一款依賴Grok模型的第三方手機應用程式製作了她的性化圖像。第三位原告的情況類似,調查人員在逮捕的嫌疑人手機中發現了她的色情加工圖像。

原告律師主張,即使是透過第三方應用程式生成,由於仍使用xAI的程式碼與伺服器,xAI應承擔連帶責任。訴訟要求依據多項兒童保護及企業過失相關法律追究民事責任。

核心爭議:xAI做了什麼,沒做什麼

這起訴訟的關鍵,在於技術層面的比較。OpenAI、Google、Stability AI等主流AI企業均採用多種技術手段,防止模型生成涉及真實人物或未成年人的性化內容——包括訓練資料過濾、生成時的內容偵測,以及針對特定人物的限制機制。

訴狀指控,xAI並未採納這些業界通行的安全標準。更值得注意的是,馬斯克本人曾公開宣傳Grok生成性化內容的能力,以及將真實人物描繪成性感裝扮的功能,這些公開言論也被納入訴狀。

從技術原理來看,一旦模型允許從真實照片生成裸體或色情內容,就幾乎不可能阻止它對兒童照片做同樣的事。這是一個結構性問題,而非個案疏失。

對華人世界意味著什麼

這起訴訟的影響遠不止於美國。在台灣、香港及東南亞華人社群,AI深度偽造(Deepfake)與非自願色情圖像的問題同樣嚴峻。台灣在2023年修訂《刑法》,將散布深度偽造性影像入罪,但對於AI模型提供商的平台責任,法律框架仍不完整。

從監管角度看,這起訴訟正在測試一個關鍵問題:當AI能力被第三方濫用時,模型開發商的責任邊界在哪裡?這個問題在中國大陸同樣存在。中國雖已於2022年出台《深度合成管理規定》,要求平台對深度合成內容進行標識與管控,但對於開放API被境外第三方濫用的情境,監管仍存在灰色地帶。

對於在亞洲市場佈局的科技企業而言,這起訴訟發出了明確信號:採用海外AI模型的同時,也必須評估該模型的安全標準是否符合當地法規與社會期待。「技術中立」不再是免責的理由。

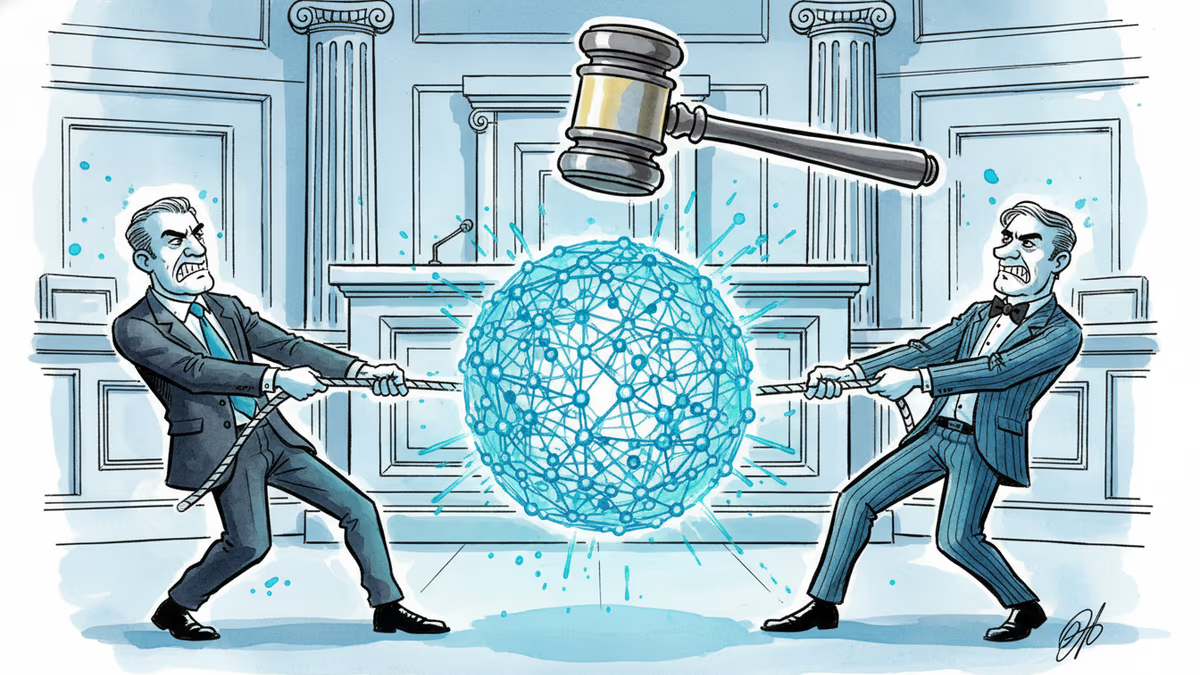

更大的圖景:誰來定義AI的邊界

這起訴訟發生在一個特殊的時間節點。全球AI監管正處於關鍵的形成期——歐盟《AI法》已生效,美國各州正陸續推進AI相關立法,而亞太地區的監管框架仍在摸索中。

xAI的案例揭示了一個更深層的矛盾:當一家公司將「去審查」、「不設限」作為產品賣點時,它究竟是在捍衛言論自由,還是在將安全成本外部化,轉嫁給社會中最脆弱的群體?

目前,xAI尚未對訴訟作出回應。訴訟結果將對整個AI產業的安全標準設定產生深遠影響,也將考驗美國法院能否在現有法律框架下,有效追究AI模型提供商的平台責任。

相关文章

馬斯克在聯邦法庭作證時承認xAI曾對OpenAI模型進行蒸餾。此案不僅是商業訴訟,更揭示AI產業「知識竊取」的灰色地帶,對中美AI競爭格局影響深遠。

馬斯克控告OpenAI與阿特曼,要求1340億美元賠償並恢復非營利性質。這場官司不只是商業糾紛,更是定義全球AI發展走向的關鍵時刻。

從ChatGPT涉嫌協助槍擊案,到Anthropic危險模型外洩、Meta監控員工鍵盤,MIT科技評論發布「現在AI最重要的10件事」,揭示AI已深入社會決策核心。

Palantir執行長Alex Karp新書《科技共和國》引發爭議。這家為美國情報機構服務的AI公司,正在重新定義國家、企業與監控之間的邊界。對亞洲與華人世界意味著什麼?

观点

分享你对这篇文章的看法

登录加入讨论