拒絕替自律武器服務,AI公司反被列為「安全威脅」

聯邦法院裁定支持Anthropic,推翻美國政府將其列為供應鏈風險的決定。一家AI公司因拒絕讓政府用其技術開發自律武器,竟遭國家打壓——這場法律戰揭示的,遠不只是一場商業糾紛。

一家AI公司說「不要用我們的技術造殺人機器」,政府的回應是:「那你就是國家安全威脅。」

2026年3月27日,加州北區聯邦法院法官麗塔·林(Rita F. Lin)頒布禁制令,命令川普政府撤銷對Anthropic的「供應鏈風險」指定,並停止要求聯邦機構與該公司切斷關係的命令。法官在庭審中直言:「這看起來像是一場蓄意癱瘓Anthropic的行動。」

事件始末:一條倫理條款引發的風暴

這場風波的導火線,是Anthropic試圖對政府使用其AI模型設定限制條件,包括禁止用於自律武器系統及大規模監控行動。這些限制並非無中生有——它們反映的是當前國際AI倫理討論中的主流共識。

然而,五角大廈拒絕接受這些條款。隨後,政府將Anthropic列為「供應鏈風險」——這個標籤通常用於外國敵對勢力,而非本國科技公司。川普總統更進一步,公開稱該公司為「激進左派的覺醒企業」,指其危害「國家安全」。Anthropic CEO 達里奧·阿莫代伊(Dario Amodei)則反指國防部的行為「具有報復性和懲罰性」,並提起訴訟。

法院最終認定,政府的命令侵犯了企業的言論自由保障,並裁定Anthropic在實質審理中勝訴的可能性較高。

為什麼這件事現在特別重要

這不只是一場企業與政府之間的法律糾紛。它觸及了一個在全球AI競賽中愈來愈迫切的核心問題:當國家利益與AI倫理發生衝突,誰說了算?

對於關注中美科技競爭的讀者來說,這個案例提供了一個耐人尋味的對照。在中國大陸,AI企業通常被要求配合國家安全需求,自主設定使用限制的空間相對有限。而在美國,一家企業竟因拒絕讓政府無限制使用其技術,反被國家機器打壓——這種張力,在民主體制內部引發的震盪,值得細細觀察。

對台灣、香港及東南亞的科技從業者與政策制定者而言,這個案例也有直接的參考價值。當企業在全球部署AI服務時,如何在不同政府的要求之間維持倫理底線,正成為一個無法迴避的商業與法律課題。

各方如何解讀這場風波

從川普政府的角度來看,AI技術是美國維持軍事優勢的關鍵資產。讓私人企業對政府的使用方式設定條件,在他們眼中是對國家主權的挑戰,尤其在與中國的戰略競爭日趨激烈的背景下。

從AI安全研究者的角度來看,Anthropic的立場恰恰代表了負責任AI開發的核心精神。若企業因設定倫理邊界而遭到懲罰,整個產業將面臨一個扭曲的激勵結構:服從比安全更有利可圖。

從投資者與市場的角度來看,這場風波揭示了一個新的商業風險:AI公司與政府客戶之間的關係,可能因政治氣候的變化而迅速惡化。這對有意進入美國政府採購市場的亞洲企業,是一個值得納入風險評估的變數。

而從更宏觀的地緣政治視角來看,美國政府將本國AI企業列為「安全威脅」的舉動,在盟友與競爭對手眼中傳遞了什麼訊號?歐盟正在推進《AI法案》,中國也在加速制定AI治理框架——這場美國內部的衝突,會如何影響全球AI規範的形成?

相关文章

川普與習近平的北京峰會前,烏克蘭停火失敗、關稅政策受挫、伊朗緊張升溫,多重因素削弱了美國的談判籌碼。分析美中權力不對稱對全球供應鏈與亞洲市場的深遠影響。

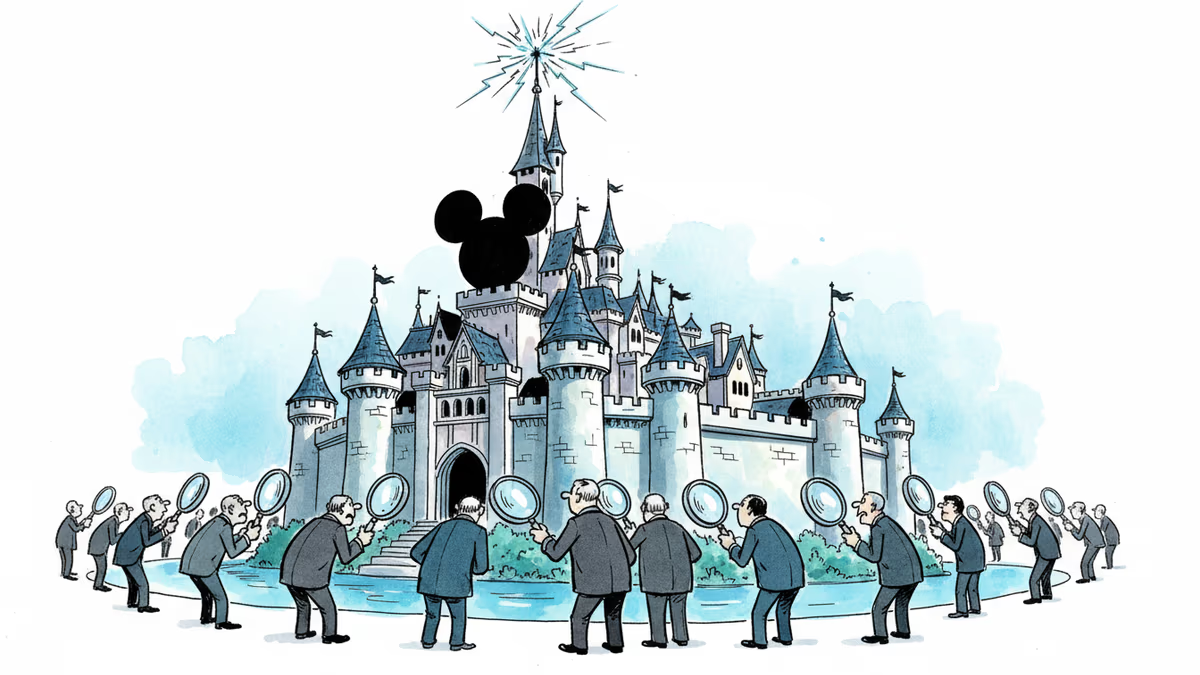

迪士尼旗下ABC指控特朗普政府透過FCC調查侵犯言論自由。新任CEO上任僅一週即陷入政治風暴,這場對決對媒體監管與亞洲市場意味著什麼?

達龍·阿塞莫格魯堅持AI對生產力的貢獻被高估。從AI零日攻擊到OpenAI內鬥,本週最值得關注的AI動態全面解析。

iOS 27將開放相機介面完全自訂,用戶可自選控制項目。這對手機攝影愛好者、亞洲市場乃至整個相機產業意味著什麼?PRISM深度解析。

观点

分享你对这篇文章的看法

登录加入讨论