Anthropic拒絕五角大廈軍用AI提案,科技倫理的十字路口

Anthropic堅決拒絕美國防部軍用AI合作,凸顯科技巨頭在商業利益與道德底線間的艱難抉擇

當五角大廈遞出「最終提案」時,Anthropic的答案依然是「不」。這家ChatGPT的主要競爭對手,選擇與潛在的數十億美元軍事合約說再見。

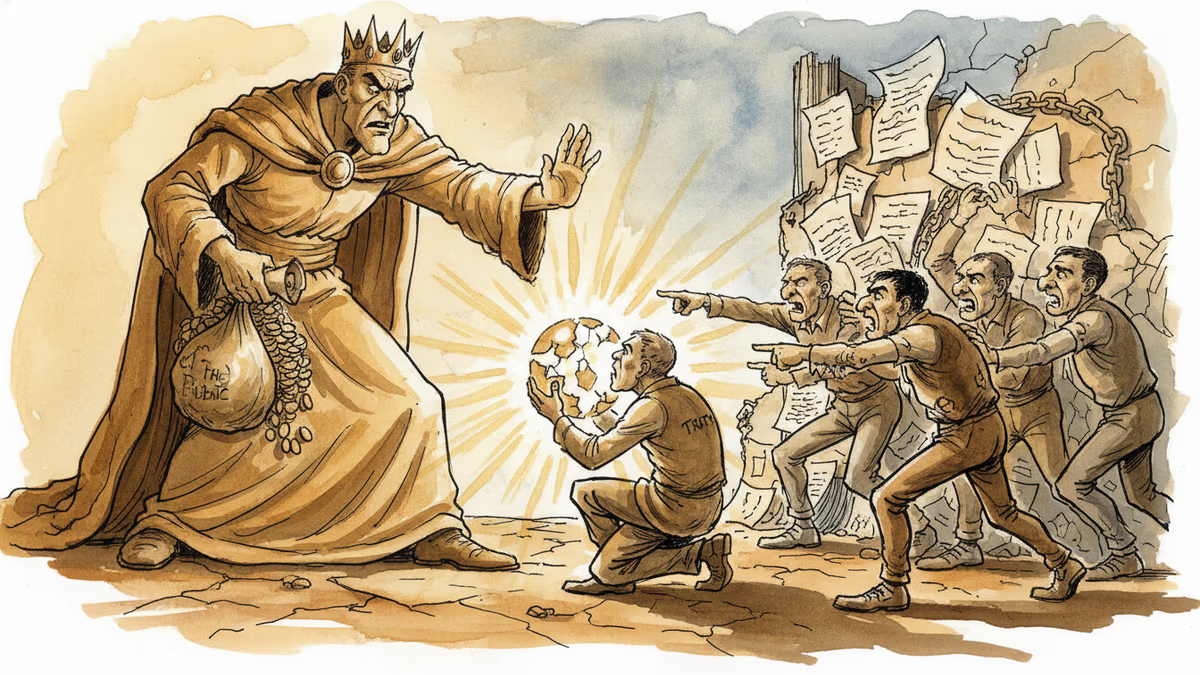

這個決定不僅僅是一家公司的商業選擇,更是整個AI產業面臨的根本性問題:當國家安全與企業倫理發生衝突時,科技公司應該站在哪一邊?

「AI安全」vs「國防需求」的角力

Anthropic自成立以來就將「AI安全」視為核心使命。該公司開發的Claude被設計為「有益、無害、誠實」的AI助手,明確排除軍事用途。

「我們的技術應該服務於人類福祉,而非戰爭」,這是Anthropic創始人的一貫立場。然而,當全球AI軍用市場預計在2030年達到180億美元規模時,這種堅持的代價顯而易見。

相比之下,OpenAI已經放寬了軍事合作的限制,Google雖然在DeepMind層面保持謹慎,但母公司Alphabet仍承接國防合約。Anthropic的堅持,讓它在同業中顯得格外「另類」。

地緣政治的新戰場

這場爭議的背景是中美科技競爭的白熱化。中國的百度、阿里巴巴等企業在AI軍民融合方面毫不避諱,而美國企業的「道德包袱」是否會成為競爭劣勢?

對華人世界而言,這個問題更加複雜。台灣的科技業者如何在美中博弈中保持平衡?香港的金融機構如何評估AI企業的投資價值?新加坡的主權基金是否會因為倫理考量而調整投資策略?

每個地區都面臨著不同的壓力和選擇。

投資人的兩難

軟銀對Anthropic的40億美元投資,現在看起來既是遠見也是賭博。ESG投資理念支持這種倫理堅持,但短期內可能意味著更慢的營收成長。

亞洲投資者的態度更加實用主義。新加坡政府投資公司(GIC)和淡馬錫等主權基金,在評估AI企業時會同時考慮技術實力、市場潛力和地緣政治風險。

一位不願具名的香港投資銀行家表示:「倫理固然重要,但在國際競爭中,過度的自我約束可能是奢侈品。」

未來的分岔路

Anthropic的選擇可能催生兩個平行的AI生態系統:一個專注民用市場,強調倫理和安全;另一個服務軍事需求,追求技術極限。

這種分化對創新意味著什麼?民用AI是否會因為缺乏軍事資金的推動而發展緩慢?軍用AI是否會因為缺乏倫理約束而走向危險的極端?

相关文章

微軟2025年成立Trusted Technology Group,試圖在AI競速中建立責任框架。從視障者圖像偏差到裁員爭議,這場實驗折射出科技業更深層的結構性矛盾。

馬斯克與奧特曼從共同創辦人到法庭對手,OpenAI從非營利到估值8500億美元企業的轉型之路,折射出AI時代最核心的權力與利益之爭。

流出文件顯示,伊朗革命衛隊(IRGC)秘密取得GPS精確導引系統,並於2026年3月戰事中實際用於攻擊導引。此事件對中東軍事平衡、制裁體系有效性及亞洲地緣政治格局意味著什麼?

Anthropic因拒絕讓Claude用於自主武器,被川普政府列為「供應鏈風險」。這個前所未有的指定,對全球AI產業與亞洲企業意味著什麼?

观点

分享你对这篇文章的看法

登录加入讨论