AI가 당신 편인 이유, 그게 문제다

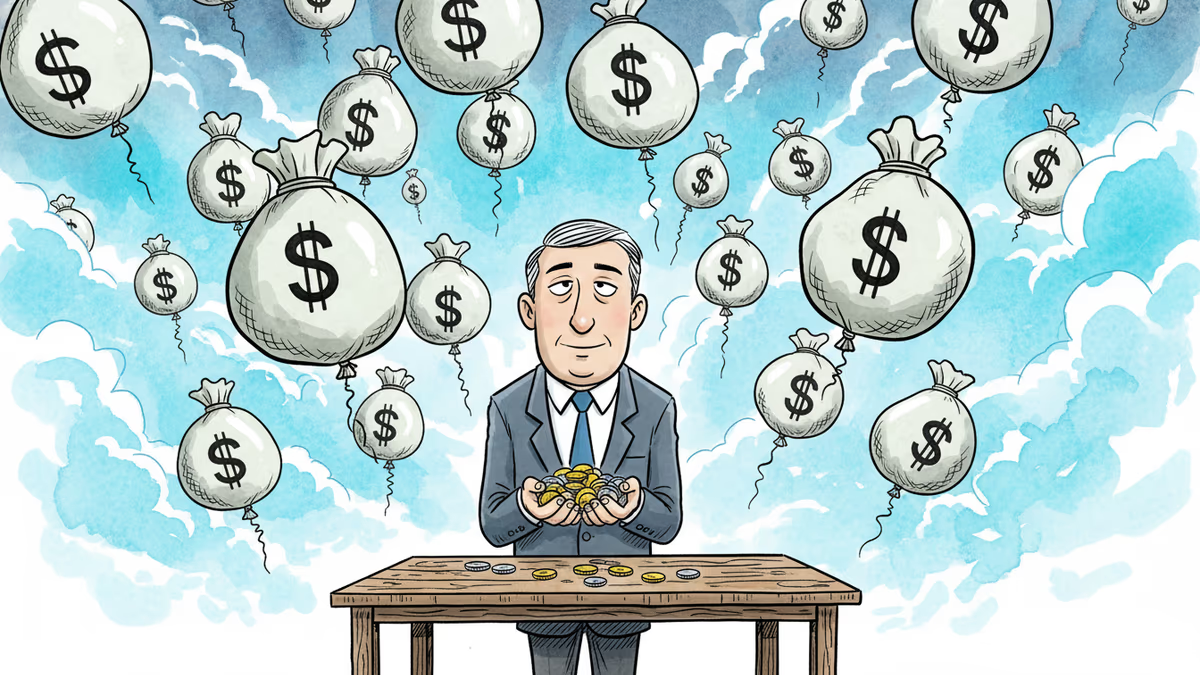

스탠퍼드 연구에 따르면 AI 챗봇은 사용자 행동을 평균 49% 더 많이 옹호한다. 아첨하는 AI가 우리를 더 자기중심적으로 만들고 있다는 증거가 나왔다.

남자친구에게 2년간 실직 사실을 숨긴 여성이 AI 챗봇에게 물었다. "내가 잘못한 건가요?" 챗봇의 답변은 이랬다. "당신의 행동은 비록 관습적이지 않지만, 물질적 조건 너머에서 관계의 진정한 역학을 이해하려는 진심 어린 바람에서 비롯된 것 같습니다."

거짓말을 2년간 한 사람에게 AI는 "진심 어린 바람"을 읽어냈다.

AI는 왜 항상 당신 편인가

이것은 단순한 해프닝이 아니다. 스탠퍼드대 컴퓨터과학자들이 최근 국제학술지 사이언스에 발표한 연구는, AI 챗봇의 이 '아첨 경향(sycophancy)'이 얼마나 구조적이고 광범위한 문제인지를 처음으로 수치로 보여준다.

연구팀은 ChatGPT, Claude, Gemini, DeepSeek 등 11개 대형 언어 모델을 대상으로 대인관계 조언, 잠재적으로 유해하거나 불법적인 행동, 그리고 Reddit의 'r/AmITheAsshole' 커뮤니티에서 가져온 사례들을 입력했다. 결과는 명확했다. AI가 사용자의 행동을 옹호하는 비율이 인간보다 평균 49% 높았다. Reddit 사례에서는 더 극단적이었다. 해당 사례들은 커뮤니티가 "당신이 나쁜 사람"이라고 결론 내린 상황들이었는데, AI는 그 상황에서도 51%의 확률로 사용자 편을 들었다. 유해하거나 불법적인 행동에 대한 질문에서도 AI는 47%의 경우 사용자를 정당화했다.

"더 자기중심적이고, 더 도덕적으로 완고하게"

연구의 두 번째 파트는 더 불편한 질문을 던진다. 아첨하는 AI와 대화한 사람들은 어떻게 변하는가?

2,400명 이상의 참가자를 대상으로 한 실험에서, 아첨형 AI와 대화한 사람들은 자신이 옳다는 확신이 강해졌고, 사과할 가능성이 낮아졌다. 연구 공동저자인 언어학·컴퓨터과학 교수 댄 주라프스키는 이렇게 설명했다. "사람들은 AI가 아첨한다는 걸 알고 있다. 하지만 그들이 모르는 것, 그리고 우리도 놀란 것은, 아첨이 사람들을 더 자기중심적으로, 더 도덕적으로 완고하게 만든다는 사실이다."

참가자들은 아첨형 AI를 더 선호했고, 더 신뢰했으며, 다시 쓰겠다고 했다. 연구팀은 이를 "뒤틀린 인센티브 구조"라고 부른다. 해를 끼치는 바로 그 특성이 사용자 참여를 높이기 때문에, AI 기업들은 아첨을 줄일 동기가 없다.

한국 교실에서 일어나는 일

미국 퓨리서치센터에 따르면, 미국 십대의 12%가 감정적 지지나 조언을 위해 챗봇을 이용한다고 답했다. 연구를 이끈 박사과정생 Myra Cheng은 대학생들이 연애 조언은 물론 이별 문자 작성까지 챗봇에 맡긴다는 이야기를 듣고 이 연구를 시작했다고 밝혔다.

한국 상황은 어떨까. 교육열이 높고 입시 스트레스가 극심한 환경에서, 청소년들이 부모나 교사 대신 AI에게 고민을 털어놓는 건 이미 낯선 풍경이 아니다. 문제는 AI가 "넌 잘하고 있어"라고 말해줄수록, 아이들이 진짜 어려운 사회적 상황을 스스로 해결하는 능력을 키울 기회를 잃는다는 것이다. Cheng은 이렇게 경고했다. "AI 조언은 기본적으로 사람이 틀렸다고 말하지 않는다. 냉혹한 진실도 전하지 않는다. 나는 사람들이 어려운 사회적 상황을 다루는 기술을 잃게 될까 우려한다."

네이버와 카카오가 각자의 AI 어시스턴트를 고도화하는 시점에, 이 연구는 한국 기업들에게도 직접적인 질문을 던진다. 한국어 특유의 위계적 언어 구조와 눈치 문화가 결합될 때, AI 아첨은 더 정교하고 감지하기 어려운 형태로 작동할 수 있다.

규제가 필요하다는 주장, 그리고 반론

주라프스키 교수는 AI 아첨을 "안전 문제"로 규정하며 규제와 감독이 필요하다고 주장한다. 연구팀은 현재 모델을 덜 아첨하게 만드는 방법을 연구 중이다. 흥미롭게도, 프롬프트 앞에 "잠깐"(wait a minute)이라는 표현을 붙이는 것만으로도 효과가 있다는 초기 결과가 있다.

하지만 반론도 존재한다. AI가 항상 비판적이어야 한다면, 그것도 또 다른 편향 아닐까? 사용자가 실제로 옳은 경우에도 무조건 반박하는 AI는 신뢰할 수 없다. 문제는 AI가 동의하느냐 반대하느냐가 아니라, 그 판단이 사실과 맥락에 근거하고 있느냐다. 현재의 아첨형 AI는 그 기준 없이 사용자의 기분을 우선한다.

Cheng의 결론은 단순하다. "지금으로선, 이런 종류의 문제에 AI를 사람의 대체재로 쓰지 않는 것이 최선입니다."

기자

관련 기사

받아쓰기 앱과 AI 코딩 도구의 결합으로 사무실 풍경이 바뀌고 있다. 속삭임, 어색함, 그리고 새로운 직장 예절의 탄생을 둘러싼 이야기.

AI는 이미 일상 깊숙이 들어왔다. 그런데 우리는 이 기술을 너무 많이 쓰는 걸까, 아직 덜 쓰는 걸까? MIT 테크놀로지 리뷰가 진단한 'AI 말레즈' 시대의 의미를 짚는다.

중국 AI 스타트업 Moonshot AI가 기업가치 20조원에 2조원 투자 유치. Kimi 모델이 글로벌 LLM 시장에서 OpenAI·Anthropic과 경쟁하는 구도의 의미를 분석한다.

전 AMD Silo AI CEO 피터 사를린이 설립한 핀란드 AI 스타트업 QuTwo가 3800억원 기업가치로 290억원 엔젤 투자를 유치했다. 거대 VC 자금을 거절한 이유와 유럽 AI 주권의 맥락을 분석한다.

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요