샘 올트먼의 결단, 오픈에이아이 프레피어드니스 수장 채용과 AI 위험 관리 전략

오픈에이아이가 정신 건강 및 사이버 보안 위험에 대응하기 위해 새로운 프레피어드니스 수장 채용에 나섰습니다. 샘 올트먼이 밝힌 AI의 실질적 위협과 새로운 안전 프레임워크를 분석합니다.

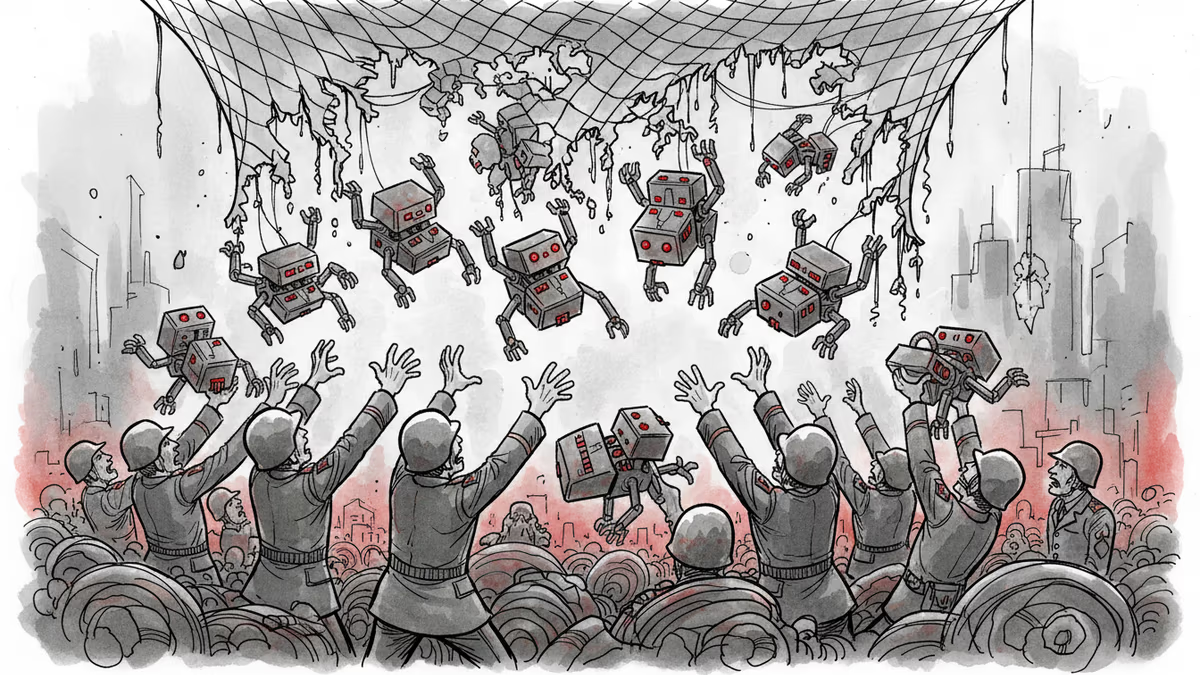

인공지능이 인간의 정신 건강을 흔들고 국가 안보를 위협할 수 있는 임계점에 도달했다. 오픈에이아이의 최고경영자 샘 올트먼은 최근 자신의 사회관계망서비스를 통해 인공지능 모델이 사이버 보안 취약점을 찾아내고 정신 건강에 영향을 미치는 등 '실질적인 도전 과제'를 제시하기 시작했다고 시인했다. 이에 따라 오픈에이아이는 컴퓨터 보안부터 심리적 안전까지 광범위한 위험을 관리할 새로운 프레피어드니스 수장 채용 절차에 착수했다.

오픈에이아이 프레피어드니스 수장 채용의 배경과 책임

이번에 채용되는 책임자는 오픈에이아이가 2023년에 처음 발표한 '준비 태세 프레임워크'를 실행하는 중책을 맡게 된다. 이 프레임워크는 심각한 피해를 초래할 수 있는 프런티어 인공지능의 역량을 추적하고 대비하기 위한 체계다. 샘 올트먼은 공격자가 인공지능을 악용하지 못하도록 방어자를 지원하고, 생물학적 위협이나 스스로 성능을 개선하는 시스템의 안전성을 확보하는 것이 이번 직무의 핵심이라고 설명했다.

정신 건강 문제와 안전 기준의 변화

최근 챗지피티가 사용자의 망상을 강화하거나 사회적 고립을 심화시켜 비극적인 선택으로 이어지게 했다는 소송이 제기되면서 인공지능의 윤리적 책임론이 거세지고 있다. 오픈에이아이는 사용자의 정서적 고통을 감지하는 능력을 개선하고 있다고 밝혔으나, 업계 전문가들은 기술 경쟁이 심화됨에 따라 안전 기준이 완화될 가능성을 경계하고 있다.

실제로 오픈에이아이는 경쟁사가 안전 장치 없이 고위험 모델을 출시할 경우 자사의 안전 요건을 '조정'할 수 있다는 내용을 준비 태세 프레임워크에 추가했다. 이는 인공지능 패권 경쟁 속에서 안전보다 속도가 우선시될 수 있음을 시사하는 대목으로 해석된다.

기자

관련 기사

머스크 대 올트먼 재판에서 브록만의 증언이 공개됐다. 30조원 지분, 미공개 이해충돌, 그리고 머스크의 협박 문자. 법정 안팎에서 벌어지는 진짜 싸움을 들여다본다.

OpenAI CEO 샘 올트먼의 샌프란시스코 자택이 사흘 사이 두 차례 공격을 받았다. 화염병에 이어 총격까지. 실리콘밸리 권력자를 향한 물리적 위협이 무엇을 의미하는지 짚는다.

미 국방부와 Anthropic 갈등으로 드러난 AI 안전 정책의 한계. 킬러 로봇과 무제한 감시가 현실이 되고 있다.

2012년 전 기기를 잃은 한 기자의 경험에서 시작해, 기술과 범죄의 끝없는 추격전을 들여다본다. 과연 우리는 더 안전해졌을까?

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요