당신의 글쓰기 선생님이 AI로 바뀌었다

Grammarly가 사망한 교수와 유명인을 AI로 부활시켜 글쓰기 조언을 제공하는 기능을 출시했다. 동의 없이 포함된 전문가들의 반발이 거세다.

죽은 교수가 내 글을 첨삭해준다?

Grammarly의 새로운 기능을 써보던 한 기자가 깜짝 놀랐다. AI가 제공하는 '전문가 리뷰'에 자신의 상사가 포함되어 있었던 것이다. 더 충격적인 건 상사는 물론 그 누구도 동의한 적이 없다는 사실이었다.

지난 8월 출시된 이 기능은 각 분야 전문가들의 조언을 'AI로 재현'해 사용자의 글쓰기를 도와준다고 광고한다. 문제는 이 '전문가'들 중 상당수가 이미 세상을 떠난 교수들이고, 살아있는 전문가들조차 자신이 포함된 사실을 모르고 있다는 점이다.

무단 도용된 전문성

The Verge의 기자가 직접 테스트해본 결과는 충격적이었다. AI가 생성한 피드백에는 편집장 닐라이 파텔을 비롯해 여러 동료 편집자들의 이름으로 된 조언이 포함되어 있었다. 당연히 이들 중 누구도 Grammarly에 자신의 전문성을 활용할 권한을 준 적이 없다.

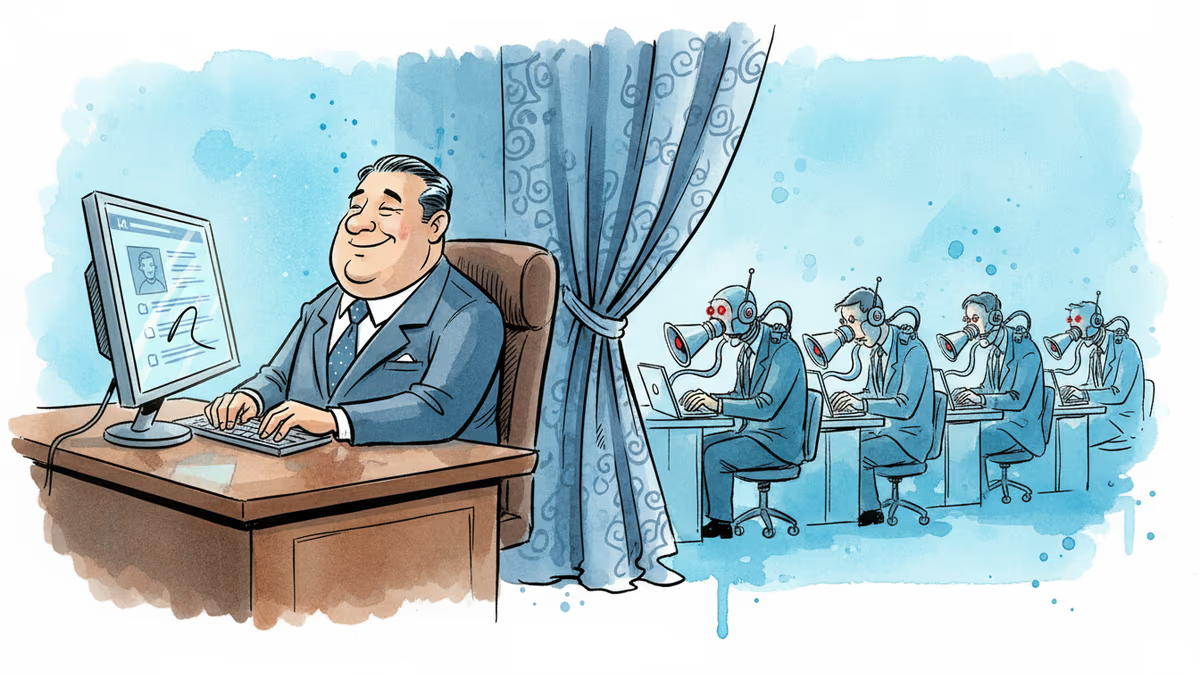

이는 단순한 실수가 아니다. Grammarly는 의도적으로 유명 전문가들의 글쓰기 스타일과 조언을 분석해 AI 모델에 학습시킨 것으로 보인다. 마치 그들이 직접 피드백을 주는 것처럼 포장해서 말이다.

더욱 문제가 되는 건 고인이 된 교수들까지 포함되어 있다는 점이다. 유족의 동의도 없이 AI로 '부활'시켜 상업적으로 활용하고 있는 셈이다.

전문가들의 분노와 우려

이 소식이 알려지자 해당 전문가들의 반응은 즉각적이었다. 자신의 이름과 전문성이 무단으로 사용된 것에 대한 분노는 물론, 더 큰 우려를 표했다.

"내가 실제로 하지 않은 조언에 내 이름이 붙는다면, 그 책임은 누가 지는가?" 한 전문가는 이렇게 반문했다. AI가 생성한 잘못된 조언이 사용자에게 피해를 줄 경우, 명의를 도용당한 전문가가 책임을 져야 하는 상황이 올 수도 있다는 것이다.

법적 측면에서도 문제가 크다. 개인의 이름과 전문성은 명백한 지적재산권이자 인격권의 영역이다. 동의 없이 이를 상업적으로 활용하는 것은 명백한 권리 침해다.

AI 시대의 새로운 딜레마

Grammarly의 이번 사태는 AI 시대의 새로운 윤리적 딜레마를 보여준다. 기술적으로는 누구든 공개된 글을 바탕으로 그 사람의 글쓰기 스타일을 모방한 AI를 만들 수 있다. 하지만 그것이 기술적으로 가능하다고 해서 윤리적으로도, 법적으로도 허용되는 것은 아니다.

특히 한국에서도 비슷한 사례가 얼마든지 발생할 수 있다. 네이버나 카카오 같은 플랫폼들이 AI 서비스를 확장하면서, 유명 작가나 교수들의 글쓰기 스타일을 무단으로 활용할 가능성이 있다. 이미 일부 AI 챗봇들이 특정 인물의 말투를 흉내내는 기능을 제공하고 있어 우려가 현실화되고 있다.

기자

관련 기사

미국 FTC가 Cox Media 등 3개사에 93만 달러 벌금을 부과했다. 스마트폰 도청으로 맞춤 광고를 한다고 '거짓 홍보'한 혐의다. 실제로 도청했는지보다 더 흥미로운 질문이 남는다.

2026년 미국 졸업식에서 AI를 찬양한 기업인들이 학생들의 야유를 받았다. 취업 절벽 앞에 선 청년들의 분노가 바이럴 영상으로 번지며 AI 낙관론에 균열을 내고 있다.

필리핀 가상 비서들이 AI를 이용해 LinkedIn 임원 계정을 대신 운영하는 산업의 실태. 하루 30~40개 댓글, 가짜 팔로워, '좋아요' 품앗이까지 — 직업적 진정성의 의미를 묻는다.

미국 대학 졸업식에서 AI를 언급한 연사들이 학생들의 거센 야유를 받았다. 단순한 해프닝이 아니다. 청년 세대가 AI에 보내는 불신의 신호를 읽어야 한다.

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요