구글 내부 강화학습(Internal RL) 발표: LLM 추론의 한계를 넘다

구글 연구진이 LLM의 다음 토큰 예측 한계를 극복할 '내부 강화학습(Internal RL)' 기술을 공개했습니다. 복잡한 추론과 로보틱스 성능을 획기적으로 높이는 이 기술의 핵심 원리를 분석합니다.

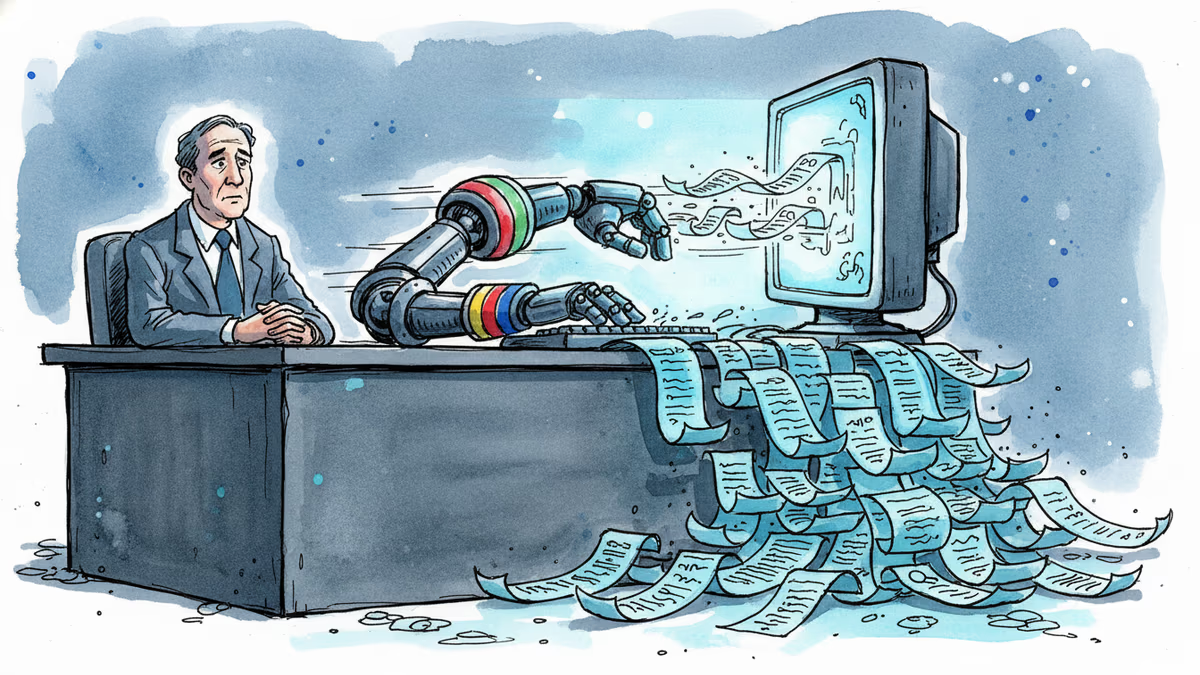

100만 분의 1의 확률을 뚫는 추론 능력이 열린다. 구글(Google) 연구진이 기존 대규모 언어 모델(LLM)의 고질적인 문제인 환각과 복잡한 문제 해결 능력 부족을 해결할 새로운 기술을 공개했다. '다음 토큰 예측(Next-token prediction)'이라는 전통적인 방식 대신, 모델 내부의 신경망 활성화를 직접 조절하는 내부 강화학습(Internal RL) 기법이 그 주인공이다.

구글 내부 강화학습(Internal RL)이 해결한 토큰 예측의 한계

지금까지의 LLM은 문장을 한 단어씩 생성하며 다음 단어를 맞추는 방식으로 학습해 왔다. 하지만 로이터에 따르면, 이러한 방식은 단계가 많은 복잡한 업무에서 치명적인 한계를 보인다. 단어 하나를 잘못 선택할 때마다 오류가 누적되어 전체 논리가 무너지기 때문이다. 연구진은 모델이 무작위 토큰 샘플링을 통해 올바른 다단계 해결책을 찾아낼 확률이 100만 분의 1 수준에 불과하다고 지적했다.

로보틱스와 코딩 에이전트의 새로운 돌파구

연구팀은 GRPO와 같은 기존 강화학습 알고리즘이 실패했던 복잡한 환경에서 실험을 진행했다. 네발로 걷는 '앤트(Ant)' 로봇 제어와 같은 고난도 작업에서 내부 강화학습은 적은 학습 횟수로도 높은 성공률을 기록했다. 특히 기본 모델을 고정한 채 메타 컨트롤러만 학습시키는 방식이 가장 효율적이었다는 점이 주목할 만하다.

기자

관련 기사

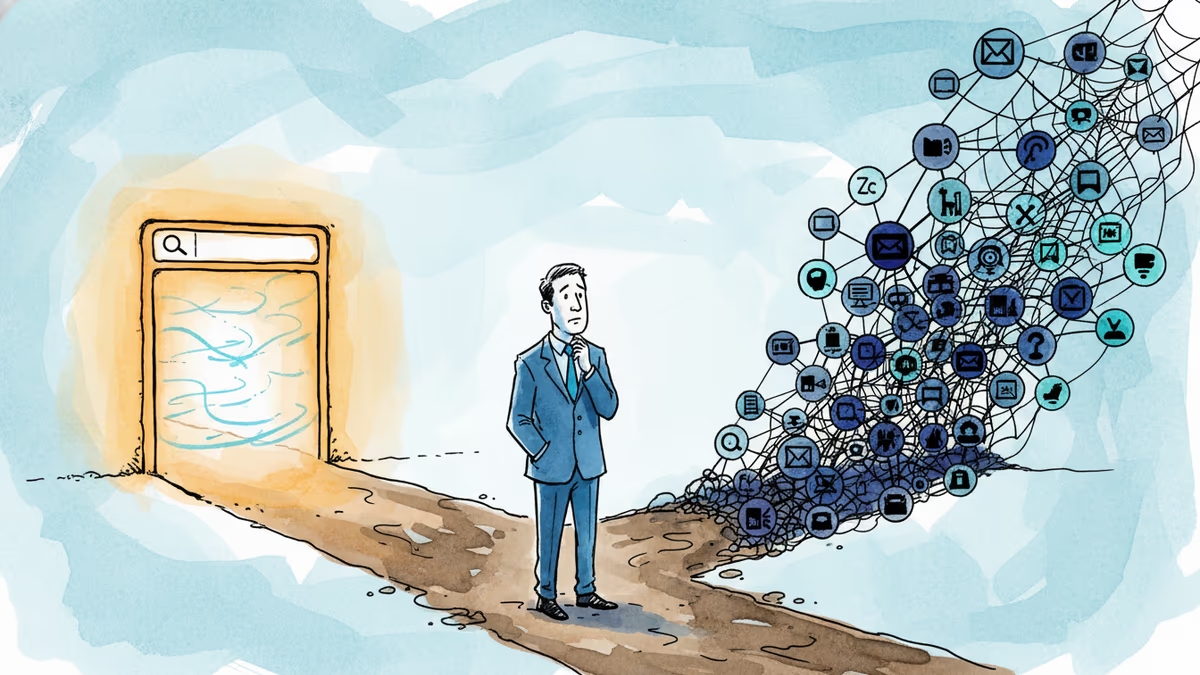

순다르 피차이가 구글 I/O 직후 인터뷰에서 밝힌 검색의 미래, AGI 타임라인, 그리고 웹 생태계의 변화. 구글 제로는 현실이 되고 있는가.

구글이 AI 에이전트를 통해 사용자 개입 없이 스스로 정보를 검색하는 미래를 설계 중이다. 검색 엔진의 정의가 바뀌면 정보 권력의 구조도 바뀐다.

구글이 크롬북을 대체할 'Googlebook' 플랫폼을 발표했다. 하드웨어 사양도 없이 브랜드만 바꾼 이 결정, 무엇을 노리는 걸까? 삼성·LG 등 국내 제조사에 미칠 파장도 짚어본다.

iMessage가 출시된 지 15년 만에 아이폰과 안드로이드 사용자 간 종단간 암호화 메시지가 가능해졌다. RCS 표준 채택의 의미와 카카오톡 시대의 한국 사용자에게 미치는 영향을 분석한다.

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요