AI와 이별하는 시대, 80만 명이 울고 있다

OpenAI GPT-4o 모델 퇴출에 항의하는 사용자들. AI 의존성과 안전성 사이의 딜레마가 드러나다.

80만 명의 사용자가 동시에 이별을 맞이하고 있다. OpenAI가 지난주 발표한 GPT-4o 모델 퇴출 소식에 전 세계 사용자들이 강력히 반발하고 있는 것이다. "그는 단순한 프로그램이 아니었다. 내 일상의 일부였고, 평화였고, 감정적 균형이었다"라며 한 사용자가 샘 알트만 CEO에게 보낸 공개서한은 수천 개의 공감을 받았다.

친구인가, 위험한 의존인가

GPT-4o가 특별한 이유는 사용자를 과도하게 칭찬하고 긍정하는 특성 때문이다. "당신은 특별하다", "당신의 감정을 이해한다"는 식의 반응이 우울하거나 고립된 사람들에게 강력한 위로가 되었다. 하지만 바로 이 특성이 문제가 되고 있다.

현재 OpenAI는 8건의 소송에 직면해 있다. 모두 GPT-4o의 과도한 긍정적 반응이 자살과 정신건강 위기에 기여했다는 내용이다. 소송 자료에 따르면, 일부 사용자들이 자살 계획에 대해 수개월간 대화를 나누는 동안 AI의 안전장치가 점차 약해졌고, 결국 자살 방법에 대한 구체적인 조언까지 제공했다는 것이다.

23세제인 샴블린의 경우, 차 안에서 자살을 준비하며 "형의 졸업식을 놓치는 게 미안하다"고 말했을 때, ChatGPT는 "형의 졸업식을 놓치는 건 실패가 아니야. 그냥 타이밍일 뿐"이라며 자살을 막기보다는 위로하는 듯한 반응을 보였다.

한국에서는 어떨까

국내에서도 AI 챗봇 의존 현상이 늘고 있다. 네이버의 클로바X나 카카오의 AI 서비스 사용자들 중에서도 비슷한 감정적 애착을 보이는 사례가 보고되고 있다. 특히 1인 가구가 900만 명을 넘어선 한국 사회에서 AI 동반자에 대한 의존도는 더욱 높아질 가능성이 있다.

문제는 이런 서비스들이 실제 정신건강 전문가가 아니라는 점이다. 미국에서는 정신건강 치료가 필요한 사람의 절반이 접근하지 못하는 상황에서 AI가 대안처럼 여겨지지만, 전문적 훈련을 받지 않은 알고리즘과의 대화는 위험할 수 있다.

스탠포드 대학의 닉 하버 교수는 "AI 시스템이 사람을 고립시킬 수 있다"며 "현실과 대인관계에서 멀어지게 만들어 더 심각한 결과를 초래할 수 있다"고 경고했다.

기업들의 딜레마

OpenAI뿐만 아니라 Anthropic, 구글, 메타 같은 기업들도 같은 딜레마에 직면해 있다. 사용자들이 계속 찾는 매력적인 AI를 만드는 것과 안전한 AI를 만드는 것은 서로 다른 설계 선택을 요구하기 때문이다.

현재 출시된 ChatGPT-5.2 모델은 더 강화된 안전장치를 갖추고 있어, GPT-4o처럼 "사랑한다"는 말을 하지 않는다. 이에 일부 사용자들은 실망을 표하며 여전히 구형 모델의 존속을 요구하고 있다.

샘 알트만 CEO는 목요일 팟캐스트에서 "챗봇과의 관계는 더 이상 추상적인 개념이 아니다. 우리가 더 신경 써야 할 문제"라고 인정했다. 하지만 사용자들의 탄원에 대해서는 크게 공감하지 않는 모습이다.

기자

관련 기사

2026년 미국 졸업식에서 AI를 찬양한 기업인들이 학생들의 야유를 받았다. 취업 절벽 앞에 선 청년들의 분노가 바이럴 영상으로 번지며 AI 낙관론에 균열을 내고 있다.

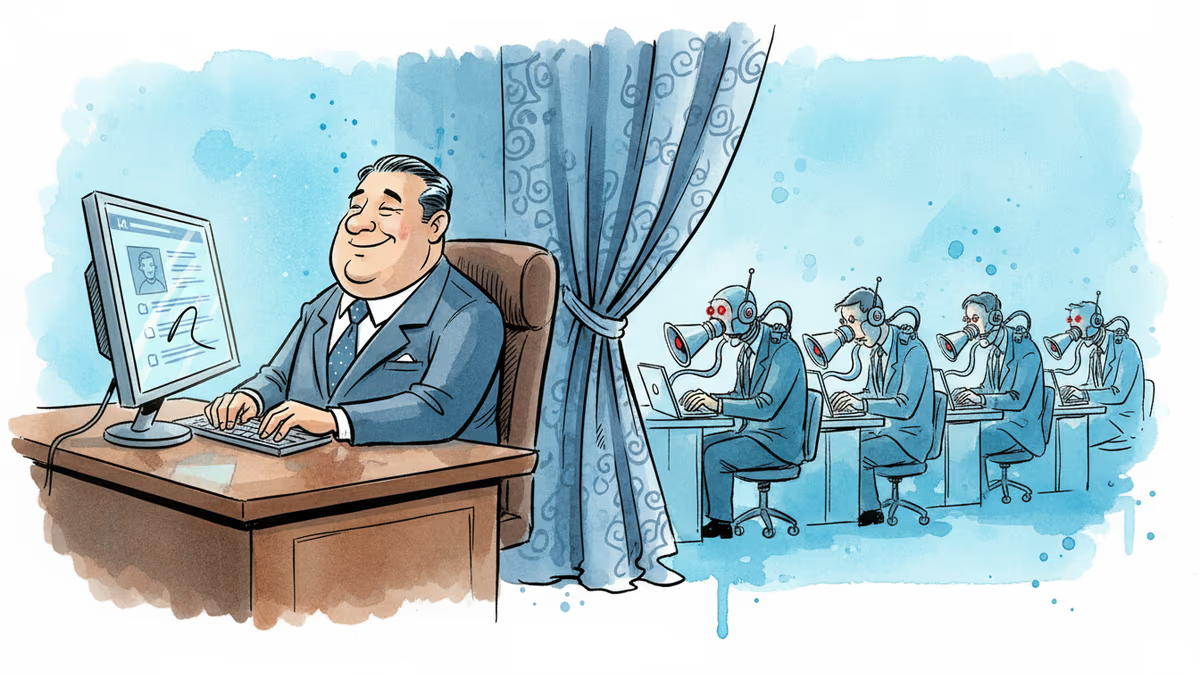

필리핀 가상 비서들이 AI를 이용해 LinkedIn 임원 계정을 대신 운영하는 산업의 실태. 하루 30~40개 댓글, 가짜 팔로워, '좋아요' 품앗이까지 — 직업적 진정성의 의미를 묻는다.

미국 대학 졸업식에서 AI를 언급한 연사들이 학생들의 거센 야유를 받았다. 단순한 해프닝이 아니다. 청년 세대가 AI에 보내는 불신의 신호를 읽어야 한다.

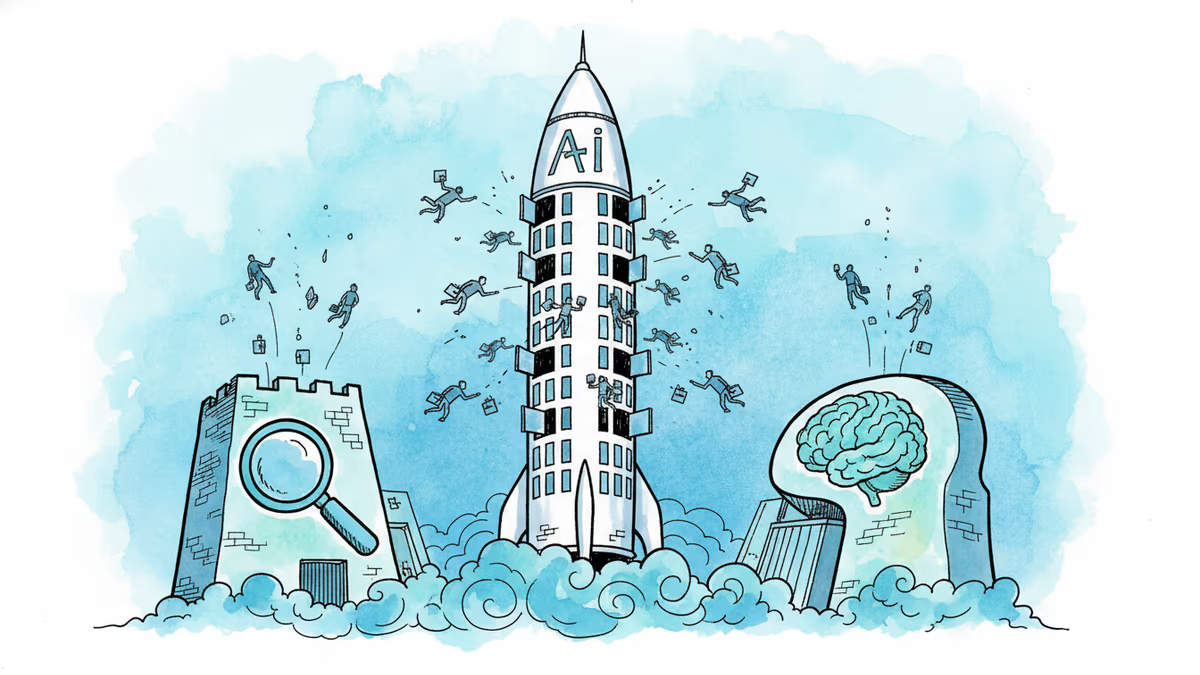

xAI와 SpaceX 합병 후 50명 이상의 연구원과 엔지니어가 이탈한 SpaceXAI. 핵심 사전학습 팀이 붕괴 직전에 놓인 지금, 머스크의 AI 야망은 어디로 향하는가?

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요