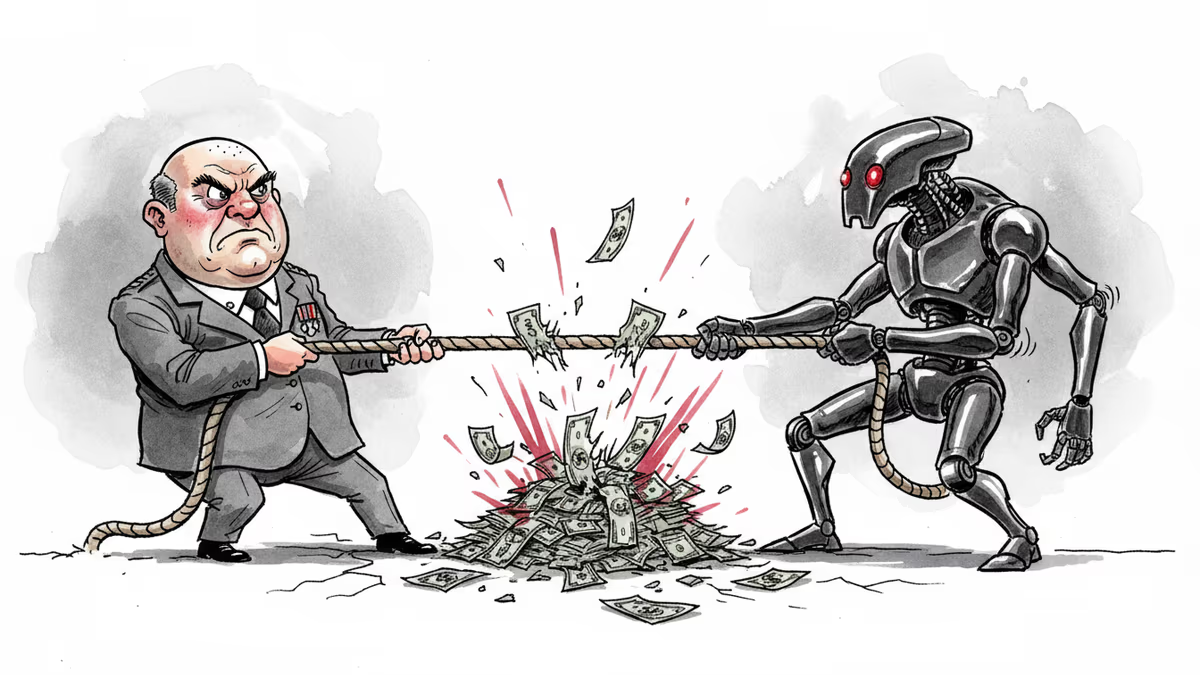

펜타곤 vs 앤트로픽, AI 무기화 놓고 2000억원 줄다리기

미 국방부가 AI 기업들에게 '모든 합법적 목적' 사용 허용을 요구하며 앤트로픽과 갈등. 자율무기 개발의 윤리적 경계는 어디까지?

2000억원 계약이 걸린 AI 윤리 전쟁

미 국방부와 AI 기업 앤트로픽이 2억 달러(약 2000억원) 규모의 계약을 놓고 정면충돌하고 있다. 쟁점은 하나다. AI를 '모든 합법적 목적'에 사용할 수 있느냐는 것.

트럼프 행정부는 OpenAI, 구글, xAI, 앤트로픽 등 주요 AI 기업들에게 동일한 요구를 했다. 군사 목적 사용에 제한을 두지 말라는 것이다. 하지만 앤트로픽만큼은 고개를 젓고 있다.

앤트로픽의 '선 긋기'

앤트로픽은 자사의 Claude 모델이 "완전 자율무기"와 "대규모 국내 감시"에는 사용될 수 없다는 입장을 고수하고 있다. 회사 대변인은 "특정 작전에 대해서는 국방부와 논의하지 않았다"며 "사용 정책의 핵심 한계선에 집중하고 있다"고 밝혔다.

반면 익명의 행정부 관계자에 따르면, 4개 기업 중 1곳은 이미 동의했고, 2곳은 '어느 정도 유연성'을 보였다고 한다. 앤트로픽만이 가장 강하게 저항하고 있다는 것이다.

이미 벌어진 일들

흥미롭게도 Claude는 이미 군사 작전에 사용된 바 있다. 월스트리트저널에 따르면, 미군이 베네수엘라 전 대통령 니콜라스 마두로 체포 작전에서 Claude를 활용했다고 한다. 1월에는 앤트로픽과 국방부 간 Claude 사용 범위를 놓고 "상당한 이견"이 있었다는 보도도 나왔다.

펜타곤은 압박 수위를 높이고 있다. 앤트로픽이 계속 거부하면 2억 달러 계약을 취소하겠다고 위협하고 있는 상황이다.

한국에서 벌어진다면?

이 갈등은 한국에도 시사하는 바가 크다. 네이버의 HyperCLOVA X나 LG AI연구원의 기술이 국방 목적으로 요구받는다면? 국내 AI 기업들도 언젠가 비슷한 딜레마에 직면할 수 있다.

특히 한국은 분단 상황이라는 특수성이 있다. AI 기술의 군사적 활용이 더욱 민감한 사안이 될 수밖에 없다. 동시에 중국의 AI 굴기와 미국의 기술 패권 경쟁 사이에서 균형점을 찾아야 하는 과제도 있다.

기자

관련 기사

2026년 미국 졸업식에서 AI를 찬양한 기업인들이 학생들의 야유를 받았다. 취업 절벽 앞에 선 청년들의 분노가 바이럴 영상으로 번지며 AI 낙관론에 균열을 내고 있다.

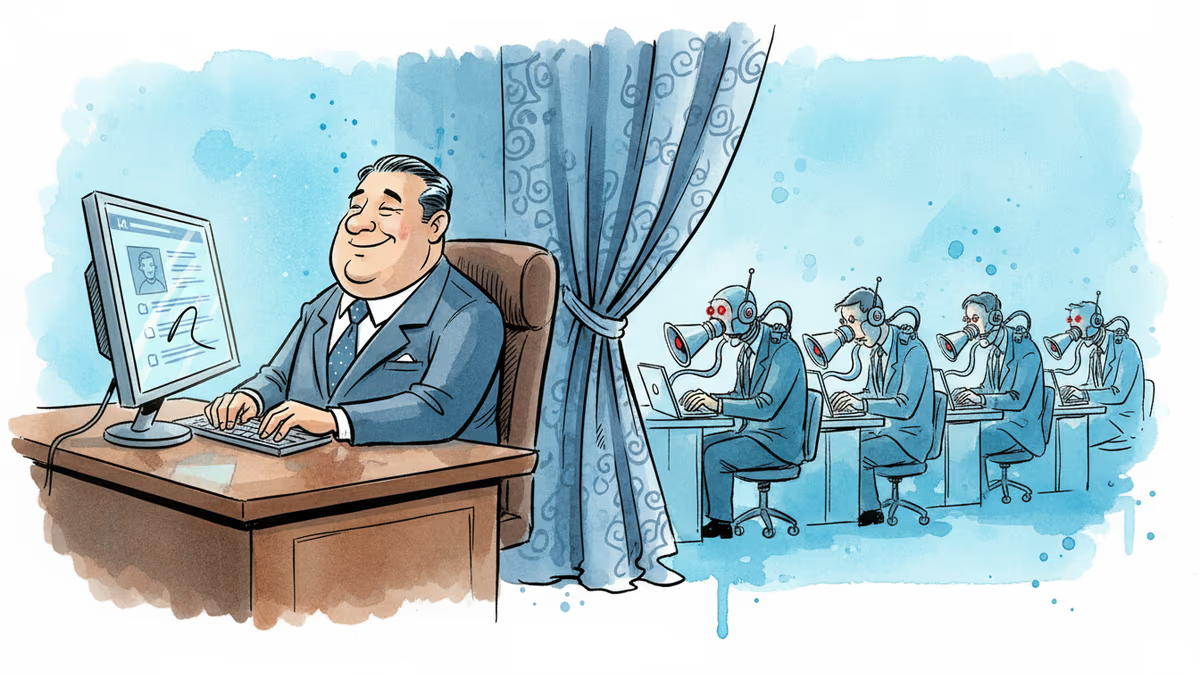

필리핀 가상 비서들이 AI를 이용해 LinkedIn 임원 계정을 대신 운영하는 산업의 실태. 하루 30~40개 댓글, 가짜 팔로워, '좋아요' 품앗이까지 — 직업적 진정성의 의미를 묻는다.

미국 대학 졸업식에서 AI를 언급한 연사들이 학생들의 거센 야유를 받았다. 단순한 해프닝이 아니다. 청년 세대가 AI에 보내는 불신의 신호를 읽어야 한다.

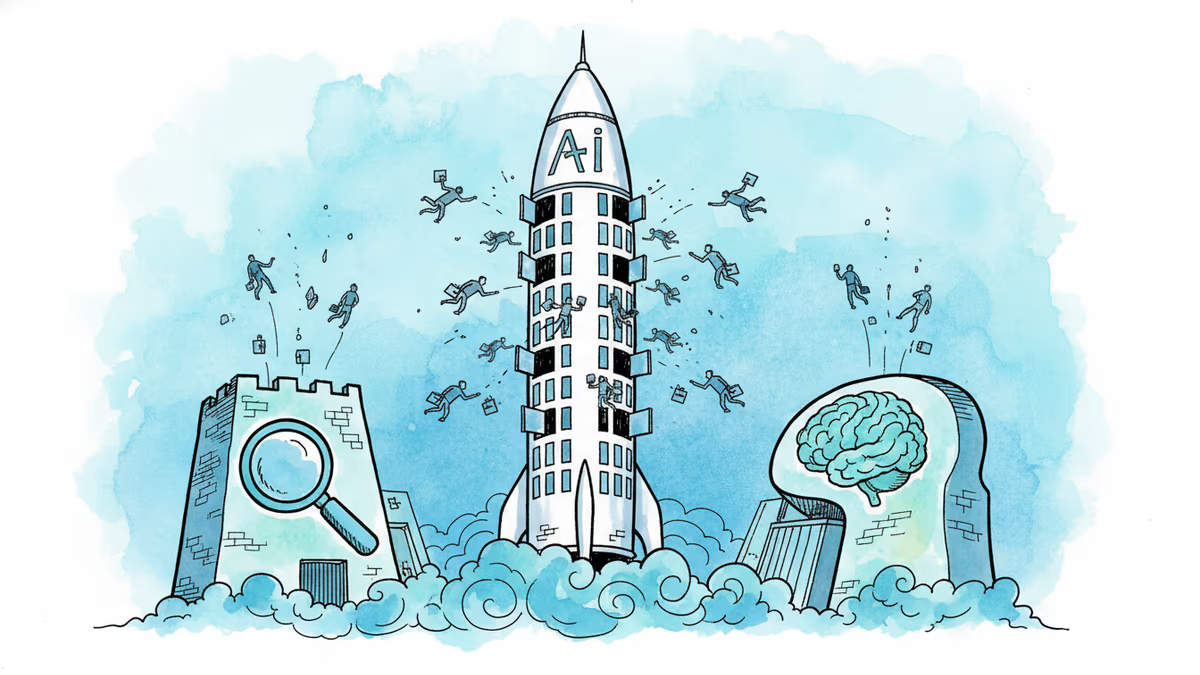

xAI와 SpaceX 합병 후 50명 이상의 연구원과 엔지니어가 이탈한 SpaceXAI. 핵심 사전학습 팀이 붕괴 직전에 놓인 지금, 머스크의 AI 야망은 어디로 향하는가?

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요