AI軍事化爭議:當科技巨頭拒絕為戰爭服務

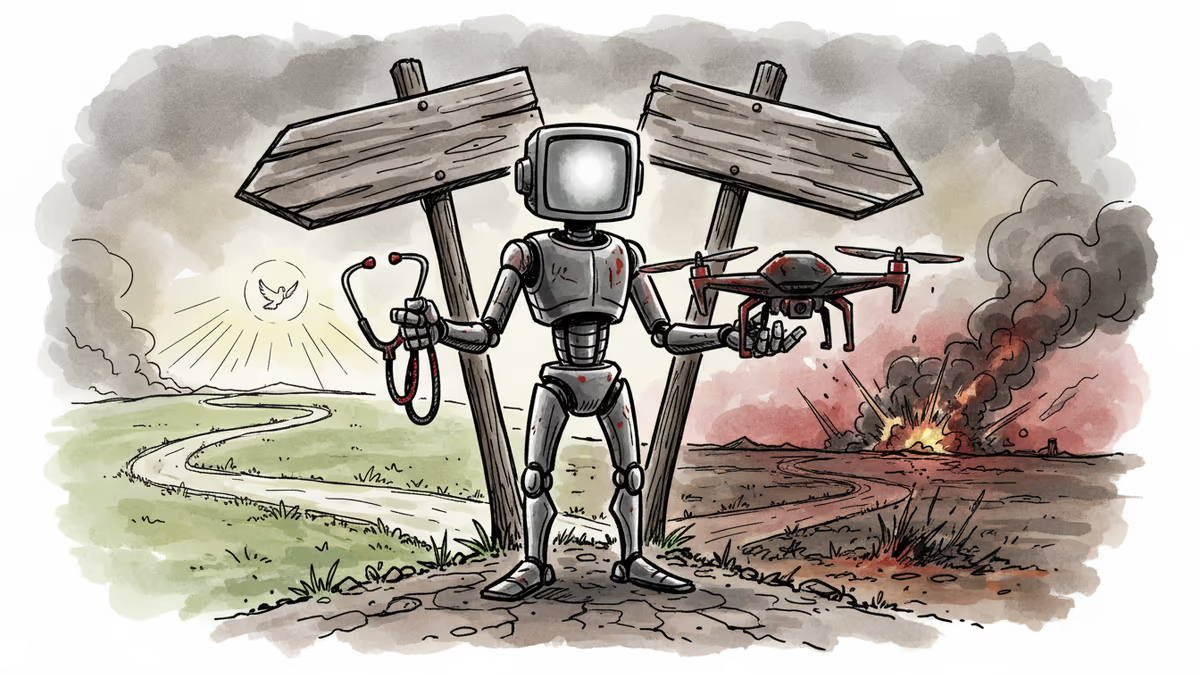

Anthropic拒絕與美國防部續約,引發AI技術軍事化的倫理與安全辯論。探討亞太地區科技產業的應對策略。

當Anthropic執行長達里奧·阿莫迪在2026年2月宣布拒絕與美國國防部續約時,他可能沒有預料到這個決定會在全球科技界掀起如此巨大的波瀾。這不僅是一家AI公司的商業選擇,更是對「AI是否應被視為武器」這個時代問題的明確表態。

矽谷與五角大廈的價值觀碰撞

Anthropic與OpenAI並列為全球最先進的AI模型開發公司,其旗艦產品「Claude」在使用條款中明確禁止軍事用途。然而,美國國防部基於國家安全考量,要求對這些尖端AI技術擁有「合理存取權」。

這場對立反映出更深層的分歧:科技公司追求的「AI安全」理想,與國家安全機構的現實需求之間的矛盾。在1.2兆美元的全球AI市場中,技術主導權已成為國家競爭力的核心指標。

中國的字節跳動、百度等企業在軍民融合政策下快速發展AI技術,而俄羅斯也在烏克蘭戰爭中大量運用AI驅動的無人系統。面對這種競爭態勢,美國政府認為限制本國企業的軍事合作將削弱國家安全。

亞太地區的連鎖反應

這場爭議對亞太地區具有特殊意義。台灣作為全球半導體製造中心,其台積電為包括Anthropic在內的多家AI公司提供關鍵晶片。如果AI技術被正式歸類為軍事裝備,相關的出口管制和技術轉移限制將更加嚴格。

新加坡政府已將AI列為國家戰略重點,並在2024年推出「AI治理框架」。該框架試圖在促進創新與確保安全之間找到平衡,為其他亞洲國家提供參考模式。

日本的情況更為複雜。作為美國盟友,日本在防衛政策上與美國密切協調,但其「人本AI」理念強調技術發展應服務於人類福祉,而非軍事優勢。軟銀對Anthropic的5億美元投資,使日本企業間接成為這場倫理辯論的參與者。

監管真空中的道德選擇

目前,國際社會缺乏針對AI軍事應用的統一監管框架。與核武器或化學武器不同,AI技術具有「雙重用途」特性,民用與軍用界線模糊。

聯合國自2023年開始討論「致命自主武器系統(LAWS)」的監管問題,但進展緩慢。主要軍事強國對限制自身技術優勢的國際條約持保留態度。美國、中國、俄羅斯都認為,在對手尚未受到約束的情況下,單方面限制將損害國家利益。

在這種監管真空中,民間企業的自主選擇變得格外重要。Google在2018年退出「Maven計畫」軍事AI項目,Microsoft則在員工抗議下修改了與軍方的合作條款。

華人科技圈的不同路徑

有趣的是,華人科技圈對AI軍事化問題呈現出不同的態度。中國大陸的科技企業在「軍民融合」政策框架下,較少公開討論AI技術的軍事倫理問題。阿里巴巴、騰訊等公司的AI研究成果,往往同時服務於民用和國防需求。

相比之下,台灣和香港的科技企業更傾向於採用國際標準的AI倫理準則。聯發科在其AI晶片設計中強調「負責任的AI」,香港科技大學則在AI安全研究方面與歐美機構密切合作。

這種差異反映出不同政治體制下,科技企業面臨的約束機制和價值選擇存在根本性差異。

重新定義科技企業的社會責任

Anthropic的決定重新定義了科技企業的社會責任邊界。傳統上,企業的主要責任是為股東創造價值,但在AI時代,技術的潛在影響如此巨大,企業是否應該承擔更廣泛的道德責任?

Palantir和Anduril等專門服務軍事和情報部門的AI公司,代表了另一種商業模式。這些公司認為,在地緣政治競爭加劇的背景下,為民主國家提供技術優勢是一種愛國行為。

相关文章

中國發布AI新藥研發平台GalaxyVS,將初期化合物篩選從數月縮短至數十秒。這項技術對全球製藥競賽、中美科技博弈與華人醫療市場意味著什麼?

深圳中級人民法院借助AI系統,2025年案件處理量增加50%,平均每位法官處理744件。這套模式即將推廣至數十座城市,背後意味著什麼?

美國國會聽證會上,議員與專家指控中國以合法採購與技術竊取雙管齊下推進AI發展,同時警告美國自身的移民與研究政策正在削弱創新能力。這場爭論對華人世界意味著什麼?

2026年4月13日,日本防衛省正式宣布在陸上自衛隊設立兩個無人系統專責部門,規劃投入逾1兆日圓。這場靜悄悄的軍事轉型,對整個亞太地區意味著什麼?

观点

分享你对这篇文章的看法

登录加入讨论