AI內容標註大失敗:我們正步入「懷疑一切」的時代

從C2PA技術標準的挫敗,到Instagram負責人警告「不再相信照片」,探討AI內容識別技術面臨的根本性挑戰與社會影響。

「未來我們將從預設相信轉向預設懷疑。」Instagram負責人亞當·莫塞里在2025年底的這句話,標誌著數位時代一個根本性轉折點的到來。

當AI生成的圖像和影片以前所未有的規模充斥網路時,我們對視覺內容的基本信任正在瓦解。更令人震驚的是,連美國白宮和國土安全部都在公然發布AI修改的圖像,毫不掩飾地操縱現實。

技術標準的美好願景與殘酷現實

C2PA(內容來源與真實性聯盟)曾被視為解決這一危機的最有希望的方案。這個由Adobe主導、Microsoft、OpenAI、Meta等科技巨頭參與的標準,設計理念看似完美:在內容創建的每一個環節都嵌入元數據,記錄從拍攝到編輯的完整歷程。

理論上,當你在社群媒體上看到一張圖片時,平台會自動讀取這些數據並顯示「AI生成」或「真實照片」的標籤。但現實卻是另一番景象。

The Verge記者潔西·韋瑟貝德在深度調查後發現,這套系統面臨致命缺陷:元數據極容易被刪除,平台在上傳過程中經常意外移除這些資訊,而且需要所有參與者的完全配合才能運作。

平台的半心半意與全面撤退

最諷刺的是,即使是參與制定標準的公司也沒有認真執行。Instagram曾短暫嘗試顯示「AI製作」標籤,但在創作者強烈反彈後迅速後退。YouTube雖然使用Google的SynthID技術,但大量AI生成影片仍然沒有標籤。

X(前Twitter)的完全退出更是象徵性的失敗。作為C2PA的創始成員,該平台在馬斯克收購後完全放棄了相關努力,成為AI虛假資訊的重要傳播渠道。

亞洲市場的獨特挑戰

對華人世界而言,這個問題具有特殊的複雜性。在中國大陸,內容審查機制可能提供某種程度的品質控制,但也帶來了透明度問題。相比之下,台灣、香港和東南亞華人社群更依賴國際平台,因此更容易受到AI虛假內容的衝擊。

Sony等日本相機製造商已開始在新產品中支援C2PA,但現有設備的升級仍然困難。這對依賴專業攝影設備的新聞機構和內容創作者來說是一個現實挑戰。

創作者為何抗拒AI標籤?

一個意想不到的問題是創作者對AI標籤的強烈反感。現代圖像編輯工具普遍集成了AI功能,從降噪到色彩校正,使用這些基礎功能就可能觸發「AI使用」標籤。

許多創作者認為這種標籤貶低了他們的作品價值。正如一位受訪者所說:「如果你告訴我這個廣告是用AI製作的,我為什麼還要購買這個產品?」這種心理反應進一步削弱了標籤系統的有效性。

政府操縱現實的新常態

更令人擔憂的是政府機構對AI技術的濫用。美國政府部門公開發布經過AI修改的逮捕照片,將當事人的表情修改得更加痛苦,以增強政治宣傳效果。

當最具權威性的資訊來源都在操縱現實時,整個社會的資訊信任基礎正在崩塌。這不再是技術問題,而是關乎民主社會根基的政治問題。

監管:最後的救命稻草?

技術解決方案的失敗讓監管成為唯一選項。歐盟的數位服務法和AI法已經開始要求平台對AI內容進行標註,但執行效果仍待觀察。

在亞太地區,各國政府也在考慮類似措施。然而,監管的挑戰在於技術發展的速度遠超法律制定的步伐,而且跨境執法困難重重。

從信任到懷疑的社會轉型

莫塞里提出的「預設懷疑」模式可能是不可避免的未來。這意味著我們需要培養全新的媒體素養:不再被動接受視覺資訊,而是主動質疑和驗證。

這種轉變對社會運動、新聞報導和日常溝通都將產生深遠影響。當一段抗議影片出現時,觀眾首先想到的不再是「發生了什麼」,而是「這是真的嗎」。

相关文章

NPR主持人馬努什·扎莫羅迪新書《Body Electric》深入探討科技對人體健康的影響。從脊椎到睡眠,數位時代的身體代價遠比我們想像的更深遠。

從北極熊的TikTok影片到IPCC報告,Z世代用情感、同儕與演算法建構真實。這種認識論正在重塑民主、教育與公共生活的基礎。

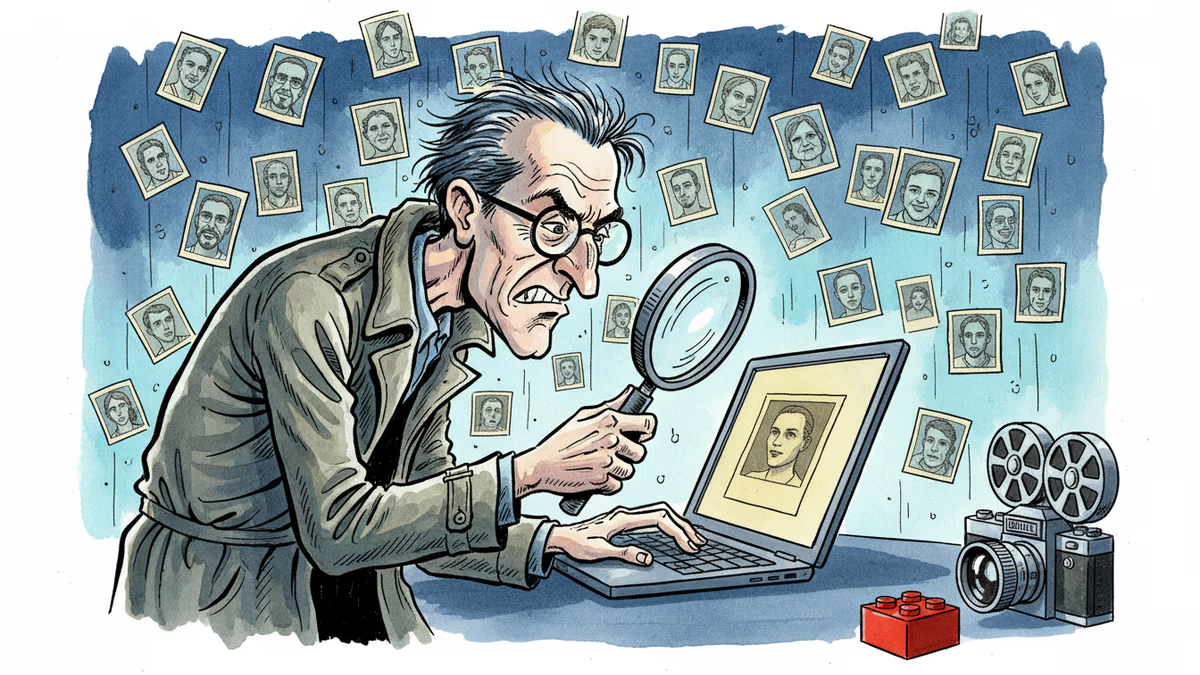

樂高風格的宣傳影片、衛星圖像遭封鎖、AI生成的混合假照片——在資訊真偽難辨的時代,我們還剩下什麼防線?

當伊朗飛彈落向波斯灣,阿聯酋與印度的資訊環境出現了截然不同的面貌。從緊急警報系統到假新聞擴散,這場對比揭示的不只是媒體問題,而是治理哲學的根本差異。

观点

分享你对这篇文章的看法

登录加入讨论