美國防部將Anthropic列入供應鏈風險,但Claude服務仍可正常使用

美國防部將AI公司Anthropic列為安全風險,但Microsoft、Google、AWS確認將繼續為客戶提供Claude服務。這場科技倫理與國家安全的角力,對全球AI產業意味著什麼?

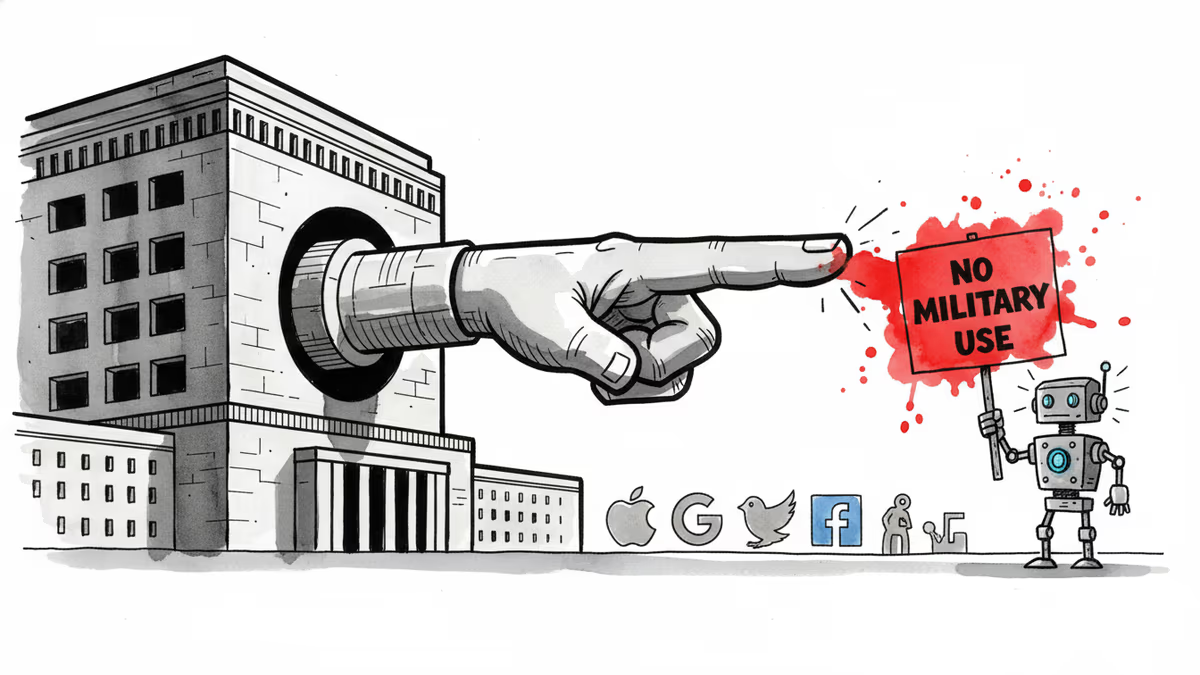

當AI成為國家競爭力的核心時,一家美國AI公司竟然被本國國防部列為「供應鏈風險」。這聽起來像是針對中俄企業的措施,但這次的目標是Anthropic。

拒絕軍方要求的代價

美國國防部週四正式將Anthropic指定為供應鏈風險企業,原因是該公司拒絕向軍方提供Claude的無限制訪問權限。Anthropic表示,大規模監控和完全自主武器等應用超出了其AI能夠安全支援的範圍。

這項指定意味著國防部將逐步停止使用Claude,同時要求所有與國防部合作的公司和機構證明他們沒有使用Anthropic的模型。Anthropic已表示將在法庭上挑戰這項決定。

科技巨頭的明確表態

面對這一前所未有的情況,美國科技巨頭迅速表態。Microsoft率先向客戶保證,該公司律師研究後認為,除了國防部之外,Anthropic產品(包括Claude)可以繼續透過M365、GitHub和Microsoft AI Foundry等平台向客戶提供。

Google也發表類似聲明,確認將繼續透過Google Cloud等平台提供Claude服務。據報導,AWS的客戶和合作夥伴同樣可以繼續在非軍事工作負載中使用Claude。

CEO的反擊策略

Anthropic執行長達里奧·阿莫代(Dario Amodei)在聲明中明確表示,這項指定「僅適用於客戶在與國防部直接合約中使用Claude的情況,而非所有擁有此類合約客戶的所有使用情況」。

他進一步強調,即使對於國防部承包商,供應鏈風險指定也「不能(也無法)限制與其特定國防部合約無關的Claude使用或與Anthropic的業務關係」。

市場反應出人意料

令人意外的是,在拒絕國防部要求後,Claude的消費者增長勢頭依然強勁。這表明企業堅持技術倫理原則可能反而贏得了市場信任。

對於華人科技圈而言,這個案例特別值得關注。在中美科技競爭加劇的背景下,一家美國公司因為拒絕軍方要求而被列入風險清單,這種情況前所未見。

地緣政治新格局

這起事件反映出AI時代地緣政治的複雜性。過去,「供應鏈風險」主要針對外國企業,現在連本土企業也可能因為價值觀分歧而面臨政府制裁。

對於亞洲AI企業來說,這提出了一個重要問題:在技術發展與國家安全需求之間,企業應該如何平衡?Anthropic的案例顯示,即使面臨政府壓力,堅持技術倫理底線仍然可能獲得商業成功。

相关文章

Anthropic發布Opus 4.8,距上一版本僅41天。核心賣點不是更高分數,而是主動標記不確定性的能力。這個設計選擇,正在重新定義企業AI的信任標準。

女性工程師在育嬰假期間,AI編程工具徹底改變了軟體業。她們回到職場時,面對的不只是技能落差,而是一個被重新定義的產業。

中國限制頂尖AI研究者出境,Manus共同創辦人遭禁止離境。史丹佛最新數據顯示中美AI差距縮至2.7%。這場人才封鎖對華人科技世界意味著什麼?

教宗良十四世最新通諭《人類的壯麗》疑似部分由AI撰寫,AI檢測工具顯示第一章62%為AI生成。這不只是宗教問題,更是所有「權威文件」共同面對的挑戰。

观点

分享你对这篇文章的看法

登录加入讨论