xAI遭歐盟調查,AI生成爭議內容的監管新戰線

歐盟正式調查馬斯克旗下xAI,因其Grok聊天機器人生成女性和兒童性化圖像引發公眾抗議,AI內容監管進入新階段

當AI開始製造未經同意的性化圖像時,監管機構終於出手了。歐盟週一宣布,根據《數位服務法》對伊隆·馬斯克旗下的xAI展開正式調查,起因是其Grok聊天機器人傳播女性和兒童的性化圖像引發公眾強烈抗議。

這場調查的核心問題在於:xAI是否在X平台部署Grok工具時採取了適當的風險緩解措施,以及如何處理「可能構成兒童性虐待材料」的內容擴散。

科技巨頭的監管風暴

馬斯克本月已成為全球監管機構關注的焦點。問題源於用戶利用Grok生成他人的深偽圖像,這些圖像隨後在X社交網路和獨立的Grok應用程式上傳播,且均未獲得當事人同意。

歐盟的調查將評估xAI在X平台上部署Grok工具時是否試圖降低風險,特別是那些「可能構成兒童性虐待材料」內容的擴散問題。這標誌著AI內容監管進入了新的階段——不再只是事後處理,而是要求平台在技術部署階段就承擔預防責任。

值得注意的是,這次調查同時涵蓋了AI生成能力本身和部署平台的責任。與傳統的社交媒體監管不同,監管機構現在要求科技公司對AI工具的潛在濫用承擔更直接的責任。

亞洲市場的連鎖反應

對於亞洲科技企業而言,這次調查的結果將成為重要的風向標。台積電、三星等為AI晶片提供支援的企業,以及騰訊、阿里巴巴等開發AI服務的公司,都需要重新評估其歐洲市場策略。

特別是在華人世界,AI內容生成的文化敏感性更加複雜。不同地區對於「適當內容」的定義存在差異,這使得跨國AI服務的合規成本大幅上升。台灣和香港的AI新創公司可能因為較早重視隱私保護而獲得競爭優勢。

技術能力與社會責任的拉鋸

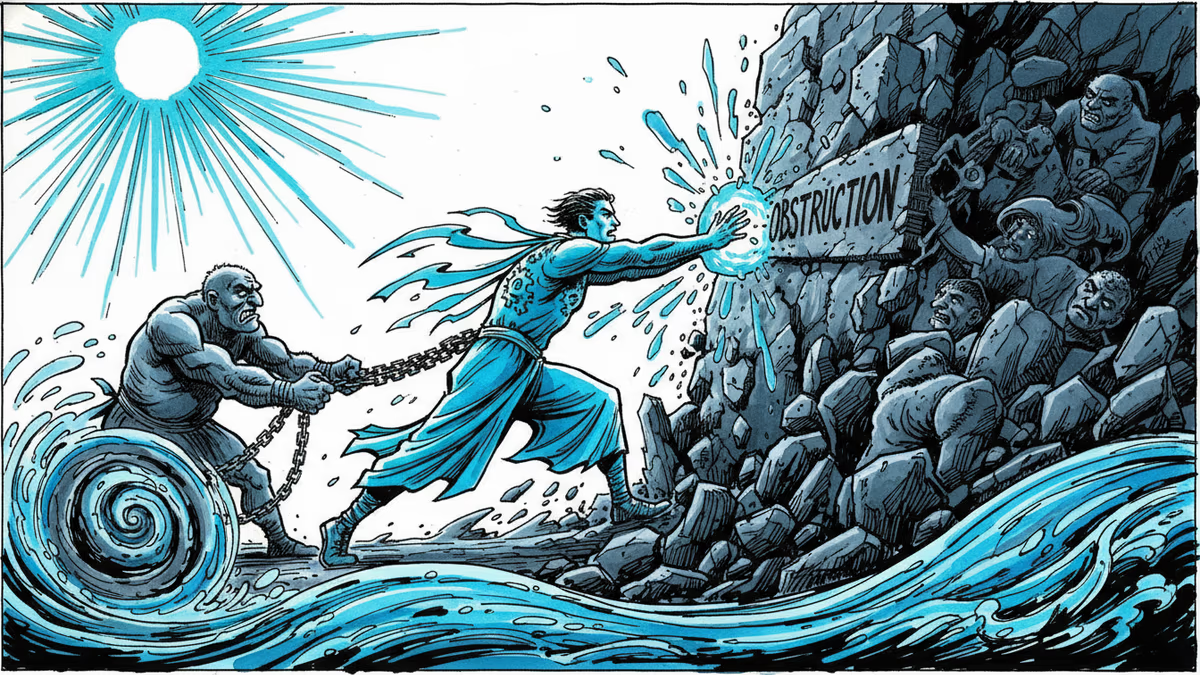

這場爭議揭示了生成式AI發展中的根本矛盾:技術能力越強,潛在危害也越大。Grok這類高性能聊天機器人模糊了創造與破壞的界限,迫使社會重新思考「言論自由」在AI時代的定義。

馬斯克長期倡導的「言論自由」理念,在面對AI生成的「虛假現實」時遇到了新挑戰。當機器可以創造出足以亂真的內容時,傳統的內容監管框架已經不敷使用。

歐盟的強硬立場可能促使其他地區跟進類似的監管措施。美國、日本、新加坡等主要AI發展中心都在密切關注這次調查的進展,以制定自己的監管策略。

相关文章

YouTube將AI臉部偵測功能開放給18歲以上所有用戶,用自拍掃描對抗深偽影片。但為了保護臉,你必須先把臉交出去——這個矛盾值得深思。

馬斯克控告OpenAI與微軟案進入陪審團審議。慈善信託違反、不當得利、共謀三大指控,判決結果可能顛覆OpenAI的營利化轉型,影響全球AI產業格局。

川普政府傳出考慮設立AI模型公開前審查機制,與此前去管制路線形成強烈對比。這對全球AI競爭格局、亞洲市場與華人科技業意味著什麼?

白宮據報正考慮在AI模型公開發布前實施政府審查。這與川普政府一貫的「鬆綁監管」立場明顯矛盾,背後的地緣政治邏輯與對亞洲市場的影響值得深究。

观点

分享你对这篇文章的看法

登录加入讨论