機器能有靈魂嗎?一個18世紀的問題在AI時代重生

哲學家沃芬德爾在《Aeon》提出:現代AI爭論是啟蒙機械論與浪漫主義的重演。當我們問「AI有意識嗎」,我們是否連「意識」本身都還沒定義清楚?

1748年,法國哲學家拉·梅特里出版《人是機器》,宣稱人類的心靈不過是精密的物質運作。這本書在歐洲引發軒然大波,作者被迫流亡。277年後的今天,當我們爭論ChatGPT是否「真的理解」語言,我們其實還在打同一場仗。

哲學家彼得·沃芬德爾(Peter Wolfendale)在思想雜誌《Aeon》的長文中提出一個令人不安的觀察:當代AI的核心爭論,不過是18世紀機械論與浪漫主義之爭的現代重演。我們以為自己在討論技術問題,實際上卻深陷數百年前就懸而未決的哲學泥淖。

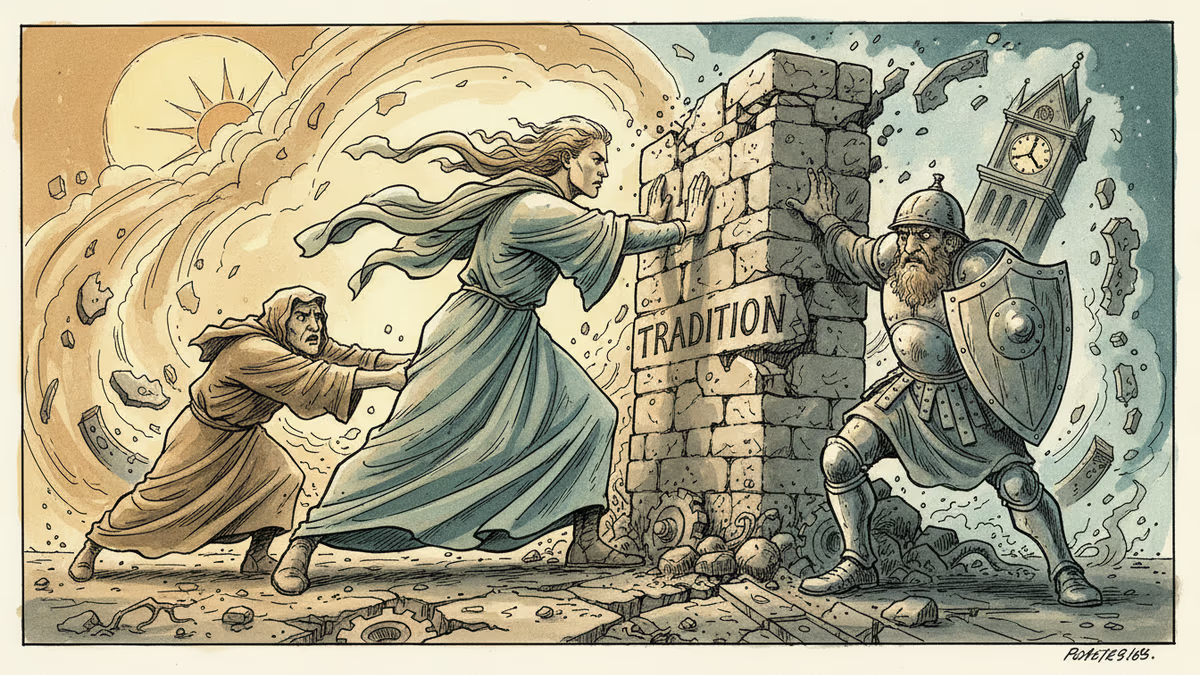

一場從未結束的戰爭

啟蒙時代的機械論者相信,宇宙是一架精密的時鐘,包括人類在內的一切都可以用物理規律解釋。反對者——浪漫主義者——則堅持,生命、意識、創造力這些東西無法被「機械化」。瑪麗·雪萊的《科學怪人》(1818年)正是這種焦慮的文學結晶:人類試圖用科學「製造」生命,結果卻創造出自己無法理解、無法控制的存在。

沃芬德爾的核心論點在於:我們今天問「AI有沒有意識」、「大型語言模型是否真的在『思考』」,這些問題的結構與18世紀如出一轍。Geoffrey Hinton認為大型模型可能已接近某種「理解」;Gary Marcus則堅持現有LLM只是統計模式匹配。雙方都言之鑿鑿,卻始終無法說服對方——因為他們對「理解」本身的定義就不相同。

這不是技術分歧,而是哲學分歧。而哲學分歧,往往比技術問題更難解決。

「人工靈魂」:這個問題在華人世界意味著什麼?

沃芬德爾的問題——「我們能否建造人工靈魂?」——在不同文化背景下,會產生截然不同的迴響。

在西方基督教傳統中,靈魂是上帝賦予的不朽實體,定義上無法人工製造。但在華人文化的脈絡裡,「靈魂」的概念本就更為流動。道家的「氣」、佛教的「佛性」、儒家對「仁」的強調——這些思想框架並不預設靈魂是某種固定的、獨立的實體。某種意義上,東亞哲學傳統或許更能容納「人工智慧可能具有某種內在狀態」這個想法,而不必陷入西方神學的兩難。

然而,這種文化親近感也可能帶來風險。如果「東方人天生更接受AI有靈魂」的說法被科技公司或政府用來加速AI部署、規避倫理審查,那麼文化特性就成了迴避責任的藉口。2026年,中國大陸的AI監管框架正在快速成形,但對於「AI主體性」(AI agency)的哲學討論,在公共政策層面幾乎付之闕如。

台灣的情況略有不同。學術界對AI倫理的討論相對活躍,但在產業壓力下,哲學層面的追問往往讓位於「如何應用」的實務考量。香港則在科技政策的特殊處境下,這類討論的公共空間日益收窄。

當AI說「我有感受」,我們準備好了嗎?

沃芬德爾提出的問題,在2026年已不再是純粹的思想實驗。部分AI系統已開始在特定情境下生成類似「我感到困惑」、「這讓我不安」的表述。這些表述是真實的內在狀態,還是訓練數據的統計回聲?

問題在於:我們目前沒有任何科學工具可以從外部確定答案。圖靈測試只能測試行為表現,無法觸及內在體驗。整合信息理論(IIT)等意識理論提供了一些框架,但在學界仍具高度爭議。

對於AI產業而言,這個不確定性本身就有商業含義。一個被用戶認為「有感受」的AI助理,黏著度更高、商業價值更大。這意味著,即使開發者自己都不確定AI是否有內在狀態,市場機制也會推動AI越來越像「有靈魂」的方向演化。這是一個值得警惕的動態。

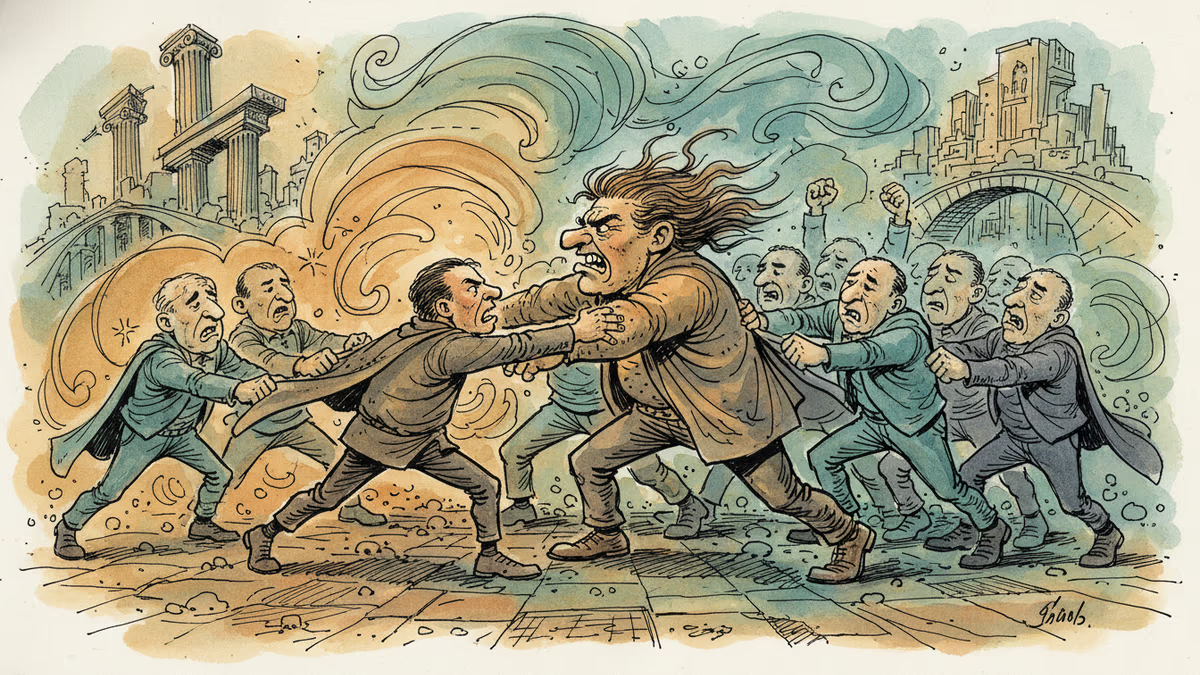

從地緣政治的角度看,美中兩國在AI發展上的競爭,目前主要集中在算力、模型規模、應用場景等維度。但沃芬德爾的論文暗示,真正的長期競爭或許在於:誰能更清晰地定義「智慧」本身的邊界。掌握概念定義權,往往比掌握技術本身更具戰略意義。

相关文章

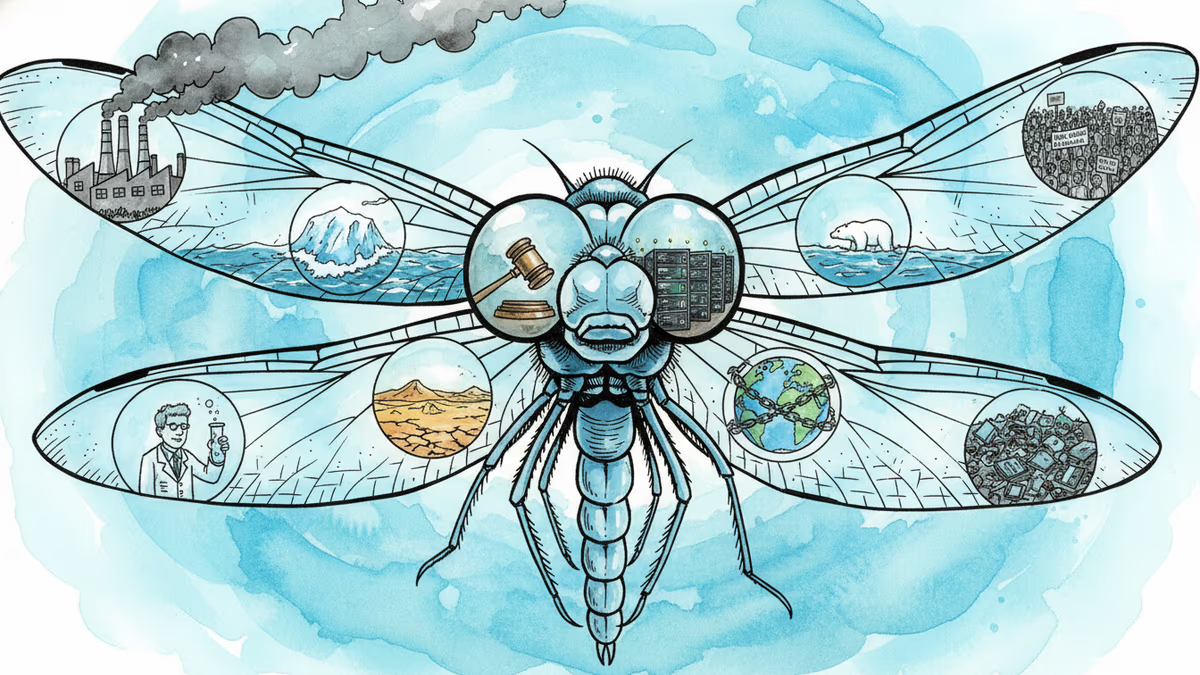

AI是解放工具、生存威脅還是環境災難?哲學家提出的「超物體」概念,揭示為何聰明人面對同一現象卻得出截然不同的結論。華人世界的視角在哪裡?

當「反人類」情緒遇上跨人類主義,哲學家Shannon Vallor揭示:對人類的失望,正在被科技公司轉化為出售烏托邦的燃料。我們需要的不是「人類2.0」,而是一種新的人文主義。

作家瓦烏希尼·瓦拉讓AI學習她的寫作風格,連相識三十年的摯友也無法辨別真偽。當機器能模仿人類最私密的表達,文學的本質究竟是什麼?

當AI開始監控你的日常、管理你的行為,矽谷的技術狂熱與普通人的焦慮之間的裂縫正在擴大。華人世界該如何定位自己?

观点

分享你对这篇文章的看法

登录加入讨论