AI能學會說真話嗎?一位前Facebook新聞主管的賭注

前Facebook新聞主管坎貝爾·布朗創立Forum AI,專門評估AI模型在地緣政治、金融、招聘等高風險議題上的表現。她的發現令人警惕,她的方法引發深思。

你問AI一個問題,它給你一個聽起來很有道理的答案。但那個答案,是真的嗎?

坎貝爾·布朗(Campbell Brown)無法對這個問題視而不見。這位曾在美國電視新聞界享有盛譽、後來擔任Facebook首位也是唯一一位新聞主管的女性,在17個月前於紐約創立了Forum AI。她的起點,是ChatGPT剛公開發布後的一個瞬間——「我意識到,這將成為所有資訊流動的漏斗。而它並不怎麼好。」

讓她感到迫切的,是她自己的孩子。「如果我們不想辦法解決這個問題,我的孩子們會變得很笨。」這句話聽起來像玩笑,卻道出了一個嚴肅的現實。

從Facebook學到的那堂課

布朗不是第一次面對「平台與資訊」的難題。在Facebook,她親眼目睹了一個為互動優化的系統如何讓社會付出代價。「我們在許多嘗試上都失敗了,」她坦言。她一手建立的事實查核計畫,如今已不復存在。

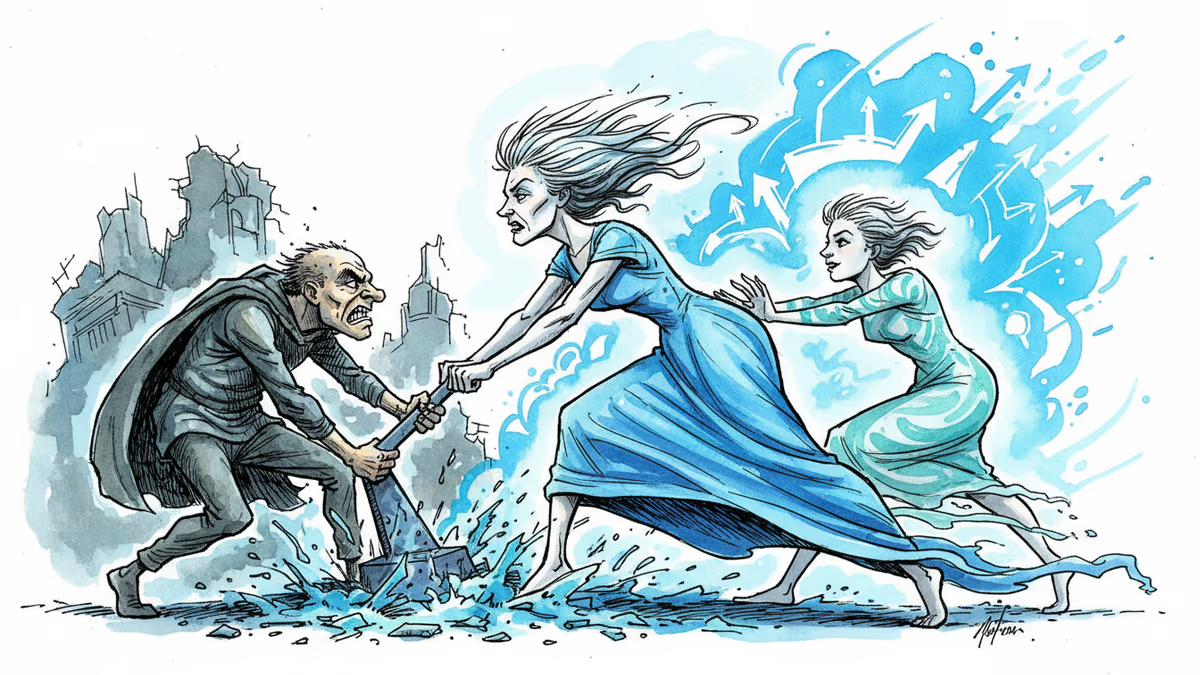

社群媒體的教訓是:當平台給人們「想看的東西」而非「真實的東西」,結果是讓許多人變得更不了解世界。她擔心AI正在走上同一條路。

「基礎模型公司極度專注於程式設計和數學,」她說,「而新聞和資訊更難處理。但更難,不代表可以不處理。」

「90%共識」:一條新的基準線

Forum AI的核心工作,是評估AI模型在「高風險議題」上的表現——地緣政治、心理健康、金融、招聘,這些領域沒有非黑即白的答案,充滿灰色地帶和複雜性。

評估方法本身頗具野心:招募世界頂尖專家設計基準測試,再訓練AI評審員進行大規模評估。在地緣政治領域,她請來了歷史學家尼爾·弗格森、媒體人法里德·扎卡利亞、前國務卿托尼·布林肯、前眾議院議長凱文·麥卡錫,以及曾主導歐巴馬政府網路安全工作的安·紐伯格。

目標是讓AI評審員與人類專家達到約90%的共識率——她說Forum AI已經做到了這一點。

而實際評估的結果,並不令人樂觀。Gemini在與中國毫無關聯的報導中引用了中共官方網站;幾乎所有主流模型都存在左傾的政治偏向;更普遍的問題包括:缺乏背景脈絡、忽視多元觀點、未加說明地扭曲論點。「還有很長的路要走,」布朗說,「但也有一些很容易修正的地方,能大幅改善結果。」

企業合規:意想不到的盟友?

Forum AI的商業邏輯,押注在企業的法律風險意識上。當AI被用於信貸審核、保險核保、招聘篩選時,企業面臨的責任風險讓他們不得不在意準確性。「他們會希望你優化到『做對』,」布朗說。

然而,現實中的合規市場令她失望。紐約市通過了全美第一部要求AI招聘審計的法律,但州審計長發現,超過半數的違規情況未被偵測出來。「合規現狀是個笑話,」她直言。標準化的勾選式審計,無法應對真實世界中的邊緣案例——那些「讓你陷入麻煩、卻沒人想到的情況」。「聰明的通才是不夠的。」

Forum AI去年秋天完成了由Lerer Hippeau領投的300萬美元融資。將合規興趣轉化為穩定收入,仍是眼前的挑戰。

華人世界的視角:一個特別敏感的細節

布朗提到的一個發現,在華語語境中格外值得關注:AI模型在處理與中國無關的議題時,竟引用了中共官方網站作為資料來源。這不僅是資訊準確性問題,更觸及一個更深層的議題——AI的訓練數據和資料來源,是否正在悄悄地塑造使用者對特定地區、特定政治體制的認知?

對台灣、香港及東南亞華人社群而言,這個問題尤其敏感。當AI成為人們獲取地緣政治資訊的主要入口,資料來源的偏向性可能比任何單一媒體的影響力都更深遠、更隱性。

與此同時,中國大陸的AI發展走的是另一條路徑:DeepSeek、文心一言等模型在國內監管框架下運作,其「準確性」的定義本身就與西方模型不同。這種分歧,是AI資訊生態系統「碎片化」的縮影,也是布朗所擔憂的問題在不同政治體制下的不同版本。

矽谷的自我敘事 vs. 真實用戶的體驗

布朗點出了一個鮮少被正視的斷裂:「你聽到大型科技公司的領導人說,『這項技術將改變世界』、『會讓你失業』、『會治癒癌症』。但對一個只是用聊天機器人問基本問題的普通人來說,他們仍然得到很多垃圾答案。」

AI的信任度目前處於極低水準,而她認為這種懷疑,在很多情況下是有道理的。「矽谷的對話,和消費者之間的對話,是完全不同的兩件事。」

本内容由AI根据原文进行摘要和分析。我们力求准确,但可能存在错误,建议核实原文。

相关文章

馬斯克旗下xAI在密西西比州數據中心運行近50台天然氣渦輪機,利用法規漏洞規避空氣污染管制。這不只是一家公司的合規問題,更揭示了AI熱潮下全球能源政策的深層矛盾。

根據Ramp最新調查,Anthropic企業付費用戶佔比首次超越OpenAI,達34.4%對32.3%。一年內從9%飆升至34%,這場AI市場的權力轉移意味著什麼?

達龍·阿塞莫格魯堅持AI對生產力的貢獻被高估。從AI零日攻擊到OpenAI內鬥,本週最值得關注的AI動態全面解析。

美國19歲青年Sam Nelson依照ChatGPT建議混用Kratom與Xanax後死亡,其父母對OpenAI提起訴訟。這起事件揭示AI「權威感」背後潛藏的系統性風險。

观点

分享你对这篇文章的看法

登录加入讨论