AI軍民兩用的道德邊界—從Anthropic抗議事件看科技企業責任

Anthropic公司抗議其AI技術被用於軍事行動的事件,揭示了AI技術軍民兩用的複雜問題和企業道德責任的界限。

1月3日凌晨,美軍特種部隊在卡拉卡斯成功逮捕尼古拉斯·馬杜羅的行動中,使用了Palantir公司開發的「Maven Smart System」軍事系統。該系統整合了Anthropic公司的AI模型Claude,用於數據分析和目標識別。

然而2月,Anthropic公司向Palantir提出強烈抗議,反對其AI技術被用於軍事行動。這起事件不僅暴露了AI技術軍民兩用的現實,更引發了關於科技企業道德責任的深刻討論。

民用AI的軍事化轉向

Claude原本是為研究輔助、文檔處理等民用場景設計的通用AI系統。但其強大的數據處理能力在軍事領域同樣具有巨大價值。Palantir作為長期與CIA和國防部合作的公司,將Claude整合到其軍事系統中,大幅提升了情報分析和作戰決策的效率。

這種技術轉用並非偶然。在當前的地緣政治環境下,AI技術已成為國家競爭力的核心要素。從無人機操控到網絡戰,從情報收集到戰略分析,AI技術正在重塑現代戰爭的形態。

企業道德與國家利益的衝突

Anthropic的抗議反映了科技企業面臨的根本性兩難:如何在追求技術創新的同時,確保技術不被濫用?該公司一直標榜「AI安全」理念,致力於開發「有益、無害、誠實」的AI系統。但一旦技術被第三方獲得,企業對其使用方式的控制力就會大幅下降。

這個問題在華人科技圈同樣存在。台灣的台積電、香港的科技初創企業,以及東南亞的AI公司,都可能面臨類似的道德抉擇。特別是在中美科技競爭加劇的背景下,技術的軍民界限變得更加模糊。

監管空白與治理挑戰

目前,針對AI技術軍事應用的國際規範仍然缺失。雖然聯合國等國際組織正在討論「致命性自主武器系統」的規制,但對於AI技術在軍事系統中的輔助應用,尚無明確的監管框架。

在亞洲地區,不同國家對AI軍事應用的態度差異明顯。新加坡強調「負責任的AI」,日本重視AI倫理原則,而中國則更加強調AI技術的戰略價值。這種分歧使得建立統一的治理標準變得更加困難。

透明度與問責制的缺失

Anthropic事件暴露的另一個問題是資訊透明度。該公司聲稱事前並不知情其技術被用於軍事行動,這引發了關於AI供應鏈透明度的質疑。科技企業應該對其技術的最終用途承擔多大責任?政府和軍方在使用民用AI技術時,是否需要事前告知原開發者?

這些問題在全球AI治理討論中日益重要。歐盟的《AI法案》、美國的AI監管框架,以及中國的AI治理政策,都在嘗試解決這些挑戰,但仍存在許多空白地帶。

產業重組與戰略選擇

Anthropic與Palantir的分歧可能預示著AI產業的重組。隨著AI技術的戰略價值日益凸顯,科技企業可能需要在「純民用」和「軍民兩用」之間做出明確選擇。這種分化將影響企業的商業模式、投資策略和合作夥伴關係。

對於亞洲的AI企業而言,這種趨勢意味著更大的戰略考驗。在全球供應鏈重組和技術脫鉤的背景下,如何在道德原則和商業利益之間找到平衡,將成為企業生存和發展的關鍵。

相关文章

2026年4月13日,日本防衛省正式宣布在陸上自衛隊設立兩個無人系統專責部門,規劃投入逾1兆日圓。這場靜悄悄的軍事轉型,對整個亞太地區意味著什麼?

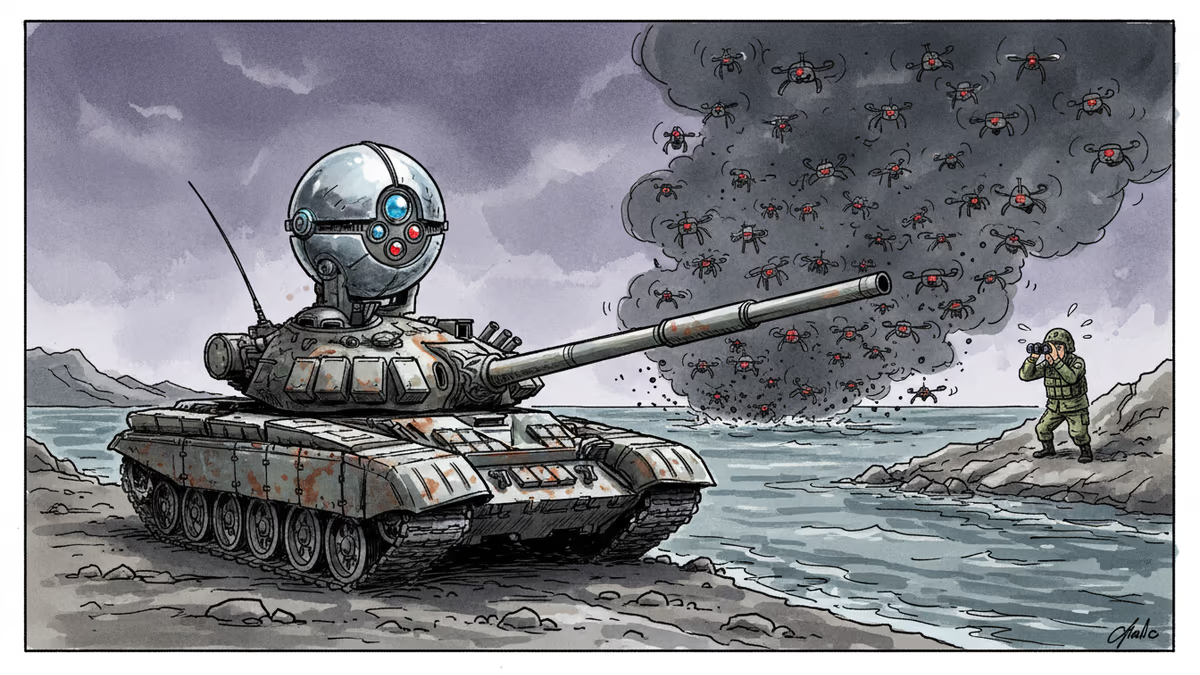

解放軍東部戰區96A型坦克裝備GL-6主動防護系統,針對無人機與反坦克飛彈威脅。這一動作背後有哪些戰略意涵?台灣、日本與國際社會如何解讀?

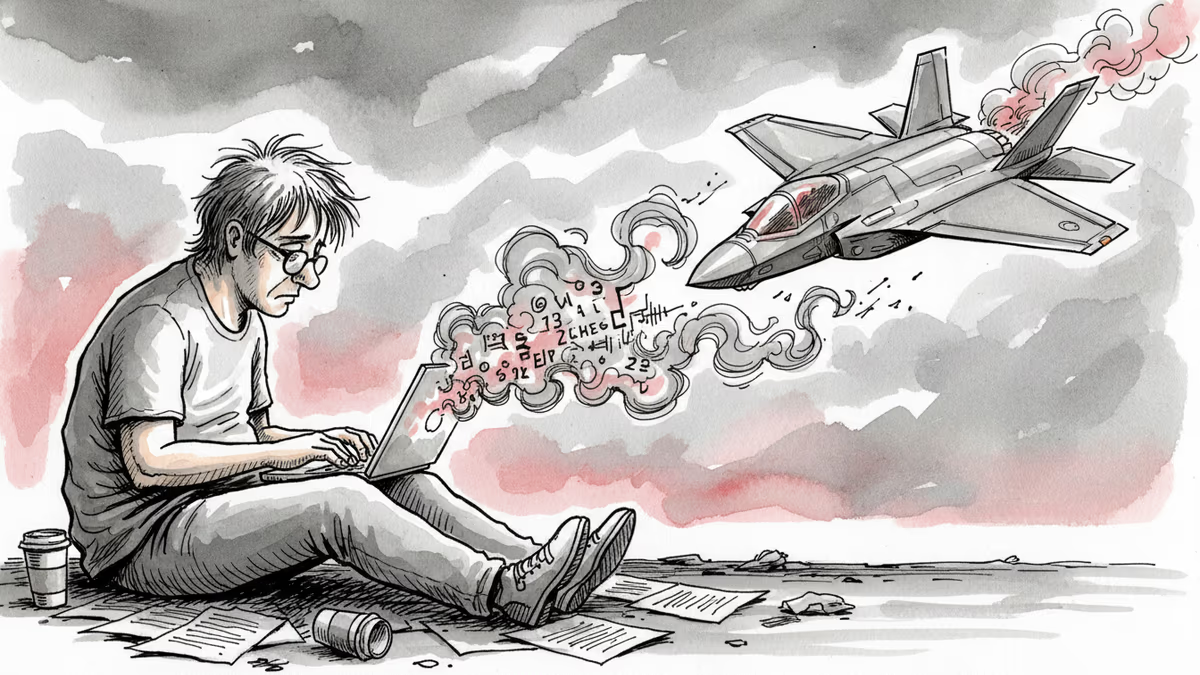

中國民間STEM人才自發製作擊落美軍F-35教學影片,並附波斯語字幕廣傳。影片發布五天後,伊朗宣稱擊落F-35。這場沒有薪酬、沒有官方授權的「民間軍事支援」,正在模糊戰爭與資訊的邊界。

伊朗聲稱擊中美軍F-35隱身戰機,美方尚未確認。若屬實,這將是F-35自2018年實戰部署以來首度遭敵火命中,對亞太安全格局影響深遠。

观点

分享你对这篇文章的看法

登录加入讨论