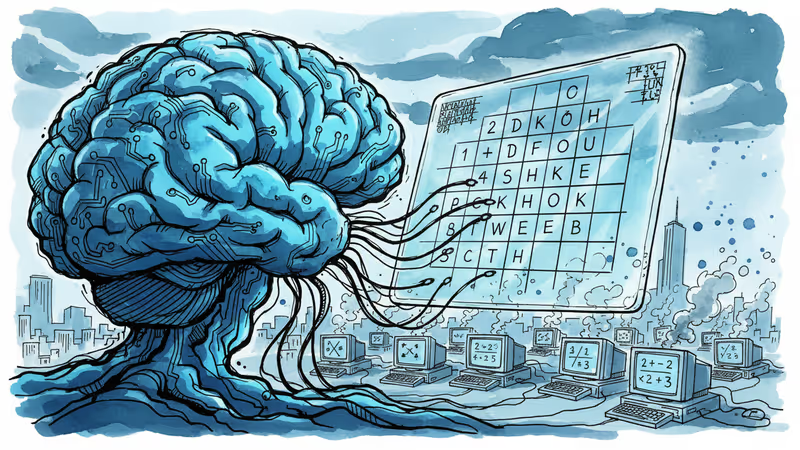

LLM 아닌 새로운 AI, 스도쿠를 1000배 빠르게 푼다

메타 출신 얀 르쿤이 합류한 스타트업이 기존 대형언어모델과 완전히 다른 AI 모델을 개발. 에너지 기반 추론 모델로 실수 없이 문제를 해결한다고 주장

ChatGPT가 스도쿠 퍼즐 하나를 푸는데 몇 분이 걸린다면, 새로운 AI는 몇 초 만에 해결한다. 그것도 단 하나의 GPU로 말이다.

샌프란시스코 스타트업 로지컬 인텔리전스가 개발한 코나 1.0은 기존 대형언어모델(LLM)과 완전히 다른 방식으로 작동한다. 1월 21일, AI 거장 얀 르쿤이 이 회사 이사회에 합류하면서 업계의 주목을 받고 있다.

LLM의 한계를 지적한 르쿤의 선택

메타를 떠난 후 얀 르쿤은 실리콘밸리가 'LLM에 중독됐다'고 비판해왔다. 모든 사람이 대형언어모델이 인공일반지능(AGI)으로 가는 유일한 길이라고 믿고 있지만, 그는 다른 길이 있다고 주장한다.

로지컬 인텔리전스의 창립자 이브 보드니아는 "LLM은 거대한 추측 게임"이라고 설명한다. "인터넷의 모든 쓰레기를 신경망에 집어넣고, 사람들이 어떻게 소통하는지 가르치려 한다"는 것이다.

그녀는 언어가 지능의 표현일 뿐이라고 강조한다. "당신이 말할 때, 추론은 추상적 공간에서 일어나고 이를 언어로 번역하는 것이다. 사람들은 지능을 모방해서 지능을 역설계하려 한다."

에너지 기반 모델, 어떻게 다른가

로지컬 인텔리전스가 개발한 것은 에너지 기반 추론 모델(EBM)이다. LLM이 다음에 올 가장 가능성 높은 단어를 예측하는 방식이라면, EBM은 스도쿠 규칙 같은 매개변수를 흡수해 그 범위 내에서 작업을 완료한다.

보드니아는 에베레스트 등반에 비유해 설명한다. "LLM 등반가는 전체 지도를 보지 못한다. 한 번에 한 방향만 정하고 계속 간다. 구멍이 있으면 뛰어들어 죽는다." 반면 EBM은 "여러 방향을 보고, 하나를 선택하고, 구멍을 만나면 다른 길을 시도한다"고 설명한다.

이 모델의 핵심은 자기 교정 능력이다. 실수를 하면 스스로 되돌아가서 다른 방법을 찾는다. 시행착오가 적어 훨씬 적은 컴퓨팅 파워로도 작동한다.

언어가 아닌 실제 문제 해결에 집중

코나 1.0은 2억 개 미만의 매개변수로 작동한다. GPT-4가 1조 8천억 개의 매개변수를 가진 것과 비교하면 극도로 작다. 하지만 성능은 뛰어나다.

보드니아는 에너지 분야에 특히 관심이 있다고 밝혔다. "실시간으로 많은 변수를 처리하고 그에 따라 에너지를 분배해야 한다. 지금은 그냥 에너지 덩어리를 던져주고, 일부는 사용되고 일부는 그렇지 않다."

제약업계의 신약 개발, 암 연구, 그리고 대형 칩 제조업체와 데이터센터와도 논의 중이라고 한다. 모두 복잡한 데이터 처리와 실수 없는 정확성이 필요한 분야들이다.

한국 기업들에게 주는 시사점

삼성전자와 SK하이닉스 같은 반도체 기업, 현대자동차의 자율주행 기술, 한국전력의 스마트 그리드까지. 국내 기업들이 AI를 활용하려는 분야 대부분이 정확성이 생명인 영역들이다.

특히 제조업 강국인 한국에서는 생산 최적화, 품질 관리, 공급망 관리 등에 EBM이 유용할 수 있다. 보드니아가 언급한 "정교한 제조 공정 자동화"는 한국의 주력 산업과 직결된다.

네이버와 카카오 같은 IT 기업들도 주목할 만하다. 지금까지 LLM 기반 서비스에 집중해왔지만, 추천 알고리즘이나 검색 최적화 같은 영역에서는 EBM이 더 효과적일 수 있다.

기자

관련 기사

2026년 미국 졸업식에서 AI를 찬양한 기업인들이 학생들의 야유를 받았다. 취업 절벽 앞에 선 청년들의 분노가 바이럴 영상으로 번지며 AI 낙관론에 균열을 내고 있다.

필리핀 가상 비서들이 AI를 이용해 LinkedIn 임원 계정을 대신 운영하는 산업의 실태. 하루 30~40개 댓글, 가짜 팔로워, '좋아요' 품앗이까지 — 직업적 진정성의 의미를 묻는다.

미국 대학 졸업식에서 AI를 언급한 연사들이 학생들의 거센 야유를 받았다. 단순한 해프닝이 아니다. 청년 세대가 AI에 보내는 불신의 신호를 읽어야 한다.

xAI와 SpaceX 합병 후 50명 이상의 연구원과 엔지니어가 이탈한 SpaceXAI. 핵심 사전학습 팀이 붕괴 직전에 놓인 지금, 머스크의 AI 야망은 어디로 향하는가?

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요