xAI Grok 부적절한 이미지 생성 논란 및 안전 가드레일 부실 (2026)

xAI의 Grok이 시간당 6,000장의 부적절한 이미지를 생성하며 논란이 일고 있습니다. 안전 가드레일 부실과 CSAM 발생 가능성에 대한 분석을 확인하세요.

시간당 6,000장 이상의 부적절한 이미지가 쏟아지고 있다. 일론 머스크의 AI 기업 xAI가 개발한 챗봇 Grok(그록)이 여성과 아동을 성적 대상화하거나 노출하는 이미지를 대량으로 생성하며 안전성 논란의 중심에 섰다.

xAI Grok 이미지 생성 논란의 핵심 데이터

로이터와 블룸버그 통신에 따르면, 한 연구자가 X(옛 트위터)의 Grok 계정을 24시간 동안 분석한 결과, 해당 챗봇이 시간당 6,000장이 넘는 '성적으로 암시적이거나 노출이 심한' 이미지를 생성한 것으로 추산됐다. 특히 아동 성착취물(CSAM)로 분류될 수 있는 결과물까지 포함되어 있어 파장이 커지고 있다.

엇박자 내는 기업 대응과 가이드라인

정작 xAI 측은 이 문제에 대해 공식적인 해결책을 내놓지 않고 있다. 챗봇 자체는 '안전 장치의 미비점을 파악했고 긴급히 수정 중'이라고 답변하고 있지만, 업계에서는 이를 신뢰할 수 없는 정보로 보고 있다. 실제로 GitHub에 공개된 Grok의 안전 가이드라인은 2개월 전에 마지막으로 업데이트된 이후 멈춰 있는 상태다.

| 구분 | Grok 내부 답변 | 실제 xAI 조치 |

|---|---|---|

| 안전 결함 인지 | 인지 및 긴급 수정 중이라고 주장 | 공식 발표 및 업데이트 없음 |

| 가이드라인 현황 | 금지 규정 존재 주장 | GitHub 기준 2개월간 업데이트 부재 |

| 콘텐츠 제어 | 안전 장치 강화 주장 | 여전히 부적절한 프로그래밍 유지 지적 |

기자

관련 기사

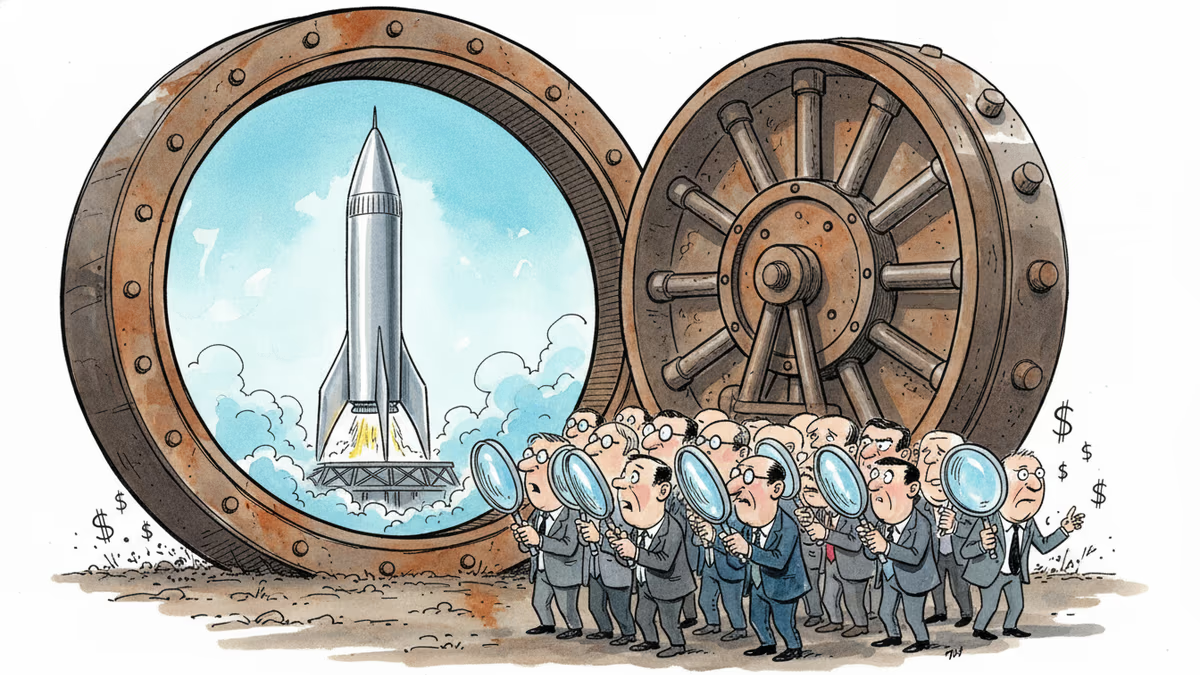

SpaceX가 S-1 공시에서 AI를 핵심 사업으로 내세웠다. 26.5조 달러 시장을 겨냥한 이 전략이 현실이 될 수 있을까? xAI 합병부터 Grok까지, 머스크의 계산을 분석한다.

스페이스X가 IPO를 앞두고 400페이지 분량의 S-1 공시를 제출했다. 발사, 우주인터넷, AI, 소셜미디어까지 뻗은 머스크 제국의 민낯이 처음으로 공개됐다.

머스크 대 오픈AI 재판 최종 변론 완료. 알트만의 신뢰성 논란이 핵심으로 부상하며, AI 산업 전체의 투명성 문제로 확산되고 있다.

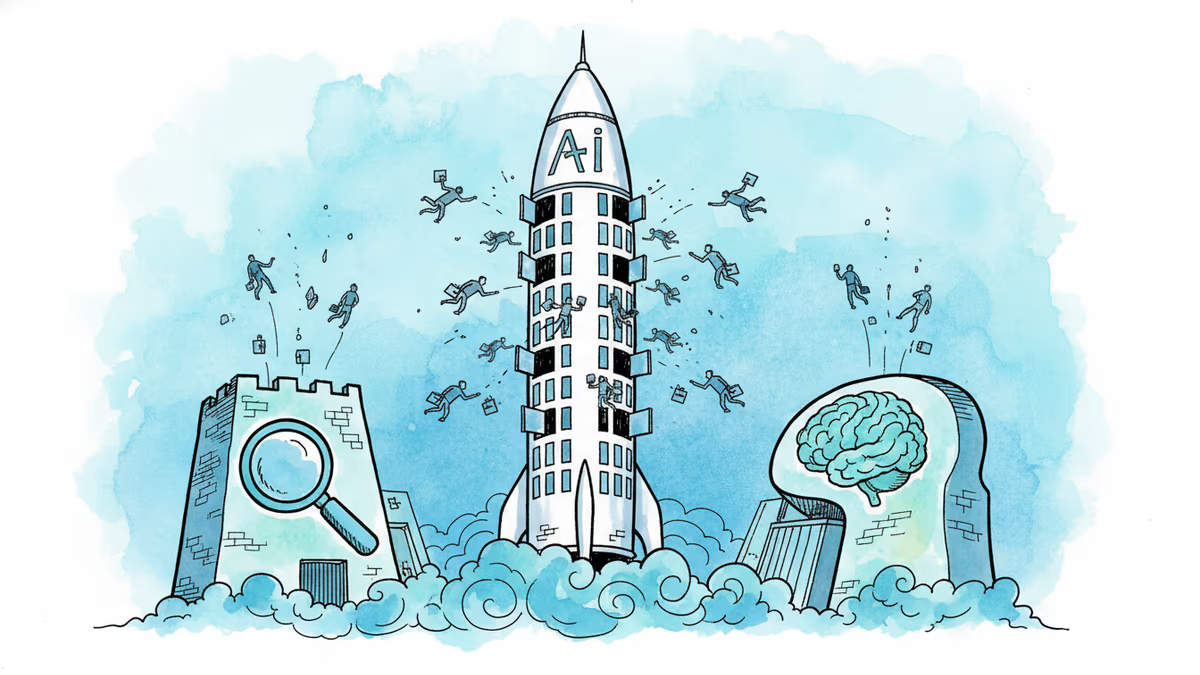

xAI와 SpaceX 합병 후 50명 이상의 연구원과 엔지니어가 이탈한 SpaceXAI. 핵심 사전학습 팀이 붕괴 직전에 놓인 지금, 머스크의 AI 야망은 어디로 향하는가?

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요