일론 머스크가 캘리포니아와 맞붙은 진짜 이유

xAI가 AI 훈련 데이터 공개 의무화법에 반발한 배경과 AI 업계에 미치는 파급효과를 분석한다

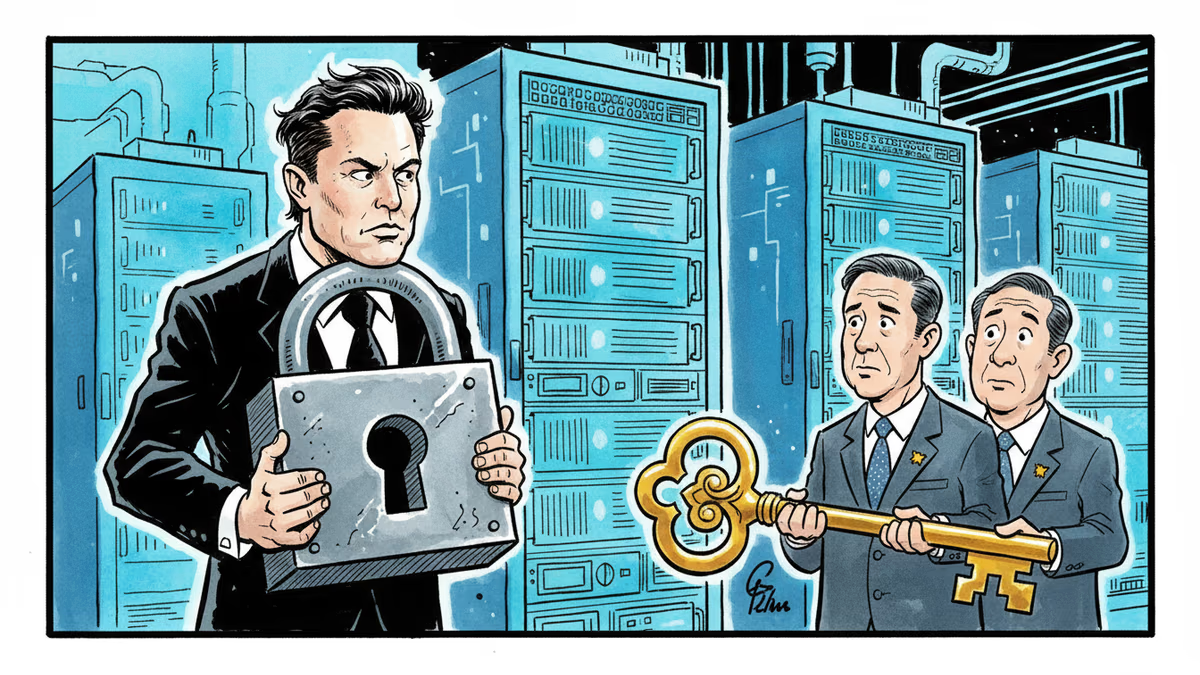

일론 머스크의 xAI가 캘리포니아 법원에서 패했다. AB 2013이라는 법안 시행을 막으려던 가처분 신청이 기각된 것이다. 이 법은 AI 기업들에게 훈련 데이터의 출처를 공개하도록 강제한다.

머스크가 이토록 격렬하게 반발한 이유는 뭘까?

공개해야 하는 것들

AB 2013은 캘리포니아에서 접근 가능한 AI 모델을 만든 기업들에게 상당히 구체적인 정보 공개를 요구한다. 어떤 데이터셋을 사용했는지, 언제 수집했는지, 현재도 수집 중인지부터 시작해서 저작권이나 특허로 보호받는 데이터가 포함됐는지까지 밝혀야 한다.

개인정보 포함 여부, 데이터 구매나 라이선스 여부, 심지어 합성 데이터 비율까지 공개 대상이다. 합성 데이터 비율은 AI 모델의 품질을 가늠하는 지표로 활용될 수 있다.

xAI 측은 이런 공개 요구가 "신중하게 보호해온 영업비밀"을 강제로 드러내는 것이라고 주장했다.

머스크의 딜레마

흥미롭게도 머스크는 평소 AI 투명성을 강조해왔다. OpenAI를 비영리로 설립했던 이유도 "AI의 이익이 모든 인류에게 돌아가야 한다"는 신념 때문이었다. 그런데 왜 지금은 정반대 입장을 취하고 있을까?

답은 경쟁 구도에 있다. 현재 AI 시장에서 xAI는 후발주자다. OpenAI, 구글, 앤트로픽 같은 선두 기업들과 경쟁하려면 독창적인 훈련 방식이나 데이터 조합이 핵심 무기가 될 수밖에 없다.

특히 머스크는 트위터(현 X) 데이터를 xAI 훈련에 활용하고 있다. 이런 독특한 데이터 소스 조합이 공개되면 경쟁사들이 유사한 전략을 쉽게 모방할 수 있다.

업계 전체의 고민

사실 이 문제는 xAI만의 고민이 아니다. 모든 AI 기업들이 같은 딜레마에 직면해 있다. 훈련 데이터 공개는 투명성과 책임감을 높이지만, 동시에 경쟁력의 핵심을 노출시킨다.

더 복잡한 건 저작권 문제다. 많은 AI 모델들이 인터넷에서 수집한 텍스트, 이미지, 코드를 훈련에 사용했는데, 이 중 상당수는 저작권 보호를 받는다. 공개 의무가 생기면 이런 법적 리스크가 표면화될 수 있다.

국내 기업들도 예외가 아니다. 네이버의 HyperCLOVA나 카카오브레인의 KoGPT 같은 모델들도 비슷한 투명성 요구에 직면할 가능성이 높다.

기자

관련 기사

SpaceX가 S-1 공시에서 AI를 핵심 사업으로 내세웠다. 26.5조 달러 시장을 겨냥한 이 전략이 현실이 될 수 있을까? xAI 합병부터 Grok까지, 머스크의 계산을 분석한다.

2026년 미국 졸업식에서 AI를 찬양한 기업인들이 학생들의 야유를 받았다. 취업 절벽 앞에 선 청년들의 분노가 바이럴 영상으로 번지며 AI 낙관론에 균열을 내고 있다.

스페이스X가 IPO를 앞두고 400페이지 분량의 S-1 공시를 제출했다. 발사, 우주인터넷, AI, 소셜미디어까지 뻗은 머스크 제국의 민낯이 처음으로 공개됐다.

필리핀 가상 비서들이 AI를 이용해 LinkedIn 임원 계정을 대신 운영하는 산업의 실태. 하루 30~40개 댓글, 가짜 팔로워, '좋아요' 품앗이까지 — 직업적 진정성의 의미를 묻는다.

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요