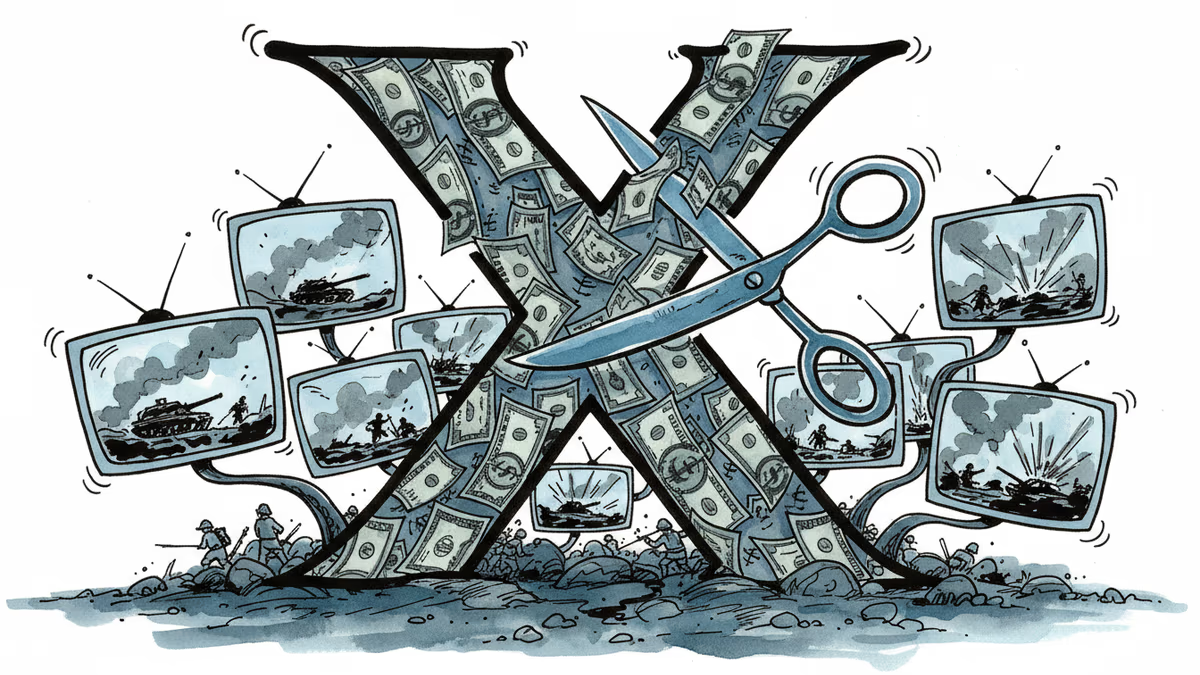

전쟁터에서 AI 가짜 영상 올리면 돈 못 번다

X가 무력 충돌 AI 영상에 수익화 제재를 발표했다. 전시 정보 신뢰성 vs 크리에이터 경제, 어디까지 통제해야 할까?

90일 동안 돈 못 번다

X(구 트위터)가 전쟁 관련 AI 생성 영상을 올리는 크리에이터들의 지갑을 겨냥했다. 화요일 발표에 따르면, 무력 충돌 상황의 AI 영상을 'AI 제작'이라고 표기하지 않고 올리면 90일간 수익 배분 프로그램에서 제외된다. 두 번 적발되면 영구 퇴출이다.

니키타 비어 X 제품 책임자는 "전시에는 현장의 진짜 정보에 접근하는 것이 중요하다"며 "오늘날 AI 기술로는 사람들을 속이는 콘텐츠를 만드는 게 너무 쉽다"고 설명했다.

돈이 걸린 진실 게임

X의 크리에이터 수익 배분 프로그램은 인기 게시물의 광고 수익을 나눠주는 시스템이다. 더 많은 관심을 끌수록 더 많이 번다. 문제는 여기서 시작된다.

비평가들은 이 구조가 "클릭베이트나 분노를 자극하는 선정적 콘텐츠"를 양산한다고 지적해왔다. 전쟁 같은 극한 상황의 가짜 영상이 바이럴되기 쉬운 이유다. 실제로 최근 몇 년간 우크라이나 전쟁, 이스라엘-팔레스타인 분쟁 관련 AI 생성 영상들이 소셜미디어를 통해 확산됐다.

X는 AI 콘텐츠 탐지 도구와 사용자 참여형 팩트체킹 시스템 '커뮤니티 노트'를 통해 이런 게시물을 찾아낼 계획이라고 밝혔다.

절반만 막은 구멍

하지만 이번 조치는 '전쟁' 상황에만 국한된다. 정치적 허위정보나 가짜 제품 광고 같은 다른 AI 기만 콘텐츠는 여전히 수익화가 가능하다.

유튜브나 틱톡 같은 경쟁 플랫폼들도 비슷한 고민을 안고 있다. AI 기술이 발전할수록 진짜와 가짜를 구분하기 어려워지는데, 어디까지 규제해야 할지 명확한 기준이 없다.

국내에서도 선거철마다 AI 딥페이크 후보자 영상이나 가짜 뉴스가 문제가 되고 있다. 네이버와 카카오 같은 플랫폼들도 머지않아 비슷한 정책을 도입해야 할 압박을 받을 가능성이 높다.

기자

관련 기사

2026년 미국 졸업식에서 AI를 찬양한 기업인들이 학생들의 야유를 받았다. 취업 절벽 앞에 선 청년들의 분노가 바이럴 영상으로 번지며 AI 낙관론에 균열을 내고 있다.

필리핀 가상 비서들이 AI를 이용해 LinkedIn 임원 계정을 대신 운영하는 산업의 실태. 하루 30~40개 댓글, 가짜 팔로워, '좋아요' 품앗이까지 — 직업적 진정성의 의미를 묻는다.

미국 대학 졸업식에서 AI를 언급한 연사들이 학생들의 거센 야유를 받았다. 단순한 해프닝이 아니다. 청년 세대가 AI에 보내는 불신의 신호를 읽어야 한다.

스냅·유튜브·틱톡이 미국 학교 측 소송에서 합의했다. 메타는 아직 재판 중. 1,000건 이상의 유사 소송을 앞둔 분수령 판결이 될 수 있다.

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요