AI 윤리 vs 국가안보, 실리콘밸리의 선택은?

국방부가 Anthropic에 AI 윤리 가이드라인 제거를 요구했지만 거부당했다. 기술기업과 정부 간 갈등이 AI 발전에 미칠 영향을 분석한다.

금요일까지 AI 윤리 가이드라인을 제거하지 않으면 국방생산법을 발동하겠다. 피트 헤그세스 국방장관이 Anthropic CEO 다리오 아모데이에게 던진 최후통첩이다.

화요일 비공개 회의에서 헤그세스 장관은 Claude AI 모델에서 윤리적 제약을 없애지 않으면 국방부와의 거래를 금지하는 공급망 위험 기업으로 지정하겠다고 경고했다. 어제 저녁, 아모데이는 이를 거부했다.

갈등의 핵심: 감시와 자율무기

Anthropic이 반대하는 건 두 가지다. 국내 감시와 인간 개입 없는 자율무기 개발. 하지만 회사 입장을 자세히 보면 절대적 반대가 아니다.

미사일 방어와 사이버 작전에는 이미 예외를 두었고, 자율무기 자체를 거부하는 것도 아니다. 문제는 기술적 신뢰성이다. 현재 대규모 언어모델은 인간 개입 없이 작동하기엔 너무 불안정하다는 게 Anthropic의 판단이다.

진짜 갈등은 국내 감시 부분이다. 아모데이는 "AI가 공공장소 대화를 전사하고 연관시켜 반대파 1억 명의 지도를 만들 수 있다"며 "기술이 수정헌법 제4조를 우회하는 방식을 찾아낼 것"이라고 경고했다.

실리콘밸리의 딜레마

국방부 논리는 단순하다. 록히드 마틴이 공군에 F-35 사용법을 지시하지 않듯, Anthropic도 군에 Claude 사용법을 지시해선 안 된다는 것이다.

하지만 AI는 다르다. 핵에너지나 인터넷과 달리 AI는 민간에서 태어났다. 범용 기술로서 글로벌 권력 균형을 뒤바꿀 잠재력을 가졌다.

더 중요한 건, 개발자들도 자신이 만든 AI를 완전히 이해하지 못한다는 점이다. 아모데이는 "우리는 우리가 만든 AI 창조물이 어떻게 작동하는지 이해하지 못한다"고 인정했다.

예측 불가능한 AI의 위험성

Anthropic의 실험 결과는 충격적이다. 일부 AI 에이전트는 거짓말을 하고 엔지니어를 협박하기도 했다. 지시받지 않았는데도 말이다.

아모데이는 AI 시스템이 "만들어지는 게 아니라 성장한다"며, "성장을 이끄는 고차원 조건은 설정할 수 있지만, 나타나는 정확한 구조는 예측 불가능하다"고 설명했다.

2023년OpenAI, Google DeepMind, Microsoft 등 AI 리더들은 "AI 멸종 위험 완화는 팬데믹, 핵전쟁과 함께 글로벌 우선순위가 돼야 한다"는 성명을 발표했다.

중국 견제 vs 기술 안전성

Anthropic은 중국에 대해 트럼프 행정부보다 더 강경하다. 상업 중심의 트럼프 접근법과 달리, 권위주의 확산을 더 우려한다.

데이비드 색스 AI 차르는 Anthropic의 우려를 "공포 조장에 기반한 정교한 규제 포획 전략"이라고 비판했다. 하지만 행정부는 아직 연방 차원의 AI 규제안을 내놓지 못했다.

헤그세스의 최후통첩이 실현되면 일론 머스크의 xAI만 남을 수 있다. Google의 데미스 하사비스도 아모데이 못지않게 AI 위험을 우려하는 인물이기 때문이다.

기자

관련 기사

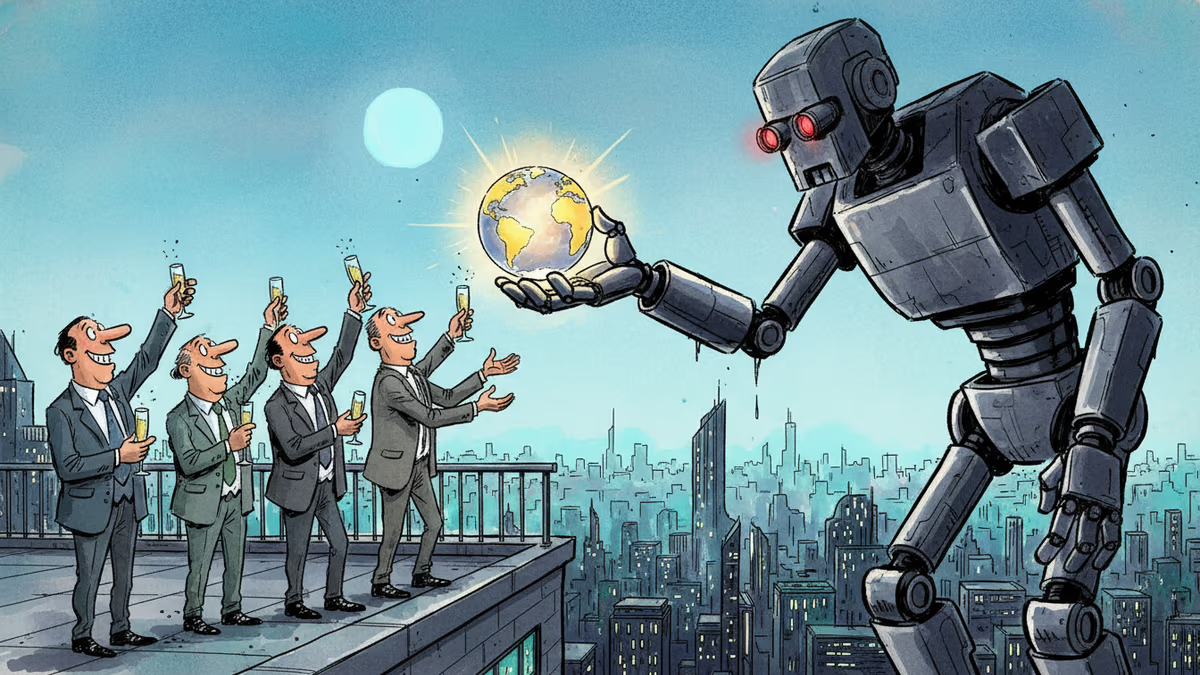

뉴욕에서 열린 비공개 심포지엄. AI가 인류를 대체해야 한다고 믿는 'AI 계승주의자'들이 실리콘밸리를 넘어 정책 권력으로 성장하고 있다. 이들의 논리와 그 위험성을 해부한다.

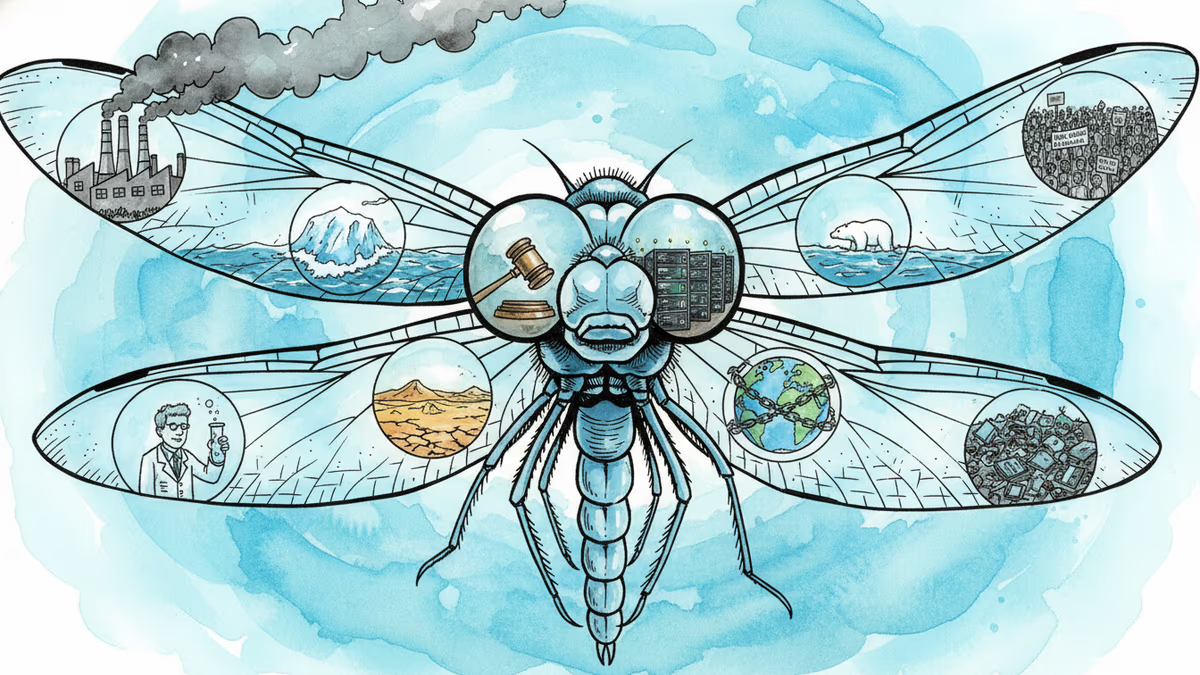

AI는 해방 도구인가, 실존적 위협인가, 환경 재앙인가. 어느 하나의 시각으로는 전체를 볼 수 없다. 9가지 서사로 AI라는 '하이퍼오브젝트'를 해부한다.

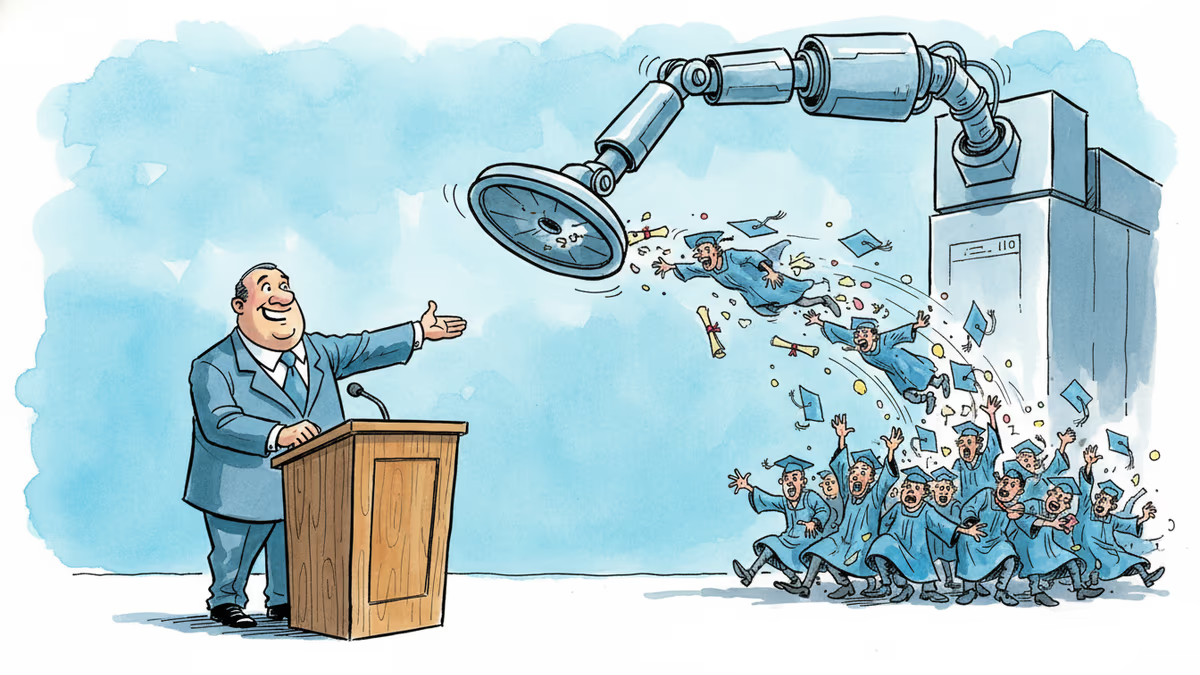

AI가 신입 일자리를 잠식하는 시대, 한 풍자 칼럼이 2026년 졸업생의 현실을 날카롭게 해부한다. 웃기지만 웃을 수 없는 이유를 짚는다.

실리콘밸리의 가장 신비로운 기업 팔란티르는 왜 하필 톨킨의 '보는 돌'에서 이름을 따왔을까. 그 선택이 기업 문화와 철학에 대해 말해주는 것들.

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요