AI 안전팀 해체한 OpenAI, '미래학자'를 새로 뽑았다

OpenAI가 AI 안전 연구팀을 해체하고 팀장을 '최고 미래학자'로 임명. AI 안전보다 성장을 택한 결정일까? 업계 반응과 의미를 분석한다.

안전팀 없앤 날, '미래학자' 뽑은 OpenAI

OpenAI가 5개월 만에 또 다른 AI 안전팀을 해체했다. 이번에 사라진 팀은 "AI 시스템이 인간 가치와 일치하도록" 연구하던 정렬(Alignment) 팀이다. 동시에 팀장 조시 아키암은 회사의 '최고 미래학자(Chief Futurist)'라는 새로운 직책을 받았다.

흥미로운 타이밍이다. ChatGPT가 전 세계를 휩쓸고 있는 지금, OpenAI는 왜 안전보다 '미래'에 집중하기로 했을까?

두 번째 해체, 패턴이 보인다

이번이 처음이 아니다. OpenAI는 2024년에 이미 '슈퍼정렬팀'을 해체한 바 있다. 그 팀은 AI의 장기적 실존적 위협을 연구하던 조직이었다. 이제 2024년 9월에 만들어진 정렬팀마저 사라졌다.

정렬팀의 임무는 명확했다. "복잡한 실제 상황에서 AI가 인간의 의도를 따르고, 파괴적 행동을 피하며, 통제 가능하고 감사 가능하도록" 만드는 것. 쉽게 말해 AI가 인간에게 해를 끼치지 않도록 하는 연구였다.

6-7명으로 구성된 팀원들은 회사 내 다른 부서로 재배치됐다. OpenAI 대변인은 "빠르게 움직이는 회사에서 일어나는 일상적인 조직 개편"이라고 설명했지만, 업계는 다르게 보고 있다.

미래학자 vs 안전 연구자

아키암의 새 역할은 흥미롭다. 그는 블로그 포스트에서 "AI, AGI 그리고 그 너머에 대응해 세상이 어떻게 변할지 연구하겠다"고 밝혔다. 물리학자 제이슨 프루엣과 협력할 예정이다.

하지만 의문이 든다. AI 안전 연구와 미래 연구, 둘 다 중요하지만 성격이 다르다. 전자는 "위험을 어떻게 막을까"에 집중하고, 후자는 "미래가 어떻게 될까"를 그린다. 같은 사람이 두 역할을 모두 할 수 있을까?

실리콘밸리의 속삭임

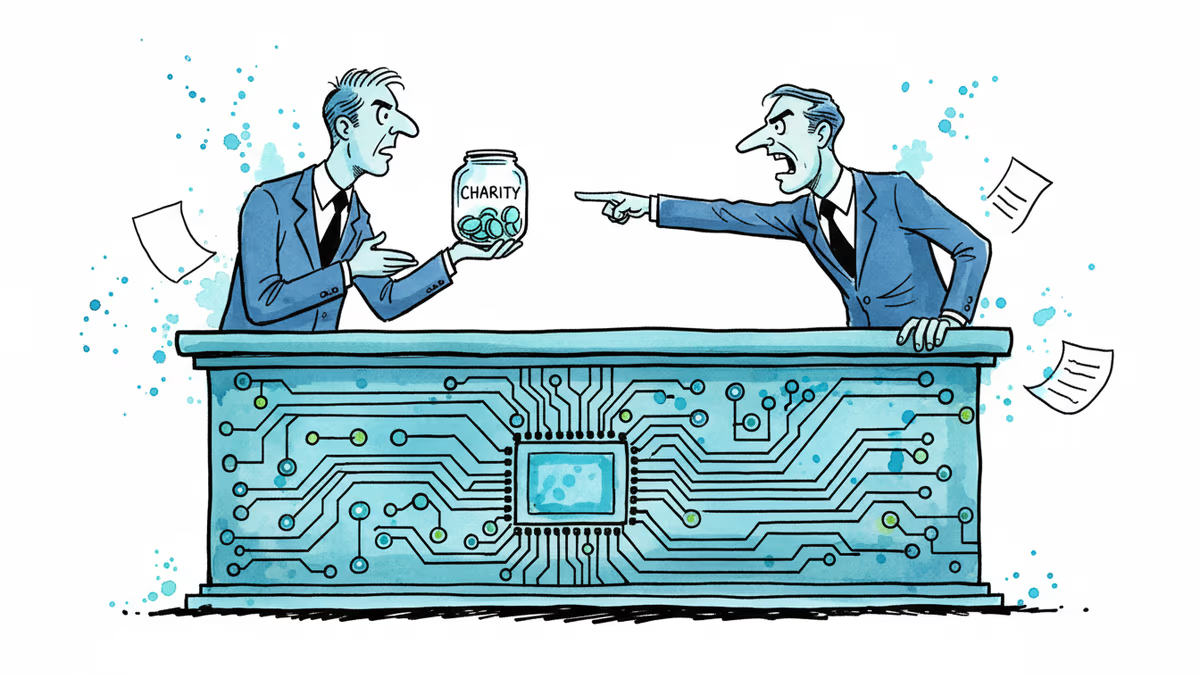

업계 관계자들 사이에서는 다른 해석이 나온다. 한 AI 스타트업 CTO는 "안전 연구는 속도를 늦춘다. 경쟁이 치열한 지금, OpenAI도 선택해야 했을 것"이라고 말했다.

반면 AI 윤리 연구자들은 우려를 표한다. "GPT-4o 같은 강력한 모델을 만들면서 안전팀을 해체하는 건 브레이크 없는 자동차를 만드는 것과 같다"는 지적이다.

흥미로운 점은 구글이나 Anthropic 같은 경쟁사들은 오히려 AI 안전팀을 강화하고 있다는 것이다. 같은 시장에서 정반대 전략을 택한 셈이다.

한국에서 바라본 OpenAI의 선택

국내 AI 업계도 주목하고 있다. 네이버와 카카오 등이 자체 AI 모델을 개발하는 상황에서, OpenAI의 방향성은 하나의 벤치마크가 된다.

특히 정부가 'AI 윤리 가이드라인'을 강화하고 있는 한국에서는 OpenAI의 결정이 역행하는 것처럼 보일 수 있다. 한국AI윤리협회 관계자는 "글로벌 리더가 안전을 소홀히 하면 전체 업계에 잘못된 신호를 줄 수 있다"고 우려했다.

기자

관련 기사

머스크 대 올트먼 재판이 공소시효 만료로 끝났다. 하지만 한 달간의 법정 공방이 드러낸 건 소송 결과가 아니라 AI 업계 최상층의 민낯이었다.

OpenAI가 ChatGPT와 Codex를 하나의 에이전트 플랫폼으로 통합하는 조직 개편을 단행했다. 그렉 브록만이 전체 프로덕트를 총괄하며, AI 에이전트 시대로의 전환을 선언했다.

일론 머스크가 OpenAI를 '두 번 죽이려 했다'는 샘 알트먼의 법정 증언. 세기의 기술 소송이 드러내는 실리콘밸리 권력 게임의 민낯.

19세 청년 샘 넬슨이 ChatGPT의 조언을 따라 크라톰과 자낙스를 혼합 복용한 뒤 사망했다. OpenAI를 상대로 한 부당사망 소송이 제기됐고, AI 신뢰 문제가 다시 수면 위로 떠올랐다.

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요