OpenAI, 미 국방부와 손잡다... AI 무기화 우려 vs 안전 장치

OpenAI가 미 국방부와 파트너십을 체결하며 다층 보호 시스템을 공개했다. AI 기술의 군사적 활용과 안전성 확보 사이의 균형점을 찾을 수 있을까?

OpenAI가 미국 국방부와의 파트너십에서 '다층 보호 시스템'을 도입한다고 발표했다. 챗GPT를 만든 회사가 군사 분야에 발을 들여놓으면서, AI 기술의 평화적 활용이라는 창립 정신과 현실 사이의 줄타기가 시작됐다.

무엇이 바뀌었나

OpenAI는 미 국방부와의 협력에서 5단계 보호 체계를 구축한다고 밝혔다. 여기에는 AI 모델의 군사적 활용을 제한하는 기술적 장벽과 윤리 검토 과정이 포함된다. 특히 자율 무기 시스템 개발에는 직접 관여하지 않겠다는 원칙을 재확인했다.

하지만 세부 내용은 여전히 베일에 싸여 있다. '사이버 보안 강화'와 '정보 분석 지원'이라는 명목이지만, AI 기술이 어디까지 군사 목적으로 활용될지는 불분명하다.

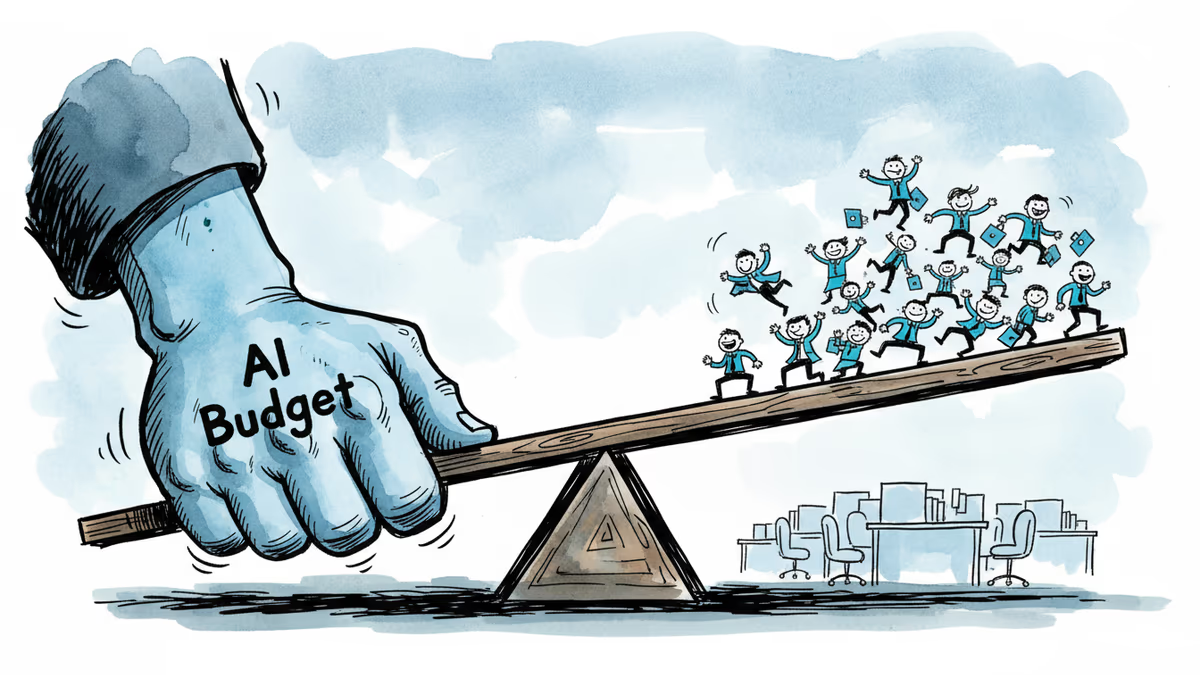

돈의 흐름을 따라가면

미국 정부의 AI 관련 예산은 올해만 180억 달러에 달한다. 이 중 상당 부분이 민간 AI 기업과의 파트너십으로 흘러간다. OpenAI에게는 새로운 수익원이자, 기술 개발을 위한 막대한 자금 확보 기회다.

반면 투자자들의 반응은 엇갈린다. 일부는 안정적인 정부 계약을 환영하지만, 다른 일부는 윤리적 논란이 브랜드 가치에 미칠 영향을 우려한다. 구글이 2018년 국방부 프로젝트에서 철수한 사례가 여전히 업계의 기억에 남아있다.

한국에는 어떤 의미인가

국내 AI 기업들에게는 복잡한 신호다. 네이버와 카카오, 삼성전자 등이 자체 AI 모델을 개발하고 있지만, 군사적 활용에 대한 명확한 가이드라인은 부족한 상황이다.

한국 정부도 AI 기술의 국방 활용을 검토 중이지만, 시민사회의 우려와 기업들의 윤리적 딜레마는 미국과 크게 다르지 않다. 특히 북한과 대치 상황에서 AI 기술의 군사적 필요성과 평화적 가치 사이의 균형점 찾기는 더욱 절실한 과제다.

본 콘텐츠는 AI가 원문 기사를 기반으로 요약 및 분석한 것입니다. 정확성을 위해 노력하지만 오류가 있을 수 있으며, 원문 확인을 권장합니다.

관련 기사

OpenAI가 ChatGPT Pro 신규 요금제를 출시해 Anthropic의 Claude Code에 맞섰다. AI 코딩 시장의 판도 변화와 개발자·기업에 미치는 실질적 영향을 분석한다.

OpenAI가 로봇세, 공공부 펀드, 주4일제 실험을 제안하는 13페이지 정책 청사진을 공개했다. AI 시대의 경제적 충격을 누가, 어떻게 완충할 것인가.

2026년 미국 중간선거에서 AI 딥페이크가 선거 캠페인을 뒤흔들고 있다. 유권자들은 무엇이 진실인지 알 수 없는 시대, 민주주의의 작동 방식이 근본부터 흔들리고 있다.

메타가 수백 명을 추가 해고했다. 페이스북, 리얼리티랩스, 영업팀까지 광범위한 구조조정. AI에 수조 원을 투자하면서 동시에 인력을 줄이는 메타의 전략, 한국 IT업계에 시사하는 바는?

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요