OpenAI, 국방부 계약 '졸속 추진' 인정... AI 무기화 논란 재점화

샘 알트만 CEO가 국방부 계약을 성급하게 추진했다고 시인하며 조건 수정에 나섰다. AI 무기화와 감시 우려가 커지는 가운데, 기술 기업의 윤리적 딜레마가 드러났다.

OpenAI의 샘 알트만 CEO가 미국 국방부와의 계약을 "성급하게 추진했다"고 공개 사과했다. 금요일 발표 직후 폭발한 여론의 뭇매를 맞고 나서다.

24시간 만에 뒤바뀐 입장

지난 금요일, OpenAI는 미국 국방부와 새로운 계약을 체결했다고 발표했다. 타이밍이 묘했다. 백악관이 경쟁사 Anthropic의 AI 도구 사용을 금지한 바로 몇 시간 후였고, 미국이 이란을 공습하기 직전이었다.

하지만 월요일, 알트만은 엑스(X)에 올린 글에서 "기회주의적이고 조잡해 보였다"며 계약 조건을 수정하겠다고 밝혔다. 새로운 조건에는 "AI 시스템을 미국인에 대한 국내 감시에 의도적으로 사용하지 않는다"는 문구가 포함됐다.

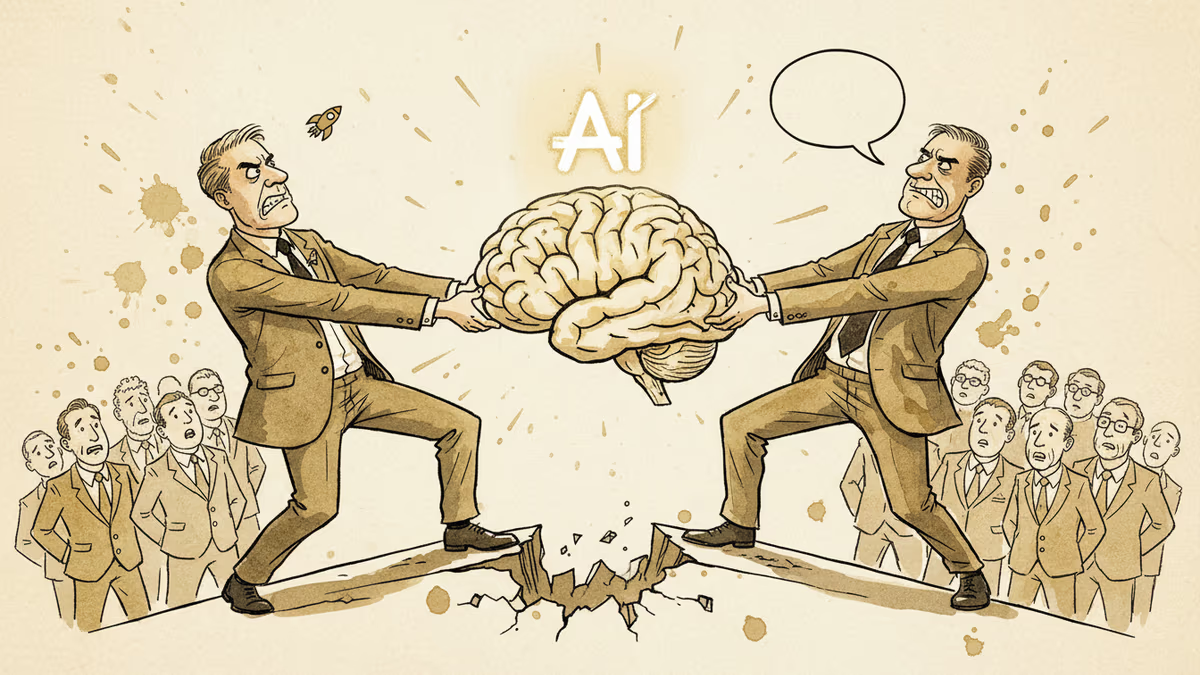

승자와 패자가 바뀐 AI 전쟁

OpenAI의 국방부 계약은 Anthropic과 정부 간 협상이 결렬된 직후 나왔다. Anthropic은 자사의 Claude AI가 국내 감시나 자율 무기 개발에 사용되지 않겠다는 보장을 요구했지만, 국방부는 이를 거부했다.

흥미롭게도 Anthropic의 Claude는 이미 지난 1월 베네수엘라 대통령 니콜라스 마두로 체포 작전에 사용된 바 있다. 당시 Anthropic은 공개적으로 반대하지 않았다.

여론의 반응은 즉각적이었다. 앱스토어에서 많은 사용자들이 ChatGPT를 삭제하고 Claude를 다운로드하기 시작했다. AI 기업들의 윤리적 선택이 시장 점유율에 직접 영향을 미치는 시대가 됐다.

기술 기업의 윤리적 딜레마

알트만은 "기술이 아직 준비되지 않은 많은 영역이 있고, 안전을 위해 필요한 트레이드오프를 아직 이해하지 못하는 부분이 많다"고 인정했다. 그러면서도 "Anthropic이 공급망 위험 업체로 지정되어서는 안 된다"며 경쟁사를 옹호하는 모습을 보였다.

이는 단순한 기업 간 경쟁을 넘어선 문제다. AI가 군사적 목적으로 사용될 때의 윤리적 기준을 누가, 어떻게 설정할 것인가의 문제이기 때문이다.

기자

관련 기사

AI와 위성 기업들이 잇따라 월가 상장을 준비하며 2026년 IPO 시장에 불을 지피고 있다. 투자자에게 기회인가, 거품의 전조인가?

스페이스엑스가 이르면 다음 주 상장 신청서를 공개한다. 역대 최대 규모 IPO가 예고된 가운데, 개인 투자자에게 실제 기회가 열릴지 따져봤다.

일론 머스크가 샘 올트먼을 상대로 제기한 소송이 본격 재판에 돌입한다. OpenAI의 영리 전환 논란과 AI 패권 다툼의 진짜 의미를 짚어본다.

캐나다 AI 기업 Cohere가 독일 Aleph Alpha 인수를 발표했다. 6억 달러 투자와 함께 빅테크 독주에 맞서는 '주권 AI' 연합이 형성되고 있다. 한국 기업에는 무슨 의미인가?

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요