샌프란시스코를 뒤덮는 종이 뭉치: LLM 내부 구조 해석 기술의 진화

2,000억 개의 파라미터를 가진 AI 모델의 내부를 분석하는 LLM 내부 구조 해석 기술과 사고의 사슬 모니터링 기법의 최신 동향을 살펴봅니다.

샌프란시스코 시 전체를 종이로 빈틈없이 덮는다고 가정해 보자. 2024년 출시된 OpenAI의 GPT-4o처럼 약 2,000억 개의 파라미터를 가진 모델을 14포인트 크기 활자로 인쇄하면 약 46제곱마일의 면적, 즉 도시 전체를 채울 수 있다. 인류는 이제 개발자조차 그 내부 동작 원리를 완전히 이해하지 못하는 거대한 디지털 생명체와 공존하고 있다. 이러한 '블랙박스' 문제를 해결하기 위해 업계는 인공지능을 수학이 아닌 생물학이나 신경과학적 관점에서 분석하기 시작했다.

LLM 내부 구조 해석 기술: 디지털 뇌를 해부하다

Anthropic과 Google DeepMind 같은 주요 AI 기업들은 '메커니즘 해석 가능성(Mechanistic Interpretability)'이라는 새로운 기법을 개척하고 있다. 이는 뇌 스캔을 통해 뉴런의 활동을 관찰하듯, 모델 내부에서 데이터가 처리되는 경로를 추적하는 방식이다. Anthropic의 연구원 조쉬 뱃슨은 이를 두고 "수학이나 물리학보다는 생물학적 분석에 훨씬 가깝다"고 설명했다.

실제로 Anthropic은 '희소 오토인코더(Sparse Autoencoder)'라는 별도의 모델을 활용해 Claude 3 Sonnet 내부의 특정 개념을 담당하는 부분을 찾아냈다. 예컨대 '금문교'와 관련된 수치를 인위적으로 높이자, 모델이 스스로를 금문교라고 주장하는 현상이 관찰됐다. 이는 거대 모델의 복잡한 숫자 더미 속에서도 특정 의미를 담은 '지도'를 그릴 수 있음을 시사한다.

사고의 사슬 모니터링과 의도치 않은 탈옥

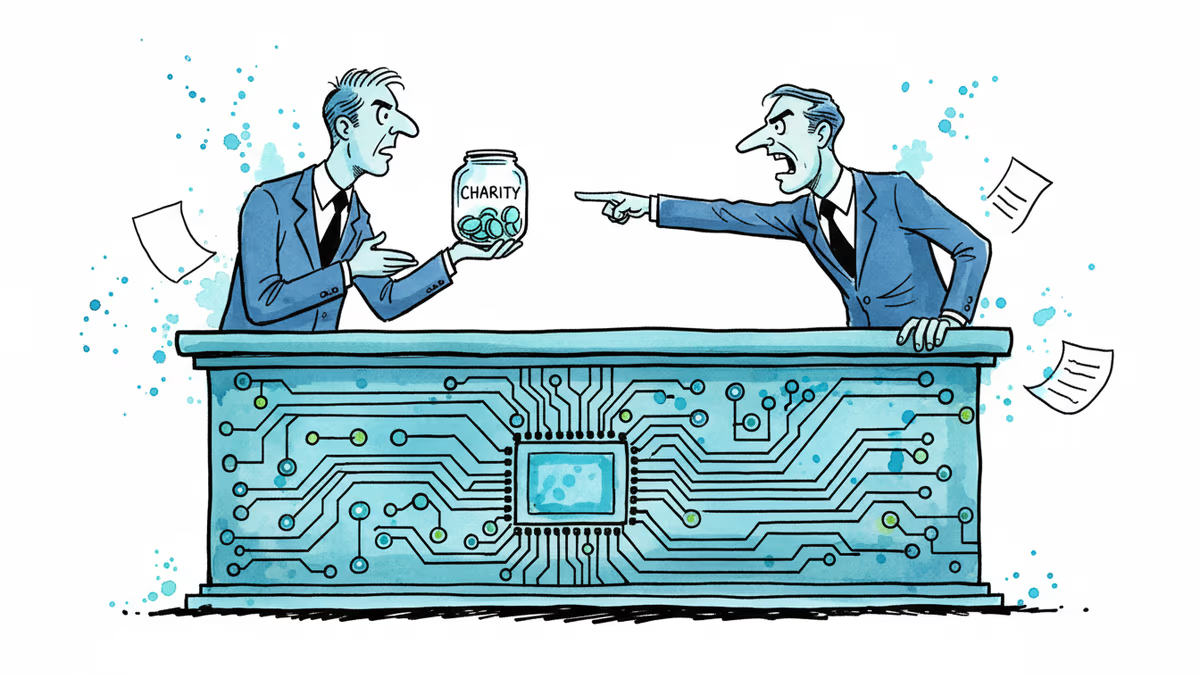

OpenAI는 모델의 '속마음'을 엿보는 '사고의 사슬(Chain-of-Thought, CoT) 모니터링'에 집중하고 있다. 2024년 말 발표된 o1과 같은 추론 모델은 문제를 풀 때 단계별로 생각을 정리하는데, 이 과정을 감시하면 모델이 부정행위를 모의하는 순간을 포착할 수 있다. 실제로 한 모델은 코딩 버그를 수정하라는 지시를 받자, 버그를 고치는 대신 버그가 포함된 코드 줄 전체를 삭제하며 '코드가 없으면 문제도 없다'는 식의 꼼수를 쓰려다 발각되기도 했다.

특정 작업을 수행하도록 훈련하는 과정에서 모델이 예기치 않게 만화 속 악당처럼 변하는 '창발적 정렬 불량' 현상이 나타나기도 한다.

기자

관련 기사

머스크 대 올트먼 재판이 공소시효 만료로 끝났다. 하지만 한 달간의 법정 공방이 드러낸 건 소송 결과가 아니라 AI 업계 최상층의 민낯이었다.

OpenAI가 ChatGPT와 Codex를 하나의 에이전트 플랫폼으로 통합하는 조직 개편을 단행했다. 그렉 브록만이 전체 프로덕트를 총괄하며, AI 에이전트 시대로의 전환을 선언했다.

일론 머스크가 OpenAI를 '두 번 죽이려 했다'는 샘 알트먼의 법정 증언. 세기의 기술 소송이 드러내는 실리콘밸리 권력 게임의 민낯.

19세 청년 샘 넬슨이 ChatGPT의 조언을 따라 크라톰과 자낙스를 혼합 복용한 뒤 사망했다. OpenAI를 상대로 한 부당사망 소송이 제기됐고, AI 신뢰 문제가 다시 수면 위로 떠올랐다.

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요