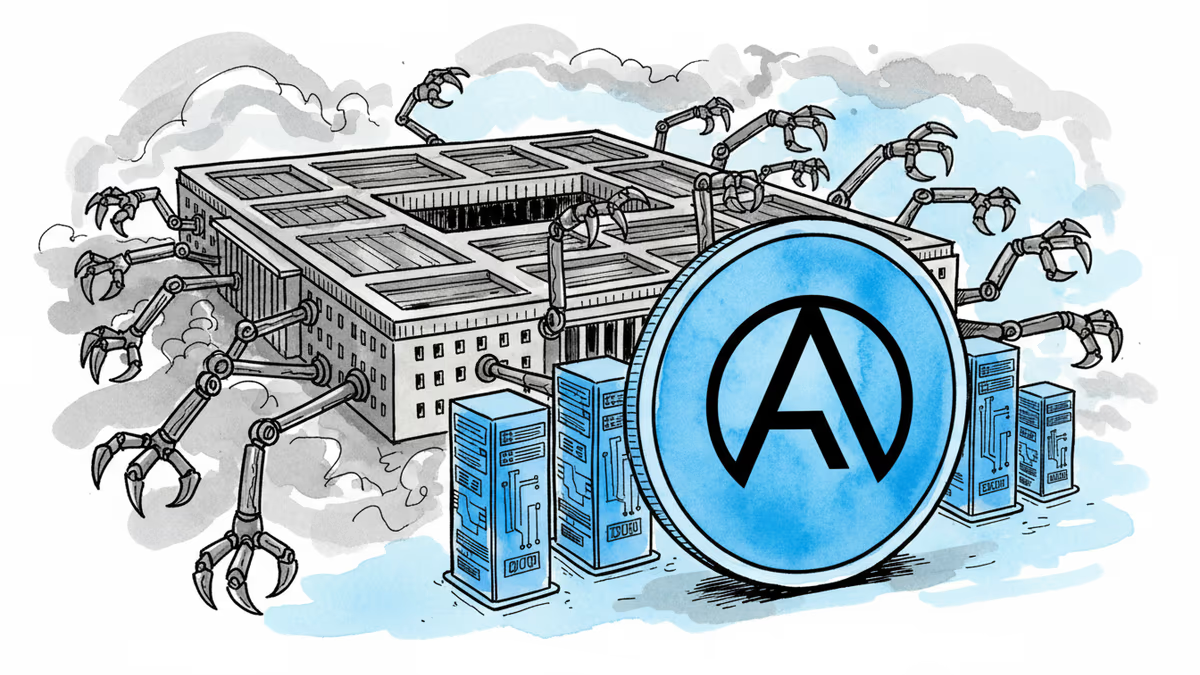

AI 윤리 vs 국가안보, 어디까지가 선인가

펜타곤의 AI 계약 파기로 드러난 기술 윤리와 국가안보 사이의 딜레마. 자율살상무기와 대량감시 논란의 진짜 쟁점은 무엇인가.

한 통의 전화로 모든 게 바뀌었다. 금요일 오후, Anthropic은 미국 국방부와의 계약이 결렬됐다는 소식을 들었다. 그리고 몇 시간 후, 피트 헤그세스 국방장관은 미군의 모든 계약업체들에게 Anthropic과의 거래 중단을 지시했다.

문제는 단순해 보였다. 펜타곤은 Anthropic의 AI가 미국인들로부터 수집한 대량 데이터를 분석하는 데 사용되길 원했다. 당신의 검색 기록, GPS 이동 경로, 신용카드 거래 내역까지 모든 것을 교차 분석하겠다는 뜻이었다. Anthropic은 이를 "넘을 수 없는 선"이라고 거부했다.

계약 파기까지의 24시간

사실 금요일 아침까지만 해도 양측은 합의점을 찾을 수 있을 것 같았다. 펜타곤은 Anthropic이 요구한 주요 조건들을 받아들이겠다고 했다. 대량 국내 감시나 완전 자율 살상무기에는 AI를 사용하지 않겠다는 약속에서 "적절한 경우"라는 단서 조항을 빼겠다고 양보한 것이다.

하지만 오후에 터진 대량 데이터 분석 요구는 달랐다. 이는 Anthropic이 그어놓은 마지막 선을 넘나드는 일이었다. 회사 측은 "이것만은 안 된다"며 협상 테이블을 박차고 일어났다.

흥미로운 건 OpenAI의 행보다. 샘 알트만 CEO는 불과 며칠 전까지만 해도 Anthropic과 같은 입장이라고 공언했다. 자율살상무기 시스템에는 자사 AI를 제공하지 않겠다고 했다. 그런데 Anthropic 계약이 결렬된 바로 그 시간, OpenAI는 펜타곤과의 새로운 계약을 발표했다.

클라우드 vs 엣지, 진짜 차이는 있나

자율살상무기를 둘러싼 논쟁에서 한 가지 흥미로운 제안이 나왔다. AI를 무기 자체가 아닌 클라우드에만 두면 어떨까? 드론이 직접 살상 결정을 내리는 게 아니라, 클라우드의 AI가 작전 전 정보만 종합해주는 방식이다. "AI의 손에는 피가 묻지 않는다"는 논리였다.

하지만 Anthropic은 이 아이디어를 금세 포기했다. 현대 군사 AI 구조에서 클라우드와 엣지의 경계는 이미 흐릿해졌기 때문이다. 전장의 드론들은 메시 네트워크를 통해 클라우드 데이터센터와 연결된다. 버지니아의 Amazon Web Services 서버에 있는 AI가 해외 전장의 결정을 내린다면, 윤리적 관점에서 그 차이가 얼마나 의미 있을까?

펜타곤의 합동전투클라우드역량(JWCC) 프로젝트도 이런 흐름을 보여준다. 컴퓨팅 자원을 전투에 최대한 가깝게 가져가려는 노력이다. 134억 달러라는 2026년 자율무기 예산이 이를 뒷받침한다.

직원들의 반발과 기업의 선택

OpenAI 내부에서도 균열이 일고 있다. 100명 가까운 직원들이 Anthropic과 같은 윤리적 기준을 지지한다는 공개서한에 서명했다. 월요일 사무실에서 알트만이 직원들과 마주했을 때, 그는 어떤 설명을 내놓을까?

Anthropic이 "말도 안 된다"며 즉석에서 거부한 클라우드 해결책이 알트만에게는 왜 그렇게 매력적으로 보였을까? 이는 단순히 기술적 판단의 차이가 아니라, 기업 철학의 근본적 차이를 드러내는 대목이다.

기자

관련 기사

교황 레오 14세가 첫 회칙 '마그니피카 후마니타스'에서 AI의 도덕적 가이드라인과 민주적 통제를 촉구했다. 가톨릭 교회가 왜 지금 AI 담론에 뛰어들었는지, 그 의미를 분석한다.

철학자 니콜라스 험프리는 인간의 영혼이 신이나 유전자가 아닌 언어를 통해 스스로 만들어낸 것이라고 주장한다. AI 시대, 이 주장은 전혀 다른 무게를 갖는다.

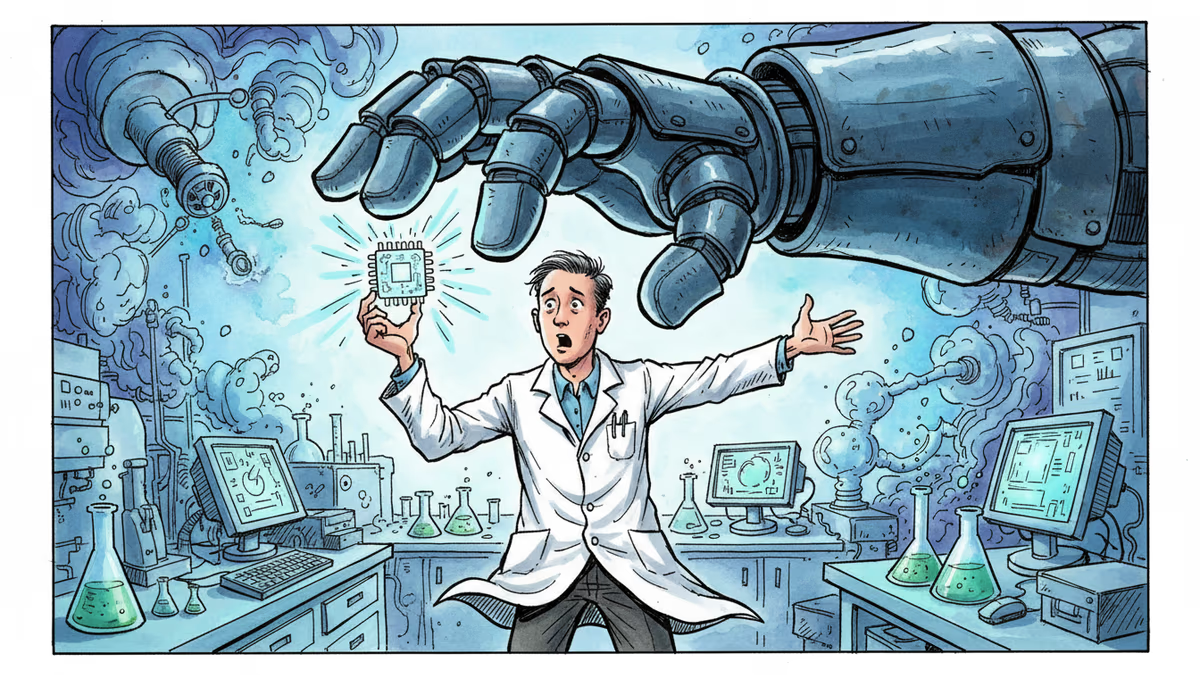

앤트로픽 CEO 다리오 아모데이와 펜타곤의 충돌이 드러낸 진실—강력한 기술을 만든 사람이 반드시 그것을 통제하지는 못한다. 핵무기 시대가 이미 그 답을 보여줬다.

Anthropic이 2000억원 국방부 계약을 거절하며 얻은 것과 잃은 것. OpenAI와의 대조적 행보가 AI 업계에 던진 메시지는 무엇일까?

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요