AI가 2주 만에 파이어폭스 취약점 22개 찾아냈다

Anthropic의 Claude가 파이어폭스에서 22개 보안 취약점을 발견. AI 보안 도구의 가능성과 한계를 동시에 보여준 사건

22개. 이게 AI가 2주 만에 찾아낸 파이어폭스 보안 구멍의 개수다

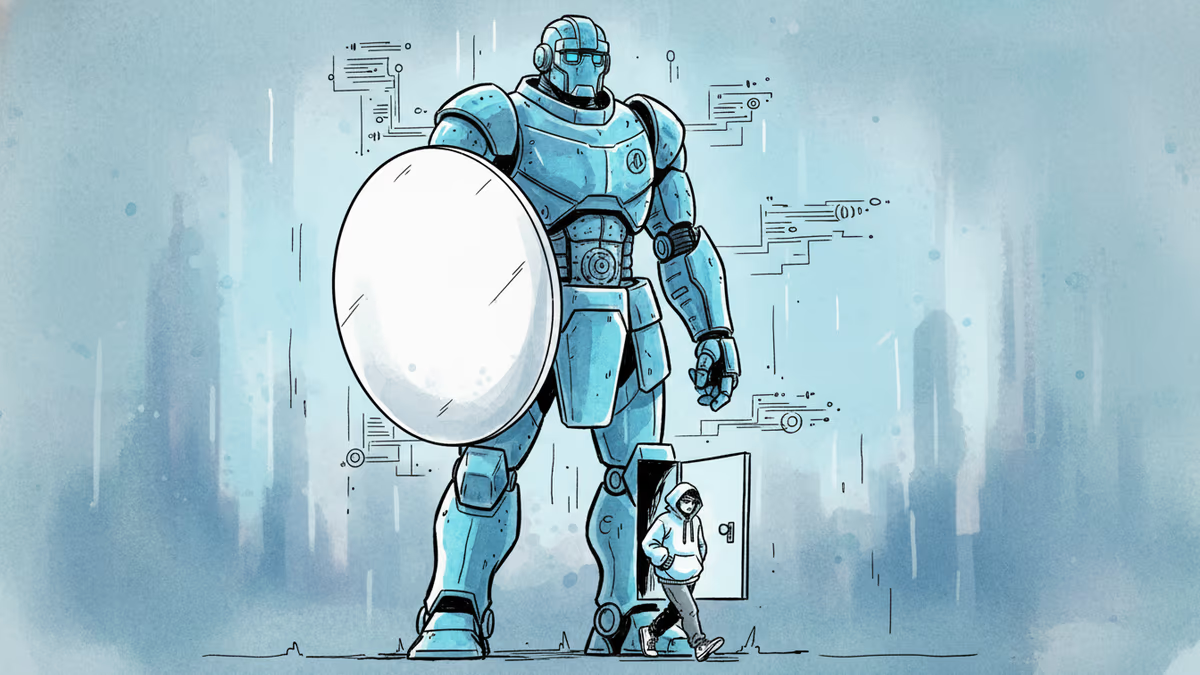

Anthropic의 Claude Opus 4.6이 Mozilla와의 보안 파트너십을 통해 파이어폭스에서 22개의 취약점을 발견했다. 이 중 14개는 '고위험' 등급이었다. 대부분은 지난 2월 출시된 파이어폭스 148에서 이미 수정됐지만, 몇 개는 다음 업데이트를 기다려야 한다.

흥미로운 건 Anthropic 팀이 파이어폭스를 선택한 이유다. "복잡한 코드베이스이면서 동시에 세계에서 가장 잘 테스트되고 안전한 오픈소스 프로젝트 중 하나"라는 설명이다. 즉, AI의 능력을 시험하기 위해 일부러 어려운 타겟을 골랐다는 뜻이다.

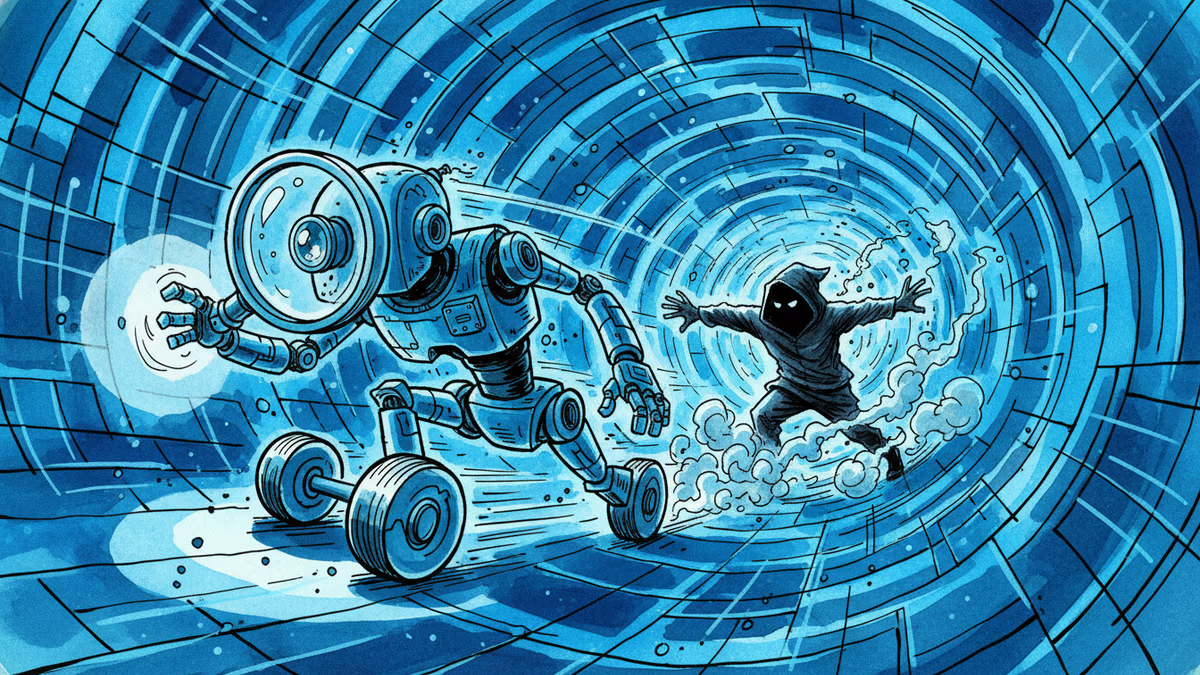

찾기는 잘하는데, 해킹은 못한다

AI의 한계도 드러났다. Claude는 취약점 발견에는 탁월했지만, 실제 공격 코드 작성에는 애를 먹었다. 팀은 4,000달러의 API 크레딧을 써가며 개념 증명 익스플로잇을 만들려 했지만, 겨우 2건에서만 성공했다.

이는 AI 보안 도구의 현실적 특성을 보여준다. '문제 발견자'로는 뛰어나지만 '공격자'로는 아직 제한적이라는 것이다. 보안 업계에는 오히려 안심할 만한 소식일 수 있다.

오픈소스 생태계에 미치는 파장

이번 사례는 오픈소스 프로젝트에 AI 도구가 얼마나 유용할 수 있는지 보여준다. 하지만 동시에 "유용한 기여와 함께 쓸모없는 풀 리퀘스트의 홍수"도 가져올 수 있다고 TechCrunch는 지적했다.

국내 오픈소스 커뮤니티도 주목할 만하다. 네이버나 카카오 같은 기업들이 운영하는 오픈소스 프로젝트에서도 AI 기반 보안 검사를 도입할 가능성이 높아졌다. 특히 한국의 사이버보안 환경을 고려하면, 이런 도구의 활용도는 더욱 클 것으로 예상된다.

기자

관련 기사

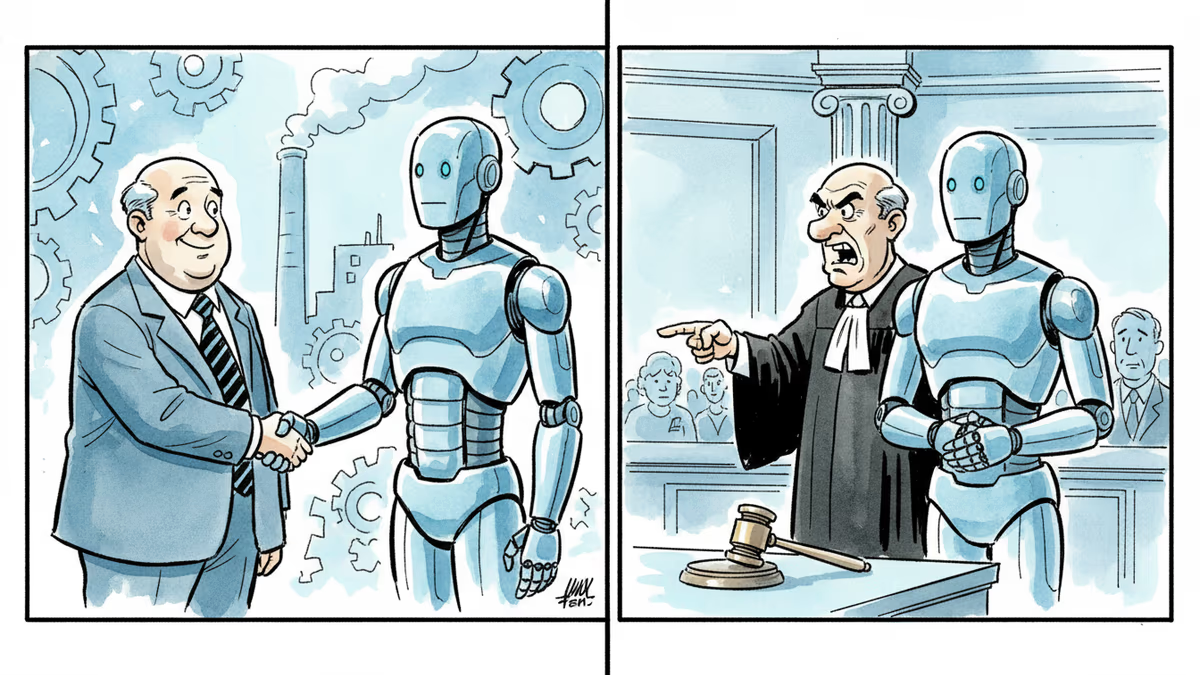

OpenAI가 보안 특화 AI 이니셔티브 'Daybreak'를 출시했다. Codex 에이전트를 활용해 취약점을 공격자보다 먼저 탐지·패치하는 이 서비스는 Anthropic의 Claude Mythos와 정면 경쟁 구도를 형성한다.

Anthropic의 최강 보안 AI '미토스'가 디스코드 사용자들에게 뚫렸다. 동시에 북한 해커는 AI로 악성코드를 짜고, 모질라는 AI로 271개 취약점을 잡았다. 사이버보안의 새 질서가 형성되고 있다.

트럼프 행정부가 월가 은행들에 Anthropic의 Mythos AI 모델 테스트를 권고했다. 동시에 같은 회사를 법원에서 상대하고 있는 아이러니한 상황, 그 이면을 들여다본다.

OpenAI가 월 100달러짜리 새 요금제를 출시하며 Anthropic의 Claude Code에 정면 도전장을 냈다. 개발자들은 어떤 선택을 해야 할까? 가격 경쟁이 AI 코딩 도구 시장을 어떻게 바꾸는지 분석한다.

의견

이 기사에 대한 생각을 나눠주세요

로그인하고 의견을 남겨보세요