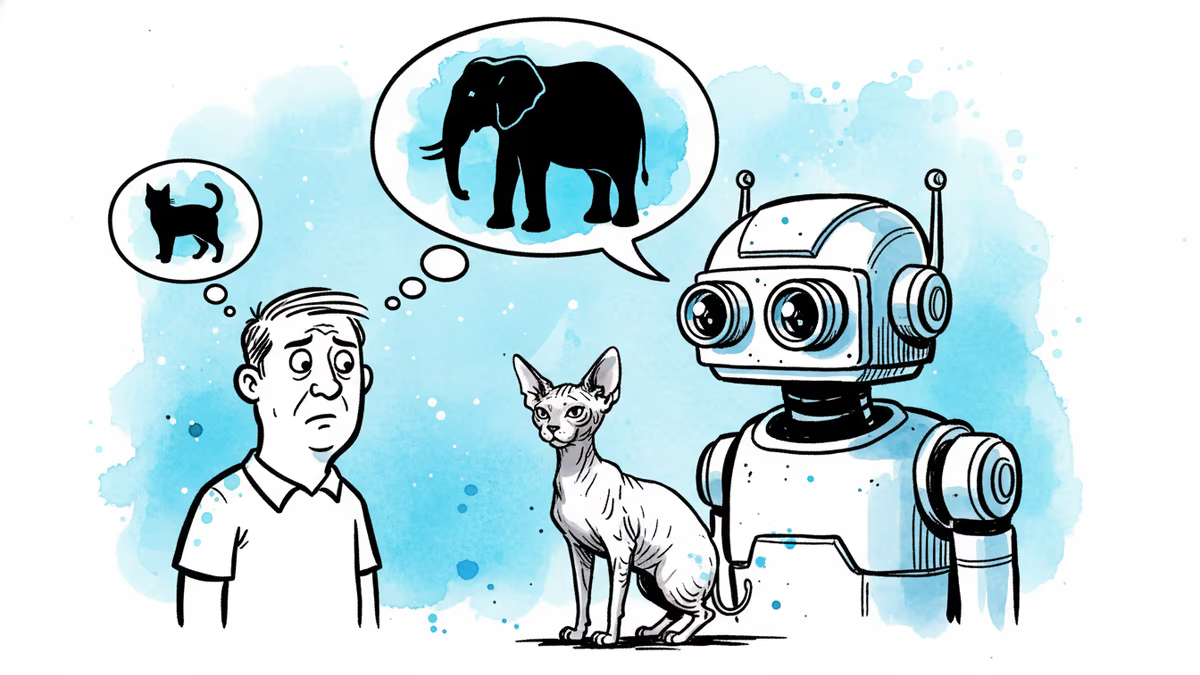

AIはなぜハゲネコをゾウと見間違えるのか

AIの視覚システムが人間と根本的に異なる方法で世界を認識している。その「ズレ」が自動運転や医療診断に潜むリスクを生み出す理由を、知覚研究の最前線から読み解く。

毛のないスフィンクス猫の写真を見て、ゾウだと思う人間はいない。しかし、多くのAIシステムはそう判断してしまう。

これは単なる技術的な珍事ではない。AIが「何を見ているか」という問いは、私たちが日常的に頼り始めているシステム——自動運転車、医療診断、監視カメラ——の信頼性そのものに関わっている。

AIが「見ている」のは、私たちが見ているものとは違う

アメリカの視覚知覚研究者たちが指摘するのは、AIと人間の間にある根本的な「表現のズレ(representational misalignment)」だ。人間が物体を認識するとき、私たちは形や色といった表面的な特徴だけでなく、その物体が何のためにあるか、どんな文脈で使われるか、他のものとどう関係するかという知識の網の中で対象を理解する。

コーヒーマグを例に考えてみよう。マグは見た目こそコンピューターとは全く違うが、「液体を入れて飲む」という機能の点ではグラスに近い。引っ越しの荷造りをするときはサイズで分類し、食器棚に戻すときは「飲み物用」として分類する。同じマグなのに、文脈によって脳内での整理の仕方が変わる。これが人間の知覚の柔軟性だ。

一方、AIはラベルの正確さだけを基準に訓練される。「猫」と「ゾウ」を正しく分類できれば、それで十分とみなされる。その過程でAIが学ぶのは、ピクセルパターンや表面のテクスチャといった「近道(ショートカット)」であり、猫とゾウが生態系の中でどう関係しているか、どんな文脈で現れるかではない。スフィンクス猫の毛のない皮膚のテクスチャが、ゾウの皮膚のパターンに近いと判断されてしまうのは、そのためだ。

「小さなズレ」が大きなリスクになる場面

この問題が深刻になるのは、AIが高い精度を示しながらも、人間とは全く異なる理由でその判断に至っている場合だ。

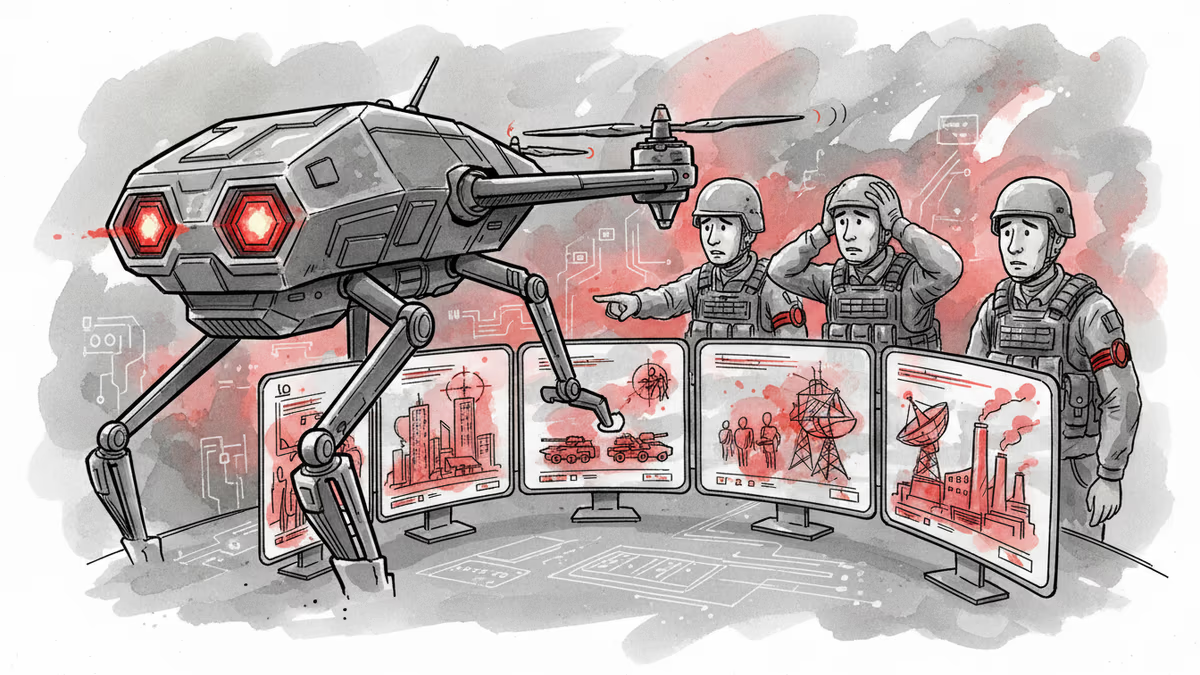

自動運転車を考えてほしい。落書きやステッカーで汚れた一時停止標識を、人間のドライバーは形と文脈から即座に「停止サイン」と認識する。しかし、ピクセルパターンに依存するAIは、その変化によって標識を「看板」や「広告」として分類してしまう可能性がある。トヨタやホンダが開発を進める自動運転技術において、こうした誤認識は命取りになりかねない。

医療の現場でも同様だ。AIが医療画像を分析する際、実際の病変の視覚的特徴ではなく、画像の出所や繰り返し現れるアーティファクト(ノイズ)と疾患を結びつけて学習してしまう事例が報告されている。表面上の精度は高くても、その判断根拠が人間の医師とは根本的に異なるのだとすれば、それは安全と言えるだろうか。

日本では2025年から段階的に自動運転の商用サービスが拡大しており、経済産業省もAI医療機器の審査基準の整備を進めている。「AIが高精度である」という事実と「AIが人間と同じように世界を理解している」という仮定は、全く別の話だ。

「ズレ」を修正する試み

研究者たちは、この表現のズレを修正するアプローチを模索している。その一つが、人間の類似性判断をAIの訓練に組み込む手法だ。「マグはグラスに近いか、ボウルに近いか」という問いに人間が答えたデータを使って、AIが物体間の関係性を学べるよう誘導する。

これは「価値の整合(value alignment)」——AIが人間の意図する目標を追求するようにする課題——とは区別される、より基礎的な問題への取り組みだ。AIが人間と同じように世界を「表現」できるようになれば、価値の整合に向けた一歩にもなりうると研究者たちは考えている。

人間の知覚は、新しい情報を既存の知識の網に織り込むことで成立する。「ゾウ」を学ぶとき、私たちは同時に動物、サイズ、生息地、人間との関係など無数の文脈を結びつける。AIにも同様の学び方を促すことができるか——それが現在の研究の核心にある問いだ。

日本社会にとっての問い

日本は今、少子高齢化による労働力不足という構造的な課題を抱えている。AIと自動化への期待は、単なる技術的関心を超えた社会的要請でもある。介護ロボット、自動運転、医療診断支援——これらの分野でAIへの依存度が高まるほど、「AIが人間とどこまで同じように世界を見ているか」という問いの重みは増す。

ソニーのカメラ認識技術、デンソーの車載センサー、富士フイルムの医療画像AI。日本企業が世界市場で競う分野の多くが、まさにこの「視覚的表現の整合性」という課題と直結している。精度の高さを競うだけでなく、AIが人間の知覚とどれだけ整合しているかを評価する基準を、業界全体で議論する時期に来ているのかもしれない。

記者

関連記事

米国の歩行者死亡率はカナダの3倍、ノルウェーの13倍。2025年上半期に死者数が11%減少したが、それでもコロナ前より高い水準が続く。道路設計と社会の価値観が問われている。

OpenAIやGoogleが「推論モデル」と呼ぶAIの中核技術「思考の連鎖」。その発見者は研究者ではなく、2020年の匿名ゲーマーたちだった。AI業界の誇大広告の裏に何があるのかを読み解く。

啓蒙主義とロマン主義の対立が現代AIの議論に再浮上。人工的な「魂」は構築できるのか?哲学者ピーター・ウォルフェンデールの問いが示す、AI倫理の本質的な地平とは。

米軍がイラン攻撃でAnthropic社のClaude AIを使用。戦争における人工知能の役割拡大が提起する新たな倫理的課題とは

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加