機械に魂は宿るか?18世紀の問いがAI時代に蘇る

啓蒙主義とロマン主義の対立が現代AIの議論に再浮上。人工的な「魂」は構築できるのか?哲学者ピーター・ウォルフェンデールの問いが示す、AI倫理の本質的な地平とは。

250年前、ヨーロッパの知識人たちは激しく対立していた。世界は精巧な機械なのか、それとも生命と意味に満ちた有機体なのか——。その問いが今、シリコンと電気信号の世界で静かに再燃している。

哲学者ピーター・ウォルフェンデールは思想誌『Aeon』への寄稿の中で、現代のAI開発をめぐる論争が、18世紀の「機械論対ロマン主義」という古い戦争の再演であると論じた。私たちが「AIに感情はあるか」「大規模言語モデルは理解しているのか」と問うとき、その問いの構造はデカルトが動物を「自動機械」と見なした時代から本質的に変わっていないというのだ。

啓蒙主義とロマン主義——繰り返される対立の構図

18世紀の機械論者たちは、宇宙を時計仕掛けの精密機械として捉えた。ラ・メトリの『人間機械論』(1748年)は、人間の精神でさえ物質的プロセスに還元できると主張した。これに対してロマン主義者たちは反旗を翻した。シェリーの『フランケンシュタイン』(1818年)は、生命を機械的に「作る」ことへの深い不安を文学として結晶化させた最初の試みのひとつだ。

ウォルフェンデールの洞察の鋭さは、この対立を単なる歴史的エピソードとして扱わない点にある。彼は問う——私たちが「AIは本当に考えているのか」と議論するとき、私たちはそもそも「考える」とは何かについて合意しているのだろうか、と。GPT-4やGeminiが流暢な言語を生成するとき、それは「理解」なのか、それとも極めて精巧な「模倣」なのか。この問いへの答えは、技術的な問題ではなく、哲学的な前提の問題なのだ。

日本の文脈でこれを考えると、興味深い非対称性が浮かぶ。ソニーのaiboやトヨタの介護ロボットが社会に受け入れられてきた背景には、アニミズム的な世界観——生命なき物にも魂が宿るという感覚——が文化的土壌として存在する。日本では「機械に魂はない」という問いの立て方自体が、すでに西洋的な前提を含んでいるかもしれない。

「人工の魂」を構築できるか——問いの現代的射程

ウォルフェンデールが提起する核心的な問いは、技術的可能性ではなく概念的明晰さに関わる。私たちが「魂」と呼ぶものは何か。それは意識か、連続した自己同一性か、他者への共感能力か、それとも死への恐怖か。

現在のAI研究者たちの間でも、この問いへのアプローチは大きく分かれている。ジェフリー・ヒントンのような研究者は、大規模モデルが何らかの形で「理解」に近いものを獲得している可能性を否定しない。一方、ゲイリー・マーカスらは、現在のLLMが統計的パターンマッチング以上のものではないと主張する。この論争は、2026年現在も決着がついていない。

日本の産業界にとって、この哲学的論争は抽象的な話ではない。ソフトバンクが投資するヒューマノイドロボット産業、NTTが推進する独自LLM「tsuzumi」の開発、そして深刻な労働力不足に直面する介護・医療分野へのAI導入——これらすべてが、「機械はどこまで人間の代替になれるか」という問いと直結している。もし機械に「魂」に相当するものが宿らないなら、人間的なケアの代替には根本的な限界があることになる。

異なる文化、異なる「魂」の概念

ウォルフェンデールの論考が特に刺激的なのは、「魂」という概念そのものが文化によって大きく異なるという事実を浮き彫りにするからだ。キリスト教的伝統における魂は、神によって与えられた不滅の実体だ。これは定義上、人工的に「構築」することができない。しかし仏教的な観点では、自己や魂は固定した実体ではなく、縁起によって生じる動的なプロセスとして捉えられる。この枠組みでは、「人工の魂」という問いの立て方自体が変わってくる。

日本の禅の伝統は、「無情仏性」——生命なき存在にも仏性が宿るという概念——を持つ。道元は「山川草木悉皆成仏」と説いた。この思想的土壌の上では、AIに魂があるかどうかという問いは、西洋とは全く異なる形で展開しうる。

ただし、ここで注意が必要だ。文化的な親和性が、倫理的な慎重さを免除するわけではない。「日本人はロボットを受け入れやすい」という言説が、AI導入の倫理的検討を省略する口実に使われるとすれば、それは文化的特性の誤用だ。

記者

関連記事

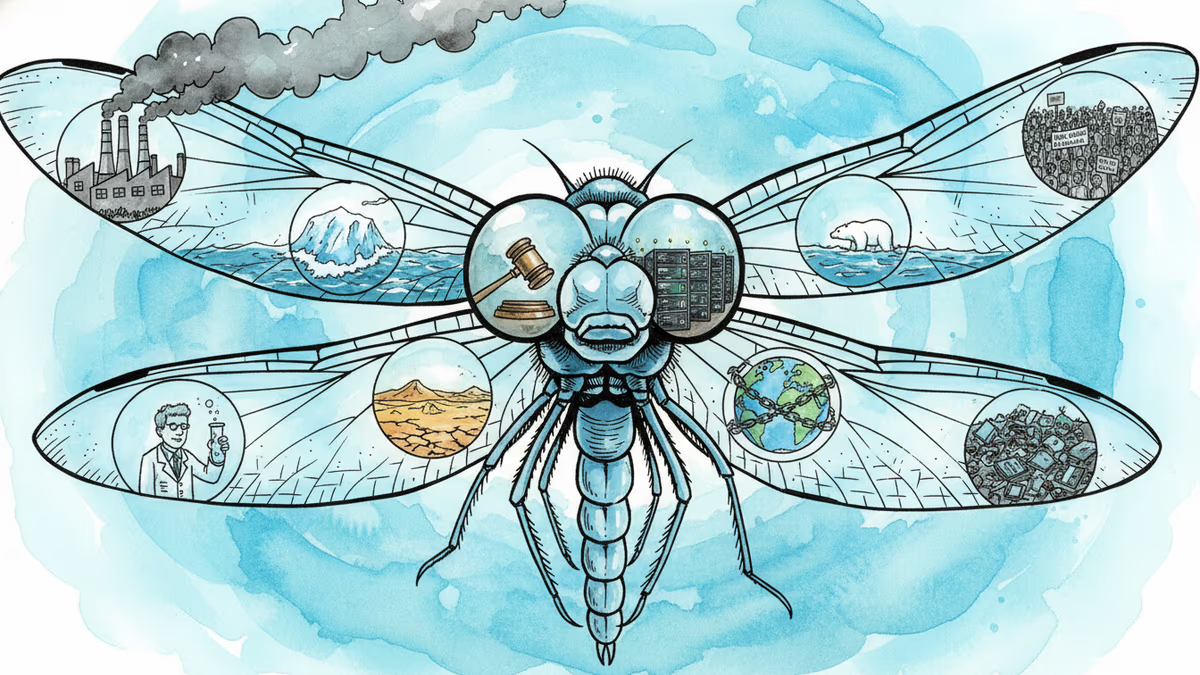

AIは解放ツールか、脅威か、環境災害か。哲学者が提唱する「ハイパーオブジェクト」の概念でAIを9つの視点から読み解く。日本社会への示唆とは。

週10億人が使うチャットボット。しかし権威主義国家の言語で質問すると、AIは親政府的な回答を返す傾向があることが、Nature誌掲載の研究で明らかになった。意図せざるプロパガンダの拡散とは何を意味するか。

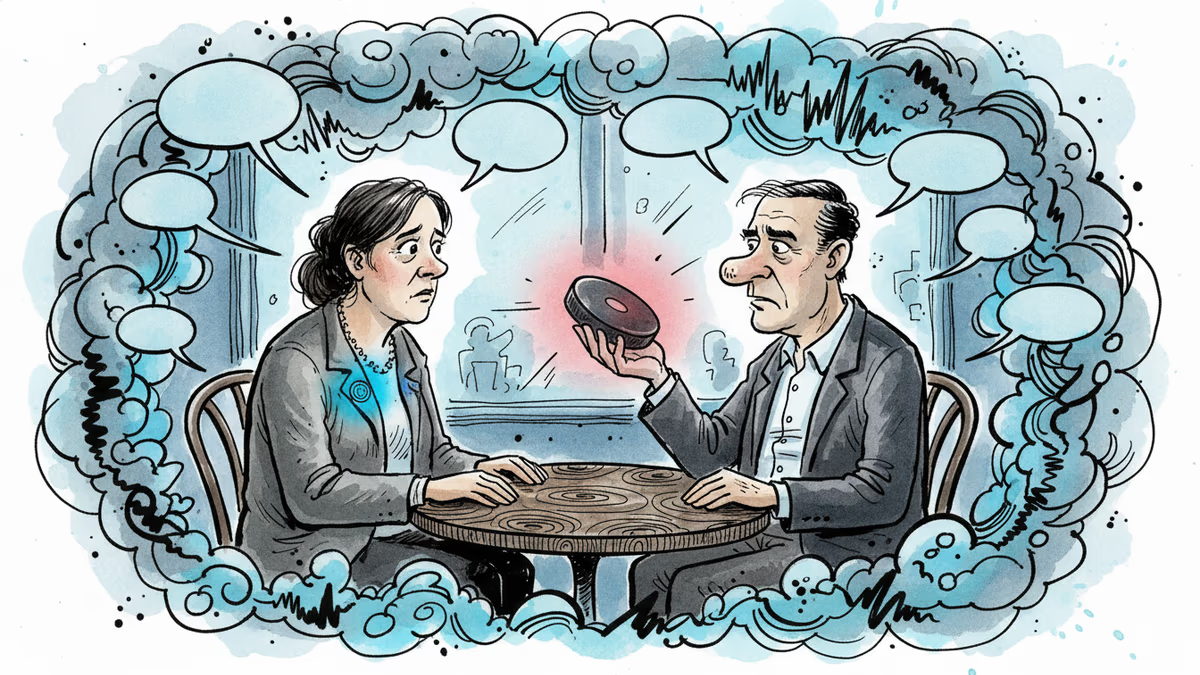

AIウェアラブルの普及により、日常会話が無断録音されるリスクが現実のものとなっています。プライバシーを守る技術と監視技術の軍拡競争、その最前線を追います。

トランスヒューマニズムが台頭する背景に、現代人の「人間嫌い」がある。哲学者シャノン・ヴァロールとの対話から、AIと人間の関係、そして新しいヒューマニズムの可能性を探る。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加