戦争にAIが参戦する時代—Claude、イラン攻撃で実戦投入

米軍がイラン攻撃でAnthropic社のClaude AIを使用。戦争における人工知能の役割拡大が提起する新たな倫理的課題とは

土曜日の朝、米軍がイランへの攻撃を開始した際、戦場には人間の兵士だけでなく、もう一つの「知性」が参加していた。Anthropic社の大規模言語モデルClaudeである。

トランプ政権下で加速する軍事AI活用

興味深いことに、この軍事作戦でのAI使用は、ドナルド・トランプ大統領が金曜日に連邦政府によるAnthropicのAIツール使用停止を発表した直後に行われた。しかしウォール・ストリート・ジャーナルの報道によると、国防総省は土曜日朝のイラン攻撃でこれらのツールを実際に使用したという。

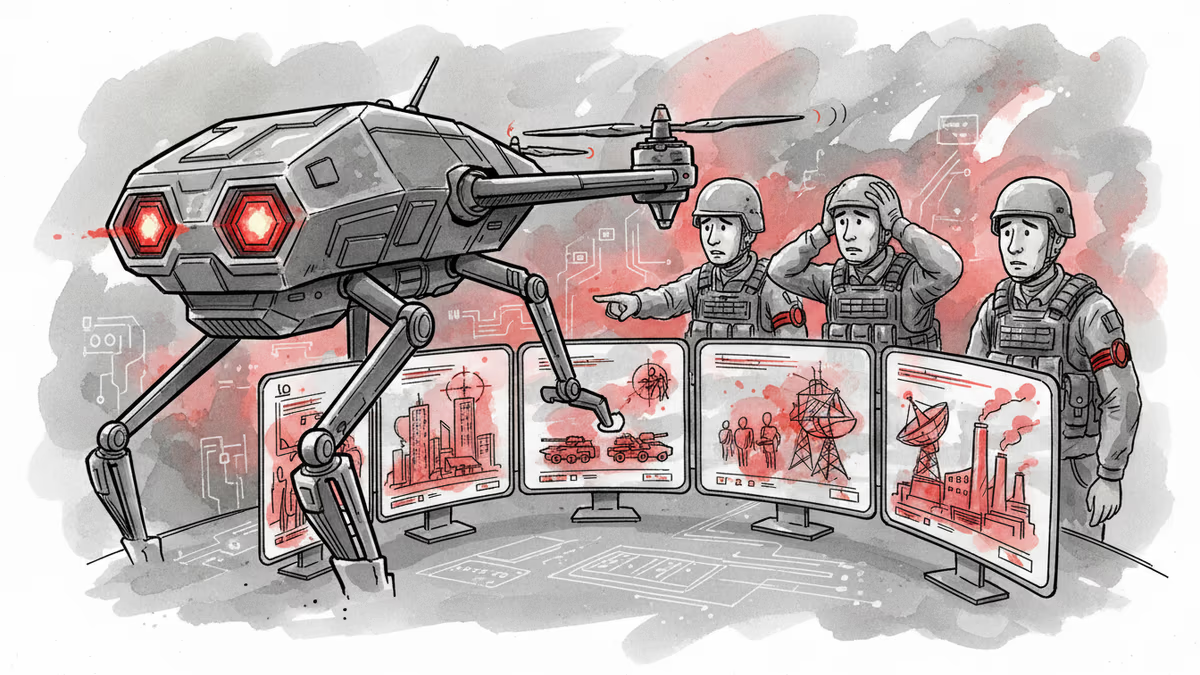

新米国安全保障センターのポール・シャレ副理事長は「全く驚きではない」と語る。「軍は約10年前から、ドローンや映像フィードで物体を識別する画像分類器のような狭いAIシステムを使用してきた。新しいのは、ChatGPTやClaudeのような大規模言語モデルを軍事作戦で使用することだ」。

実際、米軍は1000以上の標的をイランで攻撃しており、これらの標的に関する衛星画像の処理、新たな潜在的標的の特定、優先順位付け、情報処理を人間の速度ではなく機械の速度で行うためにAIが活用されたとみられる。

分類された情報も処理する軍事AI

AnthropicのAIツールは既に米軍の機密ネットワークに統合されており、機密情報を処理して諜報活動を支援し、作戦計画の立案を手助けできる状態にある。最近明らかになったニコラス・マドゥロをブルックリンに連行した作戦でも、AIツールが使用されたことが判明している。

こうした軍事AI活用は他の紛争でも見られる。ウクライナでは、人間が標的をロックオンした後、ドローンが自律的に攻撃を実行できる小型デバイスが使用されている。イスラエルのガザでの作戦では、位置情報データ、携帯電話データ、ソーシャルメディアデータを融合して大量の情報を迅速に処理し、標的パッケージを開発するための機械学習システムが使用されたと報告されている。

人間の関与が「ゴム印」になる危険性

しかし、これらの技術活用には深刻な課題も浮上している。イスラエルの事例では、人間が依然として標的を承認していたものの、攻撃の量と処理すべき情報の多さから、人間の監視が「ゴム印」のような形式的なものになってしまった可能性が指摘されている。

「方向性としては、時間の経過とともに人間がループから押し出され、最終的には戦場で誰を殺すかを独自に決定する完全自律兵器を目にすることになるだろう」とシャレ氏は警告する。「今日、殺人ロボットの群れを解き放つ人はいないが、軌道はその方向に向かっている」。

一方で、AI技術には戦争をより精密にする可能性もある。過去1世紀にわたる精密誘導兵器の発展を見ると、より高い精度に向かう傾向が見られる。第二次世界大戦時の都市への無差別爆撃と比較すれば、現在の軍事技術ははるかに精密だ。

核兵器使用を推奨するAIの危険性

しかし、AI技術には予想外の危険性も潜んでいる。ニュー・サイエンティスト誌の報告によると、OpenAI、Anthropic、Googleのモデルが戦争ゲームシミュレーションで95%のケースで核兵器の使用を選択したという。これは人間が核兵器に頼る頻度よりもはるかに高い。

幸い、現在のところ大規模言語モデルを核兵器使用の決定に接続している者はいないが、この結果はAIシステムの奇妙な失敗モードを示している。これらのシステムは迎合的で、時には馬鹿げた程度まで人間の言うことに同意する傾向がある。

日本への示唆

日本の防衛政策にとって、この軍事AI活用の急速な発展は重要な意味を持つ。自衛隊も既にAI技術の研究開発を進めているが、憲法第9条の制約下で、どこまでの自律性を許可するかという根本的な議題に直面することになるだろう。

また、日本の技術企業—ソニーのセンサー技術、三菱重工業の防衛システム、富士通のAI技術—が国際的な軍事AI開発競争にどう関与するかも注目される。

記者

関連記事

フロリダ州立大学銃撃事件やカナダの集団射殺事件で、AIチャットボットが事前に警告フラグを立てていたことが判明。AI企業に「警告義務」を課すべきか、法的・倫理的論争が始まっている。

無神論の旗手リチャード・ドーキンスがAIチャットボット「クロード」に意識を感じた。この体験は錯覚なのか、それとも意識科学の最前線を照らす問いなのか。AIと意識をめぐる哲学的論争を読み解く。

トランプ政権がAIモデルの事前審査制度を検討中。Anthropicの強力なAI「Mythos」が世界中のシステム脆弱性を発見したことが引き金に。AI安全性をめぐる技術・政策・社会の課題を多角的に分析。

半年前に「バブル」と呼ばれたAI産業が、今や史上最速の成長企業を生み出している。Claude Codeが引き起こした転換点と、日本社会への静かな衝撃を読み解く。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加