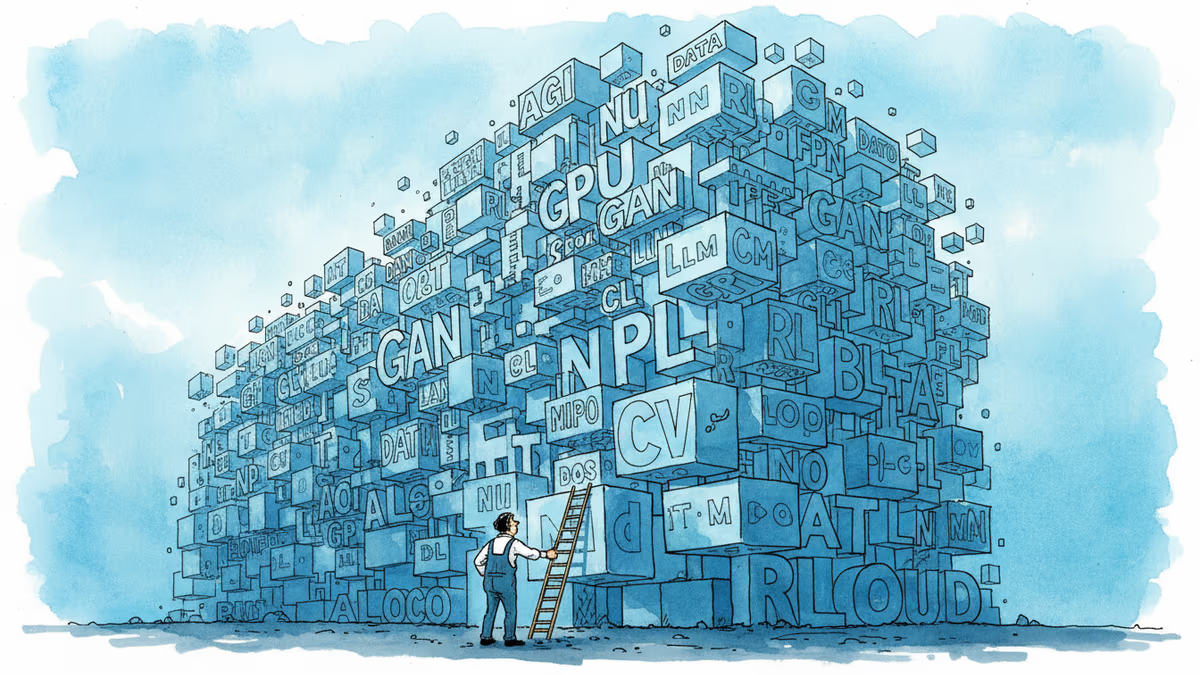

AIの専門用語、あなたはいくつ知っていますか?

AGI、LLM、ハルシネーション——AI業界が使う専門用語を正しく理解することは、これからの時代を生き抜くための必須スキルかもしれません。日本社会への影響も含めて解説します。

「AGI」「LLM」「ハルシネーション」——これらの言葉を聞いたことはあっても、正確に説明できる人はどれくらいいるでしょうか。

AI業界は、独自の言語体系を持つ世界です。研究者たちは日々、新しい概念を生み出し、それに名前をつけていきます。ニュースを読んでいると、こうした専門用語が当たり前のように使われていますが、その意味を正確に理解しないまま情報を受け取ることは、地図なしで見知らぬ街を歩くようなものです。今回は、AI報道で頻繁に登場する重要な用語を整理し、それぞれが私たちの日常や社会にどんな意味を持つのかを考えてみます。

「AGI」とは何か——専門家でも定義が違う

まず、最も議論を呼んでいる概念から始めましょう。AGI(人工汎用知能)とは、多くのタスクにおいて平均的な人間と同等か、それ以上の能力を持つAIを指します。しかし、その定義は組織によって異なります。

OpenAIのCEO、サム・アルトマン氏は「同僚として雇えるような、平均的な人間に相当するもの」と表現しています。一方、Google DeepMindは「ほとんどの認知タスクにおいて、少なくとも人間と同等の能力を持つAI」と定義しています。同じ言葉でも、語る人によって意味が微妙にずれているのです。

この曖昧さは単なる言葉遊びではありません。「AGIが実現した」と誰かが宣言したとき、それが何を意味するかは、どの定義を採用するかによって大きく変わります。日本の製造業や医療、教育の現場でAI導入が議論される際、「どのレベルのAIを想定しているのか」を明確にすることは、現実的な意思決定において非常に重要です。

「ハルシネーション」という静かなリスク

AI用語の中で、一般の人々が最も注意すべき概念の一つが「ハルシネーション(幻覚)」です。これは、AIモデルが事実ではない情報を、あたかも正確であるかのように生成してしまう現象を指します。

たとえば、医療に関する質問をAIにしたとき、存在しない薬の名前や誤った用量を自信満々に答えることがあります。これは訓練データの「空白」から生じる問題とされており、特に汎用型の大規模AIモデルでは避けがたい課題です。世界中に存在するすべての知識をカバーするほどのデータは、現時点では存在しないからです。

日本では高齢化社会が進み、医療・介護の現場でAI活用への期待が高まっています。しかし、ハルシネーションのリスクを理解せずに「AIが言ったから正しい」と受け取ることは危険です。多くのAIサービスが利用規約の小さな文字で「AIの回答を必ず確認してください」と記載しているのは、こうした理由からです。

「AIエージェント」が変える働き方

「AIエージェント」は、単純な質問応答を超えて、複数のタスクを自律的にこなすシステムを指します。経費の申請、レストランの予約、コードの作成と保守——こうした一連の作業を、人間の代わりに実行するAIです。

日本では少子高齢化による労働力不足が深刻な課題となっています。トヨタやソニーをはじめとする大企業はもちろん、中小企業においても、AIエージェントが事務作業や定型業務を担う未来は、遠い話ではありません。ただし、「エージェント」という言葉自体、現時点ではまだ発展途上の概念であり、インフラ整備も途上にあります。期待と現実のギャップを正確に把握することが大切です。

「蒸留(Distillation)」という技術の地政学的側面

少し専門的な話になりますが、「蒸留」という技術にも注目が必要です。これは、大きなAIモデル(教師モデル)の知識を、より小さなモデル(生徒モデル)に移し取る技術です。OpenAIの「GPT-4 Turbo」もこの手法で開発されたと考えられています。

問題は、競合他社のモデルを無断で蒸留することが、利用規約違反にあたるという点です。実際、中国のAIスタートアップが米国の先端モデルを蒸留して開発を加速させたとされる事例が報告されており、AI技術をめぐる国際的な競争と倫理の問題が浮き彫りになっています。日本企業がグローバルなAI競争に参加する際、こうした技術的・法的リスクへの理解も不可欠です。

「LLM」「推論」「ファインチューニング」——基礎を押さえる

LLM(大規模言語モデル)は、ChatGPTやGeminiなどの基盤となる技術です。膨大なテキストデータを学習し、文章を生成したり質問に答えたりします。「推論(Inference)」はこのモデルを実際に動かすプロセスであり、「ファインチューニング」は特定の業務や分野に特化させるための追加学習を指します。

医療、法律、教育、製造——日本の各産業でAI導入が進む中、LLMをそのまま使うのではなく、業種固有のデータでファインチューニングすることで、精度と安全性を高めようとする動きが加速しています。

「チェーン・オブ・ソート(連鎖思考)」も重要な概念です。複雑な問題を段階的に分解して考えることで、AIの回答精度を高める手法です。人間が難しい計算をするときに紙に書き出すのと似た発想で、特に論理的な推論やプログラミングの文脈で効果を発揮します。

関連記事

Waymoが新型ロボタクシー「Ojai」をLA・フェニックス・サンフランシスコで試験運用開始。中国Zeekr製ミニバンをベースに低コスト・大量生産を目指す戦略の意味と、日本自動車産業への影響を読み解く。

産休・育休中にAIコーディングツールが普及し、復職後に「スキルギャップ」に直面する女性エンジニアたちの実態。技術変化が働く母親に与える不均衡な影響を多角的に分析する。

YouTubeが新AI機能「カスタムフィード」を発表。見たい動画をテキストで入力するだけで、パーソナライズされた専用フィードが生成される。この変化はコンテンツ消費の何を変えるのか。

Google社員が社内の機密データを使いPolymarketで約1.2億円の不正利益を得たとして連邦検察に起訴。インサイダー情報と予測市場の新たなリスクを問う。

意見

この記事についてあなたの考えを共有してください

ログインして会話に参加