AI為何把無毛貓認成大象?這個問題比你想的更嚴重

AI視覺系統與人類感知之間存在根本性的「表徵錯位」。從自動駕駛到醫療診斷,這個看似荒謬的錯誤揭示了當前AI部署中被低估的系統性風險。

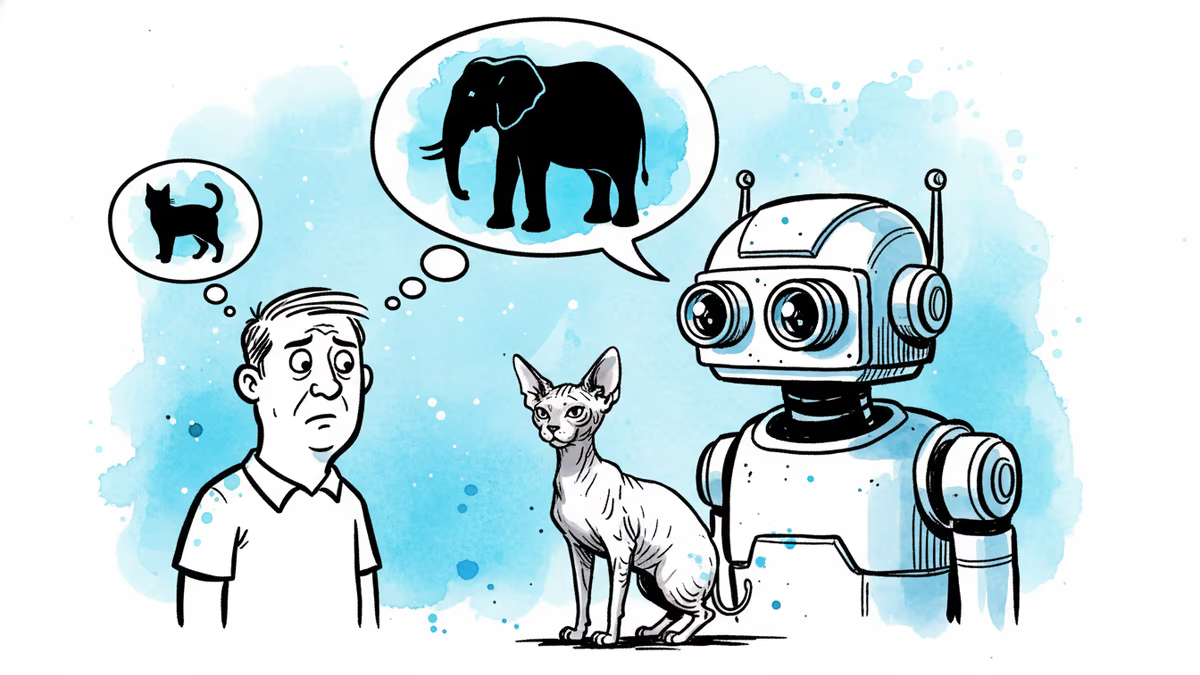

一張無毛斯芬克斯貓的照片,任何人都不會認錯。但許多AI視覺系統會把它歸類為大象。

這不是笑話,也不是個別案例。這是一個關於「AI如何理解世界」的根本性問題——而這個問題的答案,正在悄悄影響著從自動駕駛到醫療診斷的每一個高風險應用場景。

AI看到的,和你看到的不一樣

美國視覺感知研究者的最新研究揭示了一個關鍵概念:表徵錯位(representational misalignment)。簡單說,就是AI組織視覺資訊的方式,與人類根本不同。

人類辨識物體時,依賴的不只是表面特徵。當你看到一個咖啡杯,你同時啟動了關於它的用途、使用情境、與其他物品的關係等一整套知識網絡。搬家時,你按尺寸分類它;整理廚房時,你把它放在其他飲用器皿旁邊。同一個杯子,在不同脈絡下,大腦的分類邏輯會自動調整。

AI的訓練邏輯截然不同。系統只需要學會「哪些像素模式對應哪個標籤」,就算完成任務。它不需要理解貓和大象在生態系統中的關係,也不需要知道停止標誌在交通情境中的意義。無毛貓的皮膚紋理在像素層面接近大象皮膚——於是,錯誤就這樣發生了。

從荒謬到危險:三個真實場景

這個「表徵錯位」在低風險場景下只是趣聞,但在高風險場景下,它的代價可能極為昂貴。

自動駕駛:一個被塗鴉或貼紙覆蓋的停止標誌,人類駕駛員憑形狀和脈絡立刻辨識。但依賴像素模式的AI可能將其誤判為廣告看板或其他路邊物件。在時速60公里的行駛中,這個判斷差異意味著什麼,不需要多加解釋。

醫療影像:研究已記錄到AI系統在分析醫療影像時,學會將圖像來源或反覆出現的技術雜訊與疾病關聯,而非學習真正的病變視覺特徵。準確率數字看起來很漂亮,但判斷依據是錯的。

對抗性攻擊:正因為AI依賴像素模式而非語意理解,攻擊者可以透過對圖像進行人眼難以察覺的微小修改,讓AI做出完全錯誤的判斷。這在資安和軍事應用領域已是不容忽視的威脅。

研究者提出的修正方向

問題已被清楚定義,解法也在探索中。一個有前景的方向是:在AI訓練過程中加入人類的相似性判斷資料。

具體做法是讓人類受試者回答「杯子更像玻璃杯還是碗?」這類問題,再將這些判斷資料納入AI訓練,引導系統學習物體之間的關係結構,而不只是標籤對應。目標是讓AI在做相似性判斷時,得出與人類相同的結論。

研究者特別強調,這與「價值對齊(value alignment)」是不同層次的問題。價值對齊討論的是AI是否追求人類想要的目標;表徵對齊討論的是AI是否以接近人類的方式理解世界。後者可能是前者的基礎,也可能是更容易量化和解決的問題。

華人科技圈的視角

這個議題對華人世界的科技發展具有特殊意涵。百度的自動駕駛、阿里巴巴的醫療AI、商湯科技的視覺辨識系統——這些已在大規模部署的應用,都面臨同樣的「表徵錯位」挑戰。

值得注意的是,中國在AI視覺辨識領域的訓練資料規模龐大,但「資料量」與「表徵對齊」是兩個不同的維度。更多資料不一定能解決AI用錯誤的特徵做出正確判斷的結構性問題。

台灣在半導體和AI硬體領域扮演關鍵角色,但在AI安全性的軟體研究上,如何在國際學術社群中建立更強的存在感,是值得思考的戰略問題。台積電的晶片跑著全球最先進的AI模型,但這些模型是否「安全」,答案並不在晶片裡。

從地緣政治角度看,AI安全性研究正在成為美中科技競爭的新戰場之一。當美國研究者發表「AI表徵錯位」的系統性研究,這不只是學術貢獻,也是在設定AI評估標準的話語權。誰定義「安全的AI」,誰就在規則制定上佔據先機。

相关文章

美國行人死亡率是加拿大3倍、挪威13倍。2025年上半年死亡人數下降11%,但仍高於疫情前水準。這不只是交通問題,而是城市設計哲學的根本抉擇。

AI能通過律師考試、設計抗癌藥物,卻無法真正「聞」到任何東西。一個被主流AI研究遺忘的感官,可能正是實現人類級別智慧的缺失拼圖。

OpenAI與Google大力宣傳的「推理模型」,其核心技術「思維鏈」早在2020年就被匿名玩家發現。AI業界的誇大宣傳背後,隱藏著什麼樣的真相?

奧斯卡導演丹尼爾·羅赫爾的新作《The AI Doc》在美國近800家影院上映,卻暴露出當代AI論述最核心的思維陷阱:非天堂即地獄的二元對立,讓我們錯過了真正重要的問題。

观点

分享你对这篇文章的看法

登录加入讨论