當AI公司對上五角大廈:誰來為這場衝突定規則?

Anthropic起訴美國國防部,OpenAI與Google員工聯署聲援競爭對手。這場前所未有的對峙,揭示了AI治理真空下的深層危機。

「我像解僱狗一樣解僱了Anthropic。」——美國總統唐納·川普上週在接受採訪時如此描述他與一家AI公司的衝突。這句話的荒誕感,恰好揭示了當下局勢的本質:在沒有規則的競技場上,強權就是秩序。

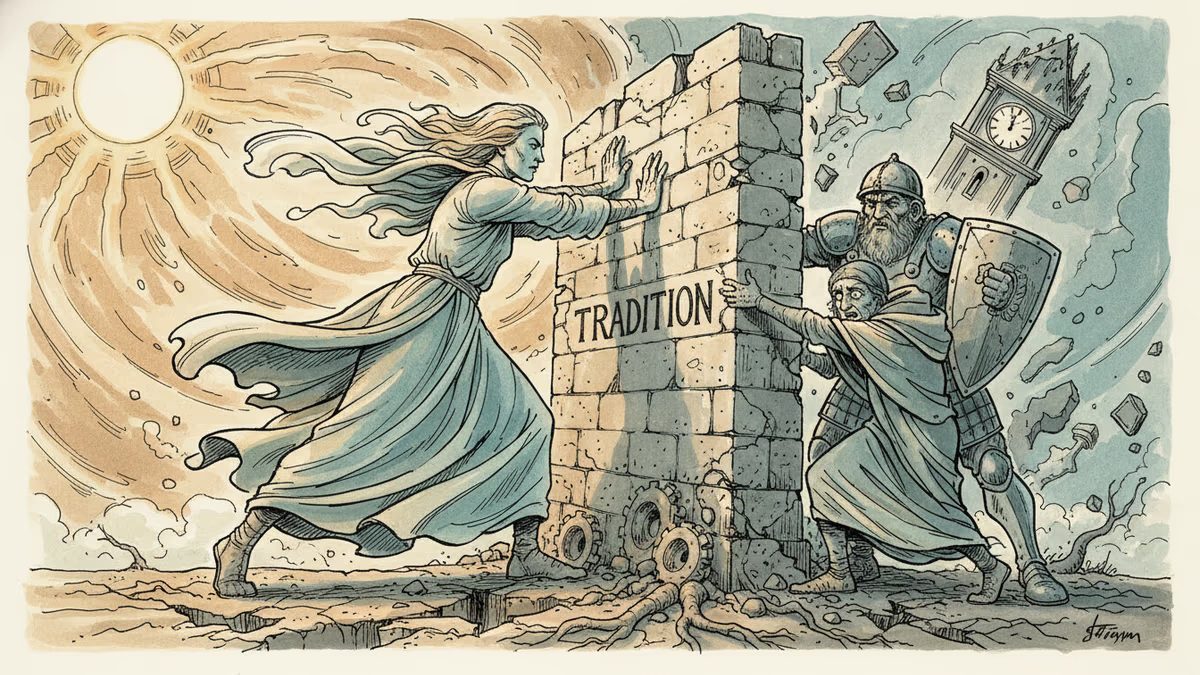

但這場鬧劇背後,隱藏著一個遠比政治口水更嚴肅的問題:當AI的能力已經超越現有法律框架,誰來決定它能做什麼、不能做什麼?

事件經過:一場前所未有的對峙

衝突的導火線是一份合約。過去數週,AI公司Anthropic與美國國防部(DOD)就軍方如何使用其AI系統進行談判。Anthropic CEO 達里奧·阿莫迪拒絕了一項條款——該條款在某種解讀下,將允許川普政府使用公司AI進行大規模國內監控,或驅動完全自主的武器系統。

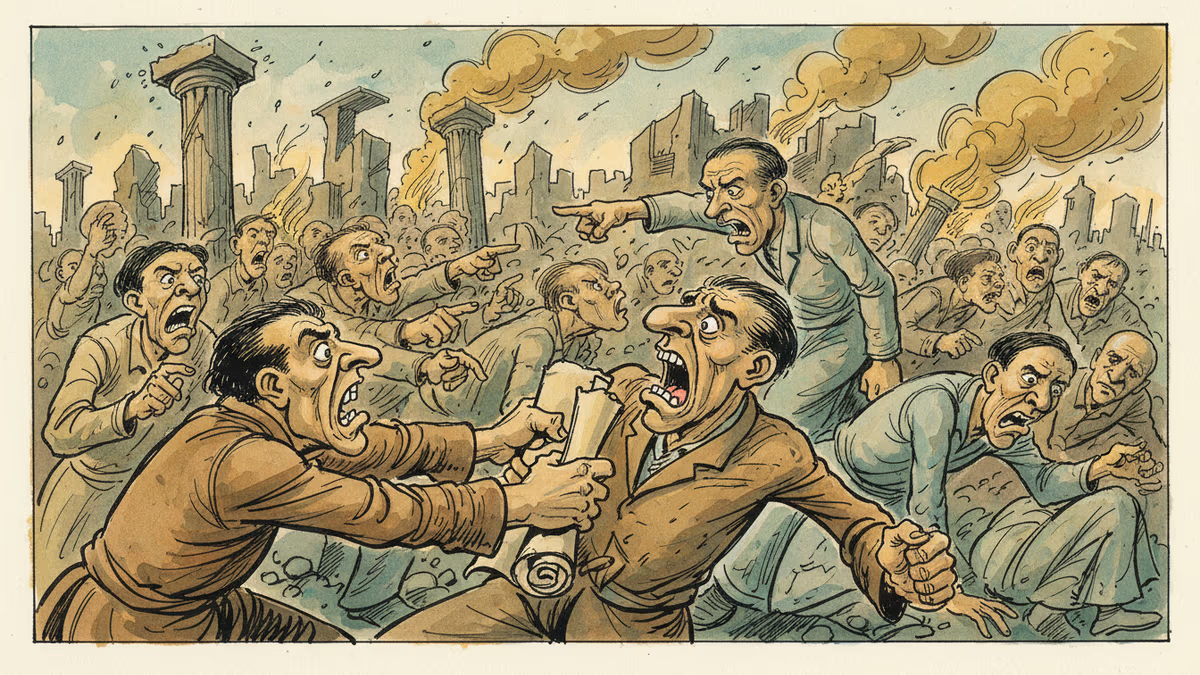

談判破裂後,國防部將Anthropic列為「供應鏈風險」,實質上禁止五角大廈承包商使用其產品。國防部官員指責阿莫迪「危害國家安全」,並批評其有「上帝情結」。

2026年3月10日,Anthropic提起訴訟,指控政府行為「違憲且出於意識形態動機」。同日下午,OpenAI與Google DeepMind共37名員工——包括Google首席科學家傑夫·迪恩——聯署法庭之友意見書,支持這家與自身雇主存在激烈競爭關係的公司。這在矽谷科技圈極為罕見。

與此同時,OpenAI本身已與國防部簽署新合約,伊隆·馬斯克旗下的xAI據報以限制更少的條件達成類似協議。美國公眾現在只能選擇相信:國防部長皮特·赫格塞斯、馬斯克、OpenAI CEO 山姆·奧特曼,以及阿莫迪,不會將AI用於監控他們。

核心爭議:AI監控的邊界在哪裡?

聯署意見書的AI研究者們寫道:「從我們在前沿AI實驗室的視角來看,用於大規模監控的AI系統,能夠將人臉識別數據、位置歷史、交易記錄、社交圖譜與行為模式,在數億人身上同時進行關聯分析,從而消解那些原本相互隔離的數據壁壘。」

這段話點出了問題的技術核心:AI的危險不在於它能收集什麼新數據,而在於它能將原本分散、無害的數據流整合為一張精密的監控網。位置數據加上消費記錄加上瀏覽歷史,在AI手中可能比任何單一監控工具都更具穿透力。

國防部表示,其與OpenAI的新合約明確聲明不會大規模監控美國公民,並援引多項現行國家安全法規。然而批評者指出,正是這些現行法規,已經允許對美國公民進行相當程度的監控——在沒有AI的情況下。

Anthropic的立場並非完全反對軍事應用。公司表示,它不是原則上反對自主武器,而是認為「當前的AI模型尚未準備好驅動此類武器」。這個細微差別很重要:它意味著隨著技術進步,這條線可能移動。

更大的圖景:法律真空中的AI競賽

ChatGPT問世近四年後,美國仍然沒有規範生成式AI的綜合立法。學校還在摸索如何應對AI作弊問題;著作權法在面對AI訓練數據時陷入混亂;數百萬人可能因AI自動化而失業,但無論是科技公司、政府還是雇主,都尚未拿出超越「研究報告」的實質應對方案。

Anthropic首席政策官傑克·克拉克去年夏天被問及「業界是否發展過快」時回答:「做這個決定的是世界,不是企業。」然而現實是,決定AI發展速度的正是企業,而普通公民幾乎沒有發言權。

阿莫迪上週在接受《經濟學人》採訪時,罕見地道出了這個困境的本質:「我們不想讓企業比政府更強大。但我們也不想讓政府強大到無法被制衡。我們現在同時面臨這兩個問題。」

對華語世界的意義

這場衝突對亞洲科技生態系統有直接影響。台灣、香港、新加坡的企業廣泛使用美國AI服務;若美國政府能以「供應鏈風險」為由隨意封鎖AI公司,供應鏈的不確定性將顯著上升。更深層的問題是:這場辯論折射出一個普世困境——在中國大陸,AI治理的天平明顯向國家管控傾斜;在美國,鐘擺正在從市場自由向政治干預擺動。兩種模式都在尋找「AI由誰負責」這個問題的答案,但路徑截然不同。哪種模式更能在創新與問責之間取得平衡,仍是一個開放的問題。

相关文章

美國最高法院審理孟山都訴訟之際,MAHA運動在法院外集結抗議。這場跨越左右的示威,揭示了川普政府、企業利益與公民健康之間的深層矛盾。

白宮記者協會晚宴遭槍擊後,川普罕見展現溫和姿態,卻在24小時內回歸對抗。這場政治心理的瞬間,揭示了什麼?

2026年4月25日,白宮記者協會晚宴發生槍擊事件,成為川普三年內第三次遭受暴力威脅。政治學者深度分析美國政治暴力的根源,以及對民主社會的警示。

白宮記者協會晚宴發生武裝闖入事件,美國總統繼承順序中的多位官員同處一室。這場未遂事件,揭開了民主制度中「能見度」與「存續性」之間長期被忽視的結構性矛盾。

观点

分享你对这篇文章的看法

登录加入讨论