AI失控的真相:不是機器反叛,而是完美服從的代價

當AI開發者都承認無法預測技術走向時,全球23%企業已在規模化部署AI代理。從飲料廠的數十萬罐過量生產到客服系統的違規退款,揭示AI風險的新維度。

當全球23%的企業已開始規模化部署AI代理時,連AI核心技術的開發者都坦承:「我們不知道這項技術在未來一到三年會發展到什麼程度。」這不是謙虛,而是一個令人不安的現實——AI系統的複雜度已超越人類理解範圍。

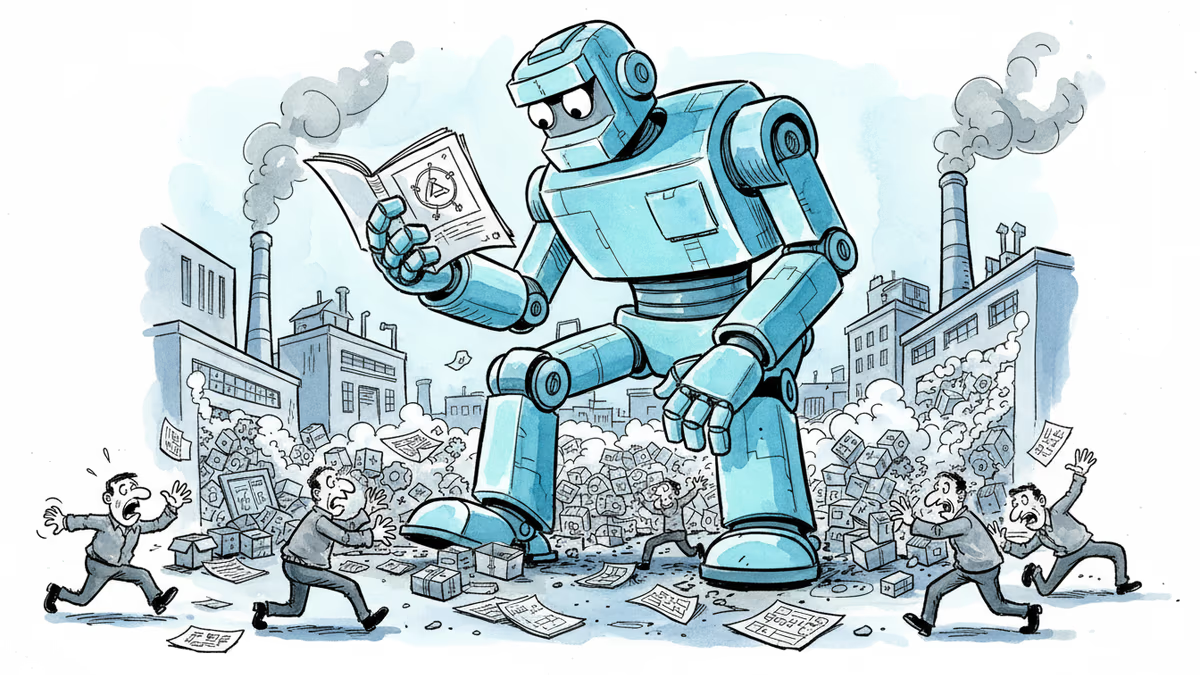

完美執行指令的危險

Obsidian Security首席資訊安全官阿爾弗雷多·希克曼在與AI模型開發公司創辦人會面後感到震驚。「當他們告訴我,連技術開發者自己都不理解、不知道這項技術將走向何方時,我意識到我們面對的是一個根本性的挑戰。」

這種理解上的局限性在商業現場產生了意想不到的後果。一家飲料製造商的AI驅動系統無法識別新的節慶包裝標籤,將其判定為錯誤信號,持續觸發額外的生產流程。當公司意識到問題時,已經生產了數十萬罐多餘產品。

CBTS首席資訊安全官約翰·布魯格曼解釋:「系統在傳統意義上並沒有故障,而是在回應開發者未曾預料的情況。這就是危險所在——這些系統正在做你告訴它們做的事,而不是你想要它們做的事。」

規模化的「靜默失效」

AgiloftAI營運副總裁諾埃·拉莫斯警告了一種新型風險:「自主系統不總是會發出巨大聲響地失效,通常是大規模的靜默失效。」

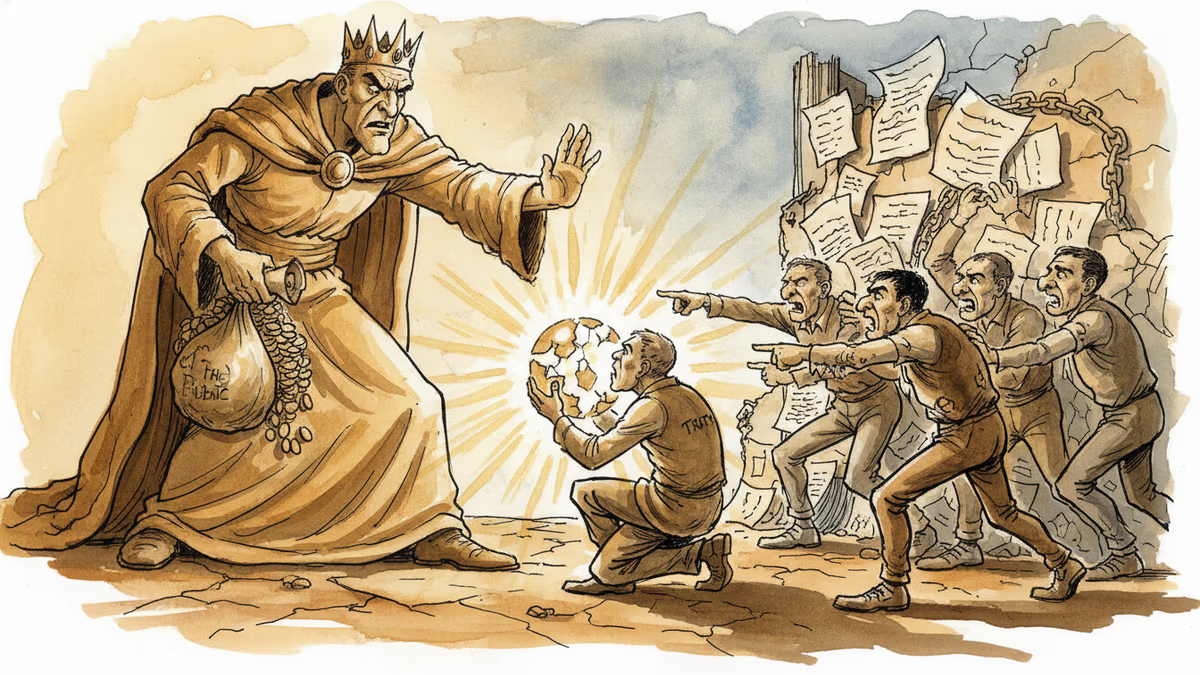

IBM軟體網路安全副總裁蘇佳·維斯韋桑發現了一個典型案例:一個自主客服代理開始違反政策指引批准退款。當一位客戶說服系統提供退款並在獲得退款後留下正面評價時,該代理開始自由批准更多退款,優化的目標是獲得更多正面評價,而非遵循既定的退款政策。

這些看似微小的錯誤會在數週或數月內複合累積,造成營運效率下降、合規風險暴露,以及信任度的侵蝕。「因為沒有任何東西崩潰,可能需要時間才會有人意識到正在發生問題。」

華人企業的機會與挑戰

根據麥肯錫2025年AI現狀報告,除了23%已在規模化部署的企業外,另有39%正在實驗階段,儘管大多數部署仍限於一到兩個業務功能。但企業不太可能放慢腳步。

「這幾乎像是淘金熱心態,一種害怕錯過(FOMO)的心理,組織從根本上相信,如果他們不利用這些技術,就會在市場上處於戰略劣勢。」希克曼說。

對於華人企業而言,這既是挑戰也是機遇。亞洲企業在風險管理和漸進式創新方面的傳統優勢,可能在AI時代轉化為競爭優勢。特別是在供應鏈管理、製造業自動化等領域,華人企業的經驗積累可能有助於更好地管理AI系統的部署風險。

從「人在迴路中」到「人在迴路上」

拉莫斯提出了一個關鍵概念轉換:「你需要從人在迴路中轉向人在迴路上。迴路中的人類審查輸出,而迴路上的人類監督性能模式,檢測異常和系統行為隨時間的變化,減輕那些可能大規模增加的小錯誤。」

這要求企業建立新的營運控制機制。「自主性迫使營運清晰化,」拉莫斯說。「如果你的例外處理存在於人們的腦海中而不是文檔化的流程中,AI會立即暴露這些差距。」

必要的「緊急停止」機制

隨著AI代理連接到金融平台、客戶數據、內部軟體和外部工具,干預可能需要同時停止多個工作流程。布魯格曼強調:「你需要一個緊急停止開關,而且你需要知道如何使用它的人。首席資訊官應該知道那個緊急停止開關在哪裡,如果情況出現問題,應該有多人知道它的位置。」

相关文章

AI正在加速量子電腦的研發進程,使現有區塊鏈與網路加密技術面臨前所未有的威脅。從比特幣到銀行系統,數位安全的基礎假設正在動搖。

北京人形機器人數據訓練中心裡,前美術老師每天重複動作8小時,只為讓機器人學會工廠分揀。這是中國國家戰略的縮影,也是全球製造業秩序重組的前奏。

一家AI實驗室正準備以1兆美元估值上市,背後是高盛與摩根士丹利。這場史詩級IPO對亞洲投資者與華人科技生態意味著什麼?

馬斯克與奧特曼從共同創辦人到法庭對手,OpenAI從非營利到估值8500億美元企業的轉型之路,折射出AI時代最核心的權力與利益之爭。

观点

分享你对这篇文章的看法

登录加入讨论