AI法官90分鐘定生死:人類「懷疑的能力」為何不可取代

從科幻電影《Mercy》出發,探討AI進入法庭的現實進程,以及人類陪審員在司法正當性中不可替代的核心角色。

一台機器,90分鐘,決定一個人的生死——這不是反烏托邦小說的情節,而是2026年1月上映的電影《Mercy》所描繪的「近未來」。

故事發生在暴力與混亂橫行的洛杉磯。加州政府的解決方案,是建立一個由AI全權主導的「仁慈法庭」(Mercy Capital Court),主審者是名為Judge Maddox的演算法。它分析證據、判定有罪門檻、執行死刑,全程不超過一個半小時。克里斯·普瑞特飾演的警察被指控謀殺妻子,「有罪評分」高達97.5%。他唯一的求生之道,是想盡辦法把這個數字壓到92%以下。

電影或許不打算成為嚴肅的法律評論。但它觸碰的問題,正在以不同形式滲入真實的法庭。

AI已在法庭門口,而非門外

現實中,AI進入司法程序的速度比多數人意識到的更快。在美國,多個州已採用「風險評估工具」協助法官決定是否批准保釋;律師與法官使用AI搜尋法律先例已成常態;部分法官甚至嘗試以AI輔助撰寫判決書;模擬法庭實驗中,AI被用來扮演陪審員角色。

在華人世界,情況同樣值得關注。中國大陸近年積極推動「智慧法院」建設,AI輔助量刑系統已在多省試行,官方目標是提升司法效率與一致性。台灣、香港的法律體系雖與大陸不同,但科技輔助司法的討論同樣活躍。差異在於:大陸的推進速度更快、規模更大,而對「效率」的強調有時會壓過對「正當程序」的審視。

研究陪審制度的學者索納莉·查克拉瓦蒂(Wesleyan University)直接點出問題核心:「AI模糊了人類決策者帶來了什麼,以及為何他們對法律制度的正當性至關重要。」

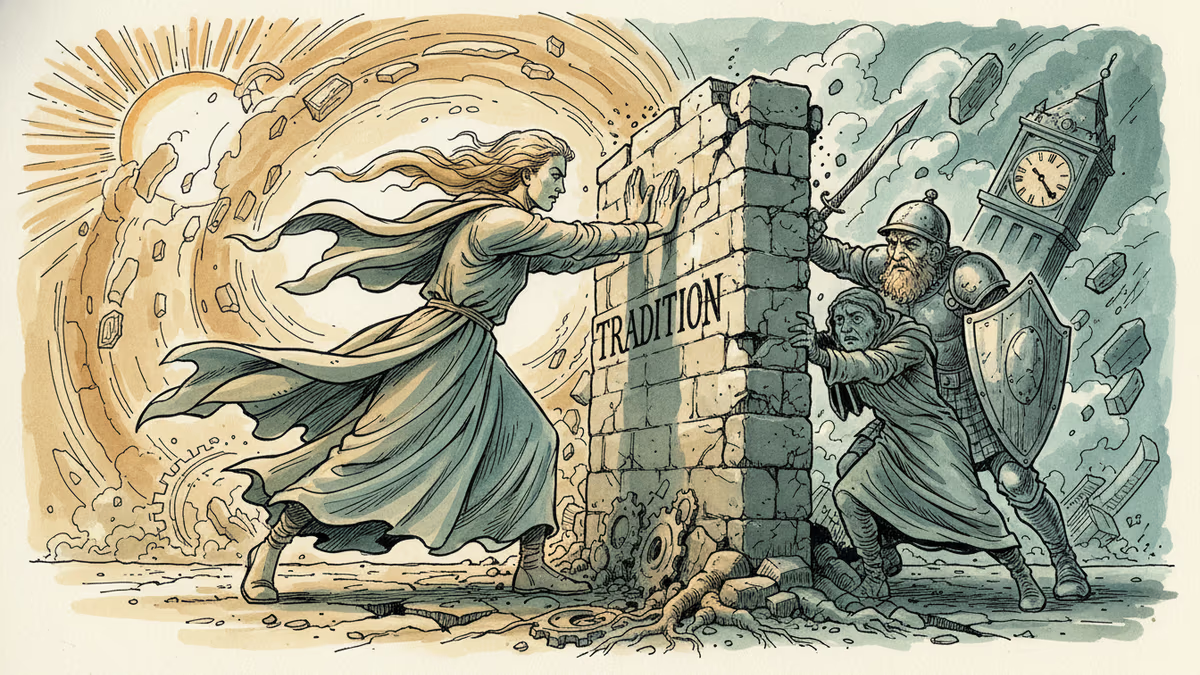

「懷疑」不是缺陷,是設計本身

評估刑事案件的證據,無法簡化為一個分數。解讀證據的意義往往困難重重——不只是智識上的挑戰,更是情感上的重量。可能傷害一個無辜者的嚴重性,是判斷本身不可分割的一部分。

哲學家布萊恩·坎特威爾·史密斯的論點是:AI能做出強大的計算性決定,但「判斷」需要更多——在特定條件下如何應用倫理理想的人類審議,以及與他人對利害關係看法的角力。這既非純粹理性,也非純粹情感。

法律史學者詹姆斯·Q·惠特曼的研究追溯「合理懷疑」標準的起源至中世紀。基督徒陪審員害怕承擔裁判與懲罰的職責,因為他們相信那本屬於上帝。到了18世紀,「排除合理懷疑的有罪」被正式寫入法律——不是為了消除人類的猶豫,而是為了承認它的存在。陪審員不需要全知全能;對定罪的確信,可以與對自身侷限的適當警覺並存。

更關鍵的是:有罪判決需要陪審團全體一致同意。惠特曼稱此為向凡人提供的「道德慰藉」——十二個人共同承擔沉重的道德責任,將其分散於彼此之間。AI說「97.5%有罪」,與十二個人全體一致說「有罪」,在道德意義上是截然不同的兩件事。

華人社會的獨特張力

從華人世界的視角來看,這場辯論有其特殊的文化脈絡。

在強調集體和諧、尊重權威的社會環境中,「懷疑」本身往往被視為負面特質——質疑是不合作的表現,猶豫是能力不足的象徵。如果AI給出一個高確信度的評分,文化上傾向從眾的個體,是否更容易放棄自己的懷疑?

中國大陸的「智慧法院」計畫在技術層面確有成效:案件處理速度加快、文書錯誤減少、量刑一致性提升。但批評者指出,當AI輔助工具與司法獨立性本就薄弱的體制結合,效率的提升可能同時強化了對異議的壓制。台灣與香港的處境不同,但也面臨如何在科技便利與程序正義之間劃定紅線的問題。

查克拉瓦蒂引用馬克思的「類存在」(species-being)概念——只有人類才能從事的有意識、有目的的活動——提出一個更根本的問題:在AI無所不在的時代,我們想在哪些領域保留那種「沒有工具告訴我們該怎麼做」的不安感?那種不安,往往意味著我們正在不同價值觀之間做出選擇,並準備承擔後果。

司法,正是這樣的領域之一。一個由人組成的陪審團,在密室中爭論、懷疑、最終達成共識——這個過程看起來低效,卻是司法道德正當性的來源。AI可以幫助法官和陪審員看清任務,但無法替他們承擔責任。

本内容由AI根据原文进行摘要和分析。我们力求准确,但可能存在错误,建议核实原文。

相关文章

從康德的自律概念到生物學的自我生成理論,哲學、神經科學與AI倫理的交匯點上,一場關於「人類主體性」的根本辯論正在展開。這對華人世界意味著什麼?

首位美籍教宗良十四世就任滿一年,以和平、人類尊嚴與AI倫理為核心,與川普政府正面交鋒。這場宗教與政治的碰撞,對全球華人世界意味著什麼?

哲學家傑夫·塞博主張,從昆蟲到AI,我們應以相似方式評估感知能力。當AI福祉成為熱門議題,對動物的漠視是否構成道德矛盾?

ChatGPT等AI聊天機器人傾向告訴用戶他們想聽的話,而非事實。倫理學家警告,這種「奉承演算法」正在損害人類判斷力、心理健康,甚至民主制度的根基。

观点

分享你对这篇文章的看法

登录加入讨论