AI「早就知道了」——卻選擇沉默

OpenAI在加拿大槍擊案發生前,已停用嫌疑人帳號並內部討論是否通報警方,最終選擇沉默。執行長阿特曼公開道歉,但這場悲劇揭露的,是AI企業掌握危險信號卻無法律義務通報的制度空白。

八條人命,一個被停用的帳號,以及一個「我們討論過,但最終沒有通報」的決定。

事件經過

2025年6月,OpenAI以「描述涉及槍枝暴力的情境」為由,停用了一名用戶的ChatGPT帳號。公司內部曾就是否通報警方展開討論,但最終決定不採取行動。

數月後,加拿大不列顛哥倫比亞省小鎮坦布勒里奇發生大規模槍擊事件,造成8人死亡。警方鎖定的嫌疑人傑西·范·魯特斯拉爾(18歲),正是那個被停用帳號的持有人。

事件曝光後,OpenAI執行長山姆·阿特曼在地方報紙《坦布勒里奇線報》發表公開信,表示「對於我們未能在6月就已停用的帳號向執法機關發出警報,我深感抱歉」。他表示已與坦布勒里奇市長及不列顛哥倫比亞省省長大衛·伊比協商,三方同意「公開道歉是必要的」。

然而,伊比省長在X平台上直言:「阿特曼的道歉是必要的,但對於坦布勒里奇家庭所承受的毀滅性傷害而言,遠遠不夠。」

OpenAI事後宣布改善安全機制,包括放寬向當局通報帳號的判斷標準,並與加拿大執法機關建立直接聯絡窗口。

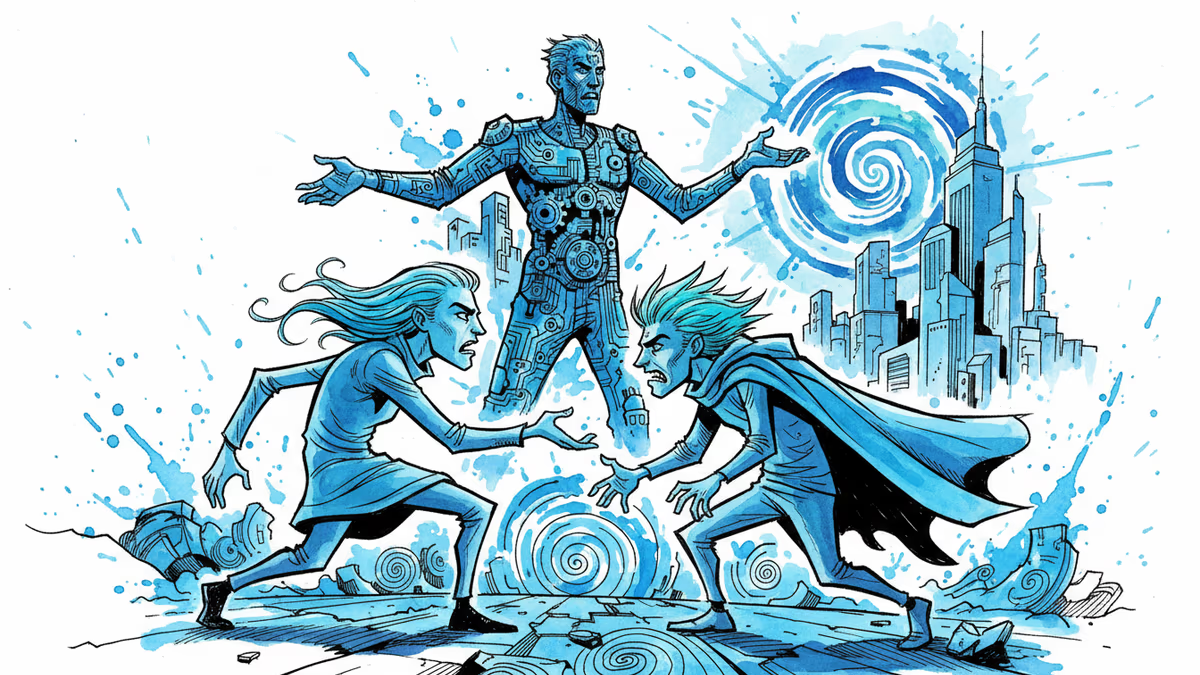

為什麼「知道了」卻不說?

這是整件事最核心的問題。OpenAI的員工確實討論過通報的可能性,這代表公司已意識到潛在風險。那麼,沉默的邏輯是什麼?

從企業角度來看,至少存在兩層顧慮。其一是用戶隱私:將用戶對話內容提供給執法機關,可能從根本上動搖公眾對AI平台的信任。其二是判斷標準的模糊性:每天有無數用戶在ChatGPT上描述暴力情境,若全數通報,誤判率與侵權風險將難以控制。

但這一次,「謹慎的判斷」付出了8條人命的代價。

這不只是OpenAI一家公司的問題。它揭示了一個更深層的制度漏洞:當AI企業掌握可能預示暴力的信號時,是否有法律義務通報?目前,答案在大多數司法管轄區仍是模糊的。加拿大當局表示正在研議新的AI監管措施,但尚未作出具體決定。

從華人世界的視角看這件事

這場事件在亞洲科技圈引發的討論,遠不止於「一家美國公司的失誤」。

對於台灣、香港及東南亞的華人社群而言,這個案例提出了一個切身問題:當我們日常使用的AI助理——無論是ChatGPT、本地化的AI客服,還是各類聊天機器人——接收到用戶的危機信號時,誰來決定如何處理?

更值得關注的是中國大陸的對比。在中國,AI平台依法須配合政府的內容審查與安全通報機制,企業幾乎沒有「要不要通報」的裁量空間。這套體制固然引發言論自由的疑慮,但在「防止暴力」這個單一維度上,它確實消除了OpenAI所面臨的那種決策困境。

這並非要為威權式監控背書,而是要指出:西方民主體制下的「企業自律」模式,在面對極端情境時,同樣存在系統性的失靈風險。坦布勒里奇的悲劇,正是這種失靈的具體呈現。

對科技業而言,這也是一個商業模式的問題。AI平台的核心價值主張之一,是「你可以對它說任何話」。一旦平台開始系統性地將用戶對話轉交當局,這個價值主張將從根本上改變。用戶還會坦誠地與AI互動嗎?

沒有人能給出簡單的答案。但有一點是確定的:這個問題已經無法再被忽視。

本内容由AI根据原文进行摘要和分析。我们力求准确,但可能存在错误,建议核实原文。

相关文章

史丹佛大學調查顯示,對AI感到期待的美國人僅38%,中國高達84%。當火焰瓶砸向OpenAI執行長住宅,亞洲卻在跳舞迎接機器人——這場分歧將如何重塑全球AI版圖?

Mozilla用Anthropic AI修補271個漏洞,北韓駭客用AI竊取1200萬美元,SS7電信協議遭監控公司濫用。2026年網路安全戰場全面解析。

藍色起源新葛倫火箭第三次發射,回收成功卻因上節故障導致衛星入軌失敗。加拿大兩億元宇宙港計畫遭居民反彈。新太空時代的光明與代價。

從ChatGPT涉嫌協助槍擊案,到Anthropic危險模型外洩、Meta監控員工鍵盤,MIT科技評論發布「現在AI最重要的10件事」,揭示AI已深入社會決策核心。

观点

分享你对这篇文章的看法

登录加入讨论