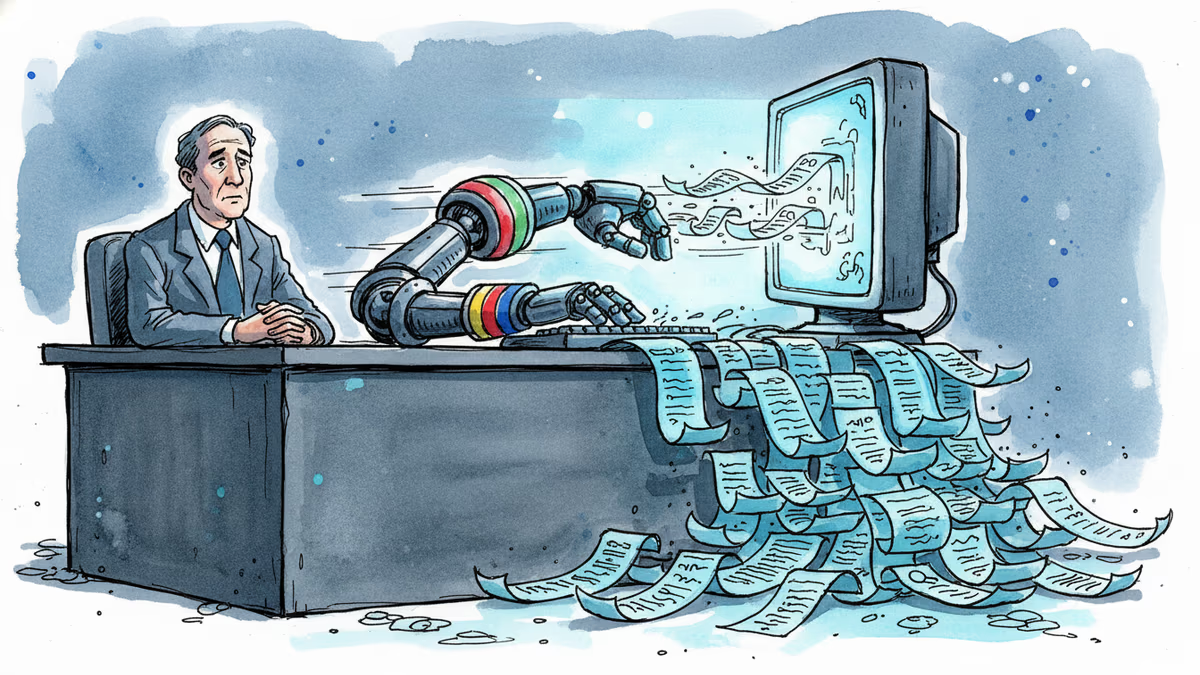

AI已經學會跑步,但企業的安全網還沒架好

2025年底至2026年初,無程式碼AI代理工具大量湧現,自主AI進入企業核心流程。當機器開始自主決策,誰來負責?亞洲企業又該如何因應這場治理危機?

一個剛學會走路的孩子,突然開始衝刺——而房間裡的安全柵欄,還沒裝好。

2025年12月至2026年1月之間,多家科技廠商同步推出「無程式碼」AI代理工具,開源個人代理程式 OpenClaw 也在GitHub上線。這標誌著生成式AI從「聊天機器人」階段,正式躍升為能夠跨系統、自主執行複雜任務的「自律代理」階段。問題不在於技術本身,而在於:當AI開始自己做決定,企業的治理框架根本還沒跟上。

「AI做的,不關我的事」——這句話已經行不通了

過去幾年,企業AI治理的核心邏輯是:在重大決策發生前,確保有人類在迴路中把關。貸款審核、招募篩選、合約簽署——這些場景都預設了「人類最終確認」的機制。AI是助手,人是決策者。

自律型AI代理打破了這個預設。代理程式可以串聯多個企業系統,在無人監督的情況下連續執行動作。從效率角度看,這正是企業想要的「機器速度運營」;但從責任角度看,這製造了一個危險的灰色地帶。

美國加州 AB 316 法案已於2026年1月1日正式生效,明確規定企業不得以「是AI做的決定」為由卸責。這個邏輯其實並不陌生——就像父母要為孩子的行為承擔法律責任一樣,企業必須為其部署的AI代理負責。

權限管理是另一個核心風險。跨系統運作的AI代理,可能在無意間獲取並行使超出單一人類用戶所能擁有的系統權限。OpenClaw 上線初期,資安專家就發現,缺乏經驗的使用者極易因此暴露於安全漏洞之中。

殭屍代理、孤兒程式,與爆表的帳單

企業AI治理面臨的挑戰,不只是「誰負責」,還有「你甚至不知道它在跑」。

一位顧問顧問近期分享了一個案例:她為客戶節省了數十萬美元,方法是找出並關閉一個被遺忘、卻仍在GPU雲端持續運行的AI試驗專案——業界稱之為「殭屍專案」。隨著員工被鼓勵自建AI工作流程,這類失控運行的代理程式數量可能以指數級增長。

更棘手的是「孤兒代理」問題:當員工轉調部門或離職,其創建的AI代理若未被妥善停用,仍可能持有企業系統的存取憑證,繼續在背景執行動作。AI代理作為企業知識產權,需要明確的「退役政策」。

成本失控同樣令人警惕。DataRobot 委託 IDC 於2025年12月進行的調查顯示,部署生成式AI的企業中有96%表示實際成本高於或遠高於預期;導入代理型AI的企業中,這一比例為92%。與傳統軟體的「按席次收費」不同,AI的使用成本隨工作流規模線性甚至非線性擴張。已有案例顯示,單一代理一次執行的Token費用高達10萬美元——遠超聘用一名初級工程師的年薪。

華人世界的視角:機會與監管的雙重壓力

對於台灣、香港及東南亞華人企業生態圈而言,這波自律AI浪潮帶來的是雙面刃。

台積電、鴻海 等製造業巨頭正積極探索AI在供應鏈與製程優化中的應用。自律型代理若能有效整合進複雜的生產排程與品管流程,潛在效益巨大。但正如本文所揭示的,缺乏內建治理機制的AI部署,可能帶來難以預測的系統性風險。

與此同時,中國大陸在AI監管上採取了與西方截然不同的路徑。國家互聯網信息辦公室(網信辦)已針對生成式AI服務發布專項管理辦法,要求服務提供者承擔內容安全責任。然而,針對自律型代理的跨系統行為監管,目前仍屬空白地帶。

東南亞市場則呈現另一種張力:數位化轉型需求旺盛,但監管基礎設施相對薄弱,企業在享受AI效率紅利的同時,治理漏洞也更難被及時察覺。

值得關注的是,在中美科技競爭的大背景下,AI治理標準本身也可能成為地緣政治博弈的場域。加州 AB 316 這類立法,是否會成為影響全球AI代理部署規範的參照點?亞洲企業又是否有能力、有意願建立自己的治理框架,而非被動跟隨西方標準?

相关文章

Google正在打造一個AI代替用戶主動搜尋的世界。當搜尋行為本身消失,資訊取得的主導權將落在誰手中?這對華人世界的科技生態與資訊環境意味著什麼?

Spotify與環球音樂集團達成生成式AI授權協議,允許用戶製作AI翻唱與混音,並與藝人分潤。這個模式能否終結AI音樂的法律混戰?對華語音樂市場意味著什麼?

梅賽德斯AMG發布新款GT四門轎跑,搭載YASA軸向磁通電機,輸出1,153馬力。本文分析這款車對亞洲豪華EV市場、中國本土品牌及供應鏈的深遠影響。

Google在I/O大會推出AI設計應用Pics,直接挑戰Canva與Anthropic的Claude Design。這場設計工具大戰,對華人中小企業與創意工作者意味著什麼?

观点

分享你对这篇文章的看法

登录加入讨论