美軍誤擊自家無人機 邊境防務自動化隱憂浮現

美軍在德州邊境誤擊海關無人機,暴露自動化防禦系統識別技術缺陷。此事件對全球軍事自動化發展帶來什麼啟示?

2月27日,美軍在德州Fort Hancock的美墨邊境,使用反無人機雷射系統誤擊了自家海關邊境保護局(CBP)的無人機。這起事故導致聯邦航空管理局(FAA)暫時關閉相關空域。

根據路透社和紐約時報報導,這已是本月第2次類似事件。2月11日,CBP在埃爾帕索國際機場附近未經協調就發射反無人機雷射,導致空域關閉數小時。

自動化的雙面刃

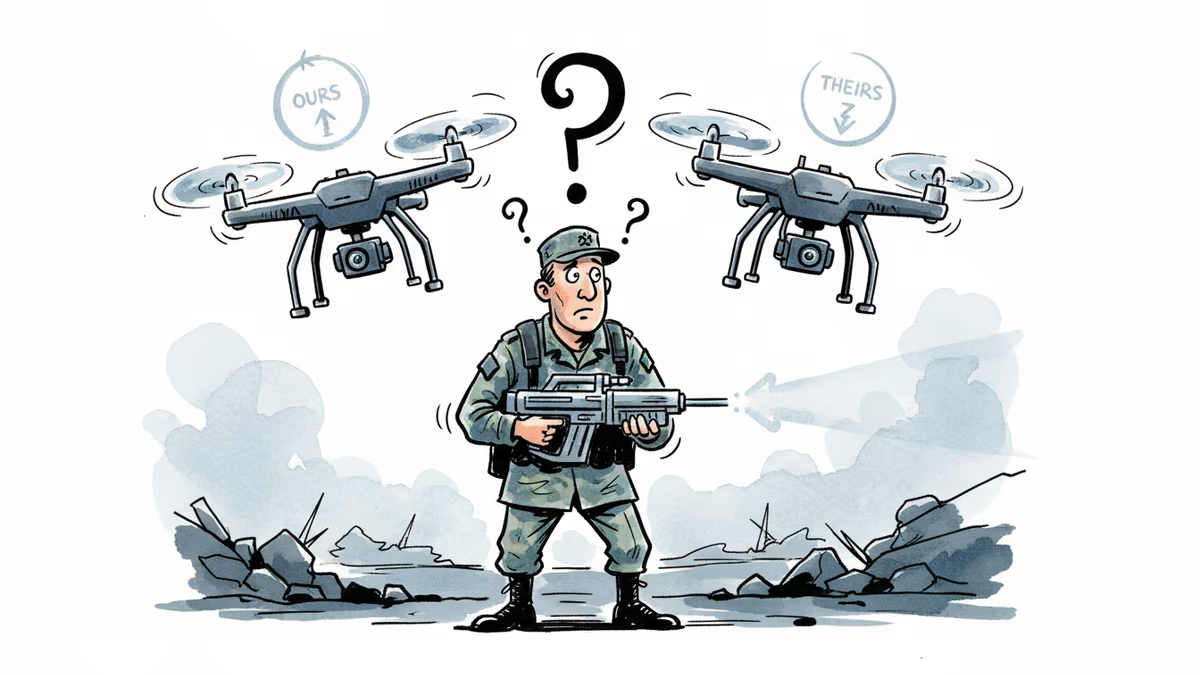

這起事故揭露了現代軍事技術發展的一個關鍵矛盾:為了應對日益複雜的威脅,各國都在推進防務系統自動化,但自動化程度越高,誤判風險也越大。

在美墨邊境這樣的複雜環境中,每天有數十架不同機構的無人機在同一空域作業。海關負責監控非法入境、軍方執行邊境防務、地方政府進行災害應對。當這些「友軍」設備在空中交錯飛行時,即時識別系統的準確性就成了生死攸關的問題。

地緣政治的新維度

這起事故也反映了一個更深層的問題:在大國競爭加劇的背景下,各國都在加速部署自動化防禦系統。中國大陸的「天網」系統、俄羅斯的Pantsir防空系統、以色列的Iron Dome,都在不同程度上採用自動化技術。

但技術競賽的背後,是對「完美識別」這個幻想的追求。現實中,任何系統都可能出現誤判,而在軍事領域,一次誤判就可能引發外交危機,甚至軍事衝突。

華人世界的思考

對台海兩岸而言,這起事故帶來的啟示尤其重要。台灣海峽是全球最複雜的軍事對峙區域之一,雙方都部署了大量自動化監控和防禦系統。在如此敏感的環境中,一次技術誤判就可能引發不可預測的後果。

香港和新加坡等國際金融中心,也越來越依賴無人機進行城市管理和安全監控。隨著大疆等中國無人機企業在全球市場的擴張,不同國家和地區的無人機系統如何實現互相識別,避免誤判,成為一個亟待解決的技術和政治問題。

人工智能的局限性

這起事故最深刻的啟示,或許是對AI萬能論的質疑。無論算法多麼先進,機器學習多麼精密,在面對複雜現實情況時,AI系統仍然會犯「人類式」的錯誤。

更重要的是,這種錯誤往往發生在最關鍵的時刻。當威脅來臨時,系統必須在毫秒級的時間內做出判斷,而這種極端時間壓力下的決策,正是AI系統最容易出錯的場景。

相关文章

SpaceX要求美軍為每架自爆無人機支付25,000美元的Starshield衛星連線費,較原本的5,000美元暴漲五倍。五角大廈最終妥協。當民間企業掌控軍事通訊基礎設施,國家安全的籌碼在誰手中?

俄羅斯逾270所大學向學生提供免學費及最高7萬美元獎金,招募無人機操控員入伍。針對遊戲玩家與理工科生的定向招募,折射出現代戰爭形態的根本轉變。

Google DeepMind倫敦總部員工以98%贊成票決議組建工會,核心訴求是阻止AI技術被用於以色列及美國軍事行動。這場抗議揭示AI產業正在撕裂的倫理斷層。

墨西哥企業Grupo Seguritech悄然建立12.7億美元監控帝國,並將觸角伸入美墨邊境。這對全球監控產業與公民隱私意味著什麼?

观点

分享你对这篇文章的看法

登录加入讨论