AI決定攻擊目標?美軍的「人機共決」走到哪裡了

美國國防部正將生成式AI用於軍事目標優先排序,ChatGPT與Grok可能進入機密作戰環境。伊朗女校遭襲事件引發全球對AI軍事倫理的深層追問。

超過100名兒童,在一所伊朗女子學校裡,因一枚飛彈喪生。美國國防部說調查仍在進行中。但就在這個時間點,一位五角大廈內部官員向外界透露了一件事:生成式AI,可能正在協助決定哪些目標應該優先被攻擊。

從「大數據」到「聊天機器人」:美軍AI的兩個世代

要理解這件事的意義,必須先搞清楚美軍AI的發展脈絡。

自2017年起,五角大廈推行一個名為「Maven計畫」的大數據專案,核心技術是電腦視覺——讓AI分析數千小時的無人機影像,自動標記潛在目標。*喬治城大學2024年的報告顯示,士兵透過地圖介面與Maven互動,目標審核的時間大幅縮短。這是第一代軍事AI:看圖識物,標記目標。

現在進入的是第二代:生成式AI。根據那位要求匿名的國防部官員描述,未來的運作模式可能是這樣的——將一份候選目標清單輸入生成式AI系統,讓它綜合考量飛機當前位置等因素,給出優先攻擊順序的建議,再由人類審核執行。

OpenAI於2月28日宣布與國防部達成協議,允許其技術用於機密環境。伊隆·馬斯克旗下的xAI也完成了類似協議,讓Grok進入五角大廈機密系統。理論上,ChatGPT和Grok未來都可能出現在這類目標選定場景中。

Anthropic的困境:道德邊界與國家機器的碰撞

目前在實際軍事行動中涉入最深的,是Anthropic的Claude。多家媒體報導指出,Claude已被整合進現有軍事AI系統,並在伊朗和委內瑞拉行動中使用。

然而,Anthropic試圖對軍方的使用方式設下限制,雙方因此產生衝突。結果是:國防部將Anthropic列為「供應鏈風險」,川普總統在社群媒體上要求政府在六個月內停止使用其產品。Anthropic目前正在法院爭取翻轉這項認定。

這個案例揭示了一個結構性矛盾:當AI公司的商業利益與政府的戰略需求相遇,誰有權決定AI的使用邊界?

「人類負責最終判斷」——這句話夠用嗎?

五角大廈官員反覆強調,AI的建議需經人類審核,最終決策由人負責。但這個說法在現實操作中面臨嚴峻挑戰。

生成式AI與Maven這類傳統AI有一個關鍵差異:Maven的地圖介面迫使士兵直接檢視原始數據,而生成式AI的輸出是流暢易讀的文字——更容易消化,也更難驗證。認知科學研究反覆證明,當人類面對AI提供的「已整理好的答案」時,批判性審視的意願會顯著下降,這就是所謂的「自動化偏誤」。

紐約時報報導,針對伊朗女校事件的初步調查顯示,「過時的目標數據」是部分原因。如果生成式AI處理了過時數據並給出了錯誤的優先排序,而人類的「審核」又流於形式——責任應該歸咎於誰?開發AI的公司?操作系統的士兵?還是批准部署的將領?

華人世界的視角:這不只是美國的問題

對於台灣、香港及東南亞的讀者而言,這則新聞有著特殊的地緣政治意涵。

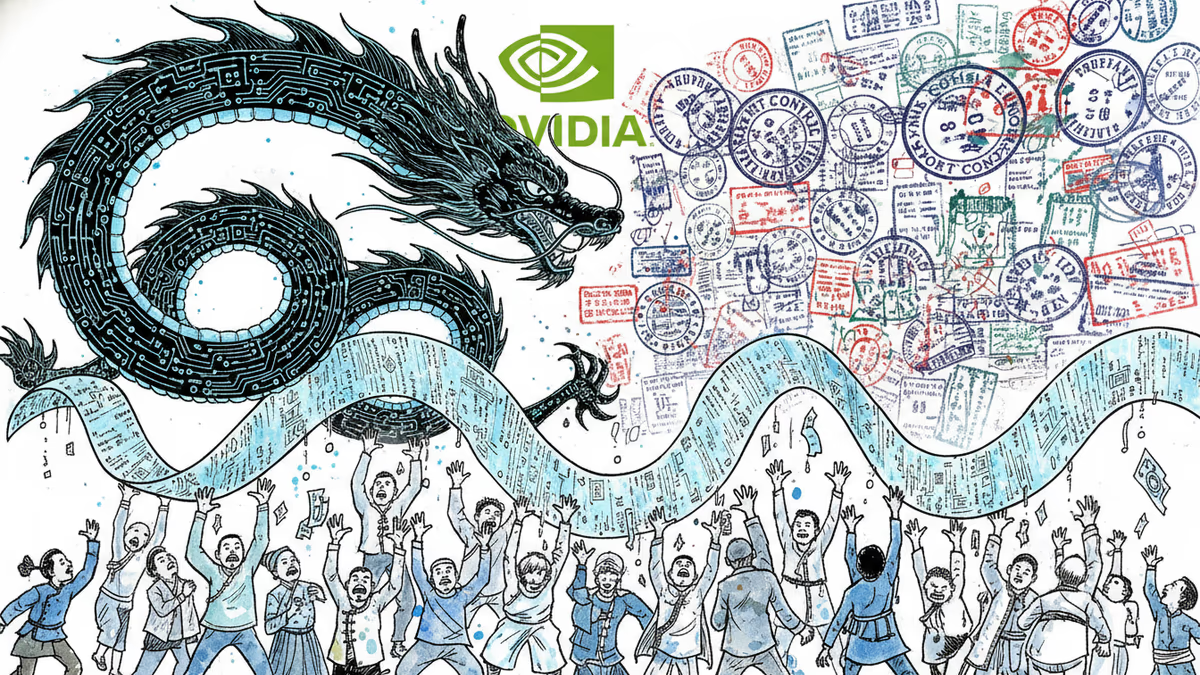

首先是技術擴散的現實。美軍正在加速將生成式AI整合進作戰決策鏈,中國人民解放軍也在平行推進類似計畫。當兩個超級大國都在競相縮短「從偵測到決策」的時間窗口,台海或南海的危機管理空間將面臨前所未有的壓縮。

其次是供應鏈的隱憂。OpenAI、xAI與五角大廈的合作,意味著這些平台的技術路線圖將越來越受到軍事需求的影響。對於依賴這些工具進行商業應用的亞洲企業而言,使用條款和數據安全的不確定性正在上升。

第三是規範真空的問題。目前國際社會對「自主武器系統」的討論已延續多年,但針對生成式AI輔助目標選定這種「半自主」模式,幾乎不存在任何有效的國際規範。聯合國的相關談判進展緩慢,而技術部署的速度遠超過規則制定的速度。

速度與準確之間:一個沒有標準答案的取捨

支持者的邏輯是:AI能更快速地處理海量情報,減少人類在時間壓力下的認知錯誤,最終可能讓決策更精準、附帶傷亡更少。這個論點並非毫無道理。

反對者的擔憂是:速度本身就是風險。當AI將「決策時間縮短」設為優化目標,整個系統的設計邏輯就是鼓勵更快行動——而不是更審慎地思考。伊朗女校的悲劇,可能正是這種邏輯的代價。

五角大廈官員在被問及「人類審核所需時間」時,刻意迴避了具體數字。這個迴避本身,或許就說明了一切。

相关文章

馬斯克起訴OpenAI與奧特曼,指控其背棄非營利使命。這場官司不只是億萬富翁的恩怨,更可能重塑全球AI發展格局,對華人世界影響深遠。

白宮記者晚宴發生武裝闖入事件,川普總統與多名閣員緊急撤離後數小時,隨即召開記者會,將此事件與其白宮擴建計畫掛鉤,引發廣泛爭議。

美國太空軍公布12家黃金穹頂太空攔截器開發商,涵蓋SpaceX、洛克希德馬丁等巨頭。這場太空軍備競賽對亞太地區、台灣海峽及中美關係意味著什麼?

DeepSeek發布V4旗艦模型,性能比肩GPT-5與Claude,價格卻低十倍以上。華為昇騰晶片首度整合,中國AI「去Nvidia化」邁出關鍵一步,對華人世界意味著什麼?

观点

分享你对这篇文章的看法

登录加入讨论