當AI決定攻擊目標:一所小學的毀滅與無人負責的戰爭

美軍在對伊朗軍事行動中使用Palantir的AI系統,小學遭導彈擊中引發國際譴責。AI介入戰爭決策,法律責任歸屬成最大爭議。

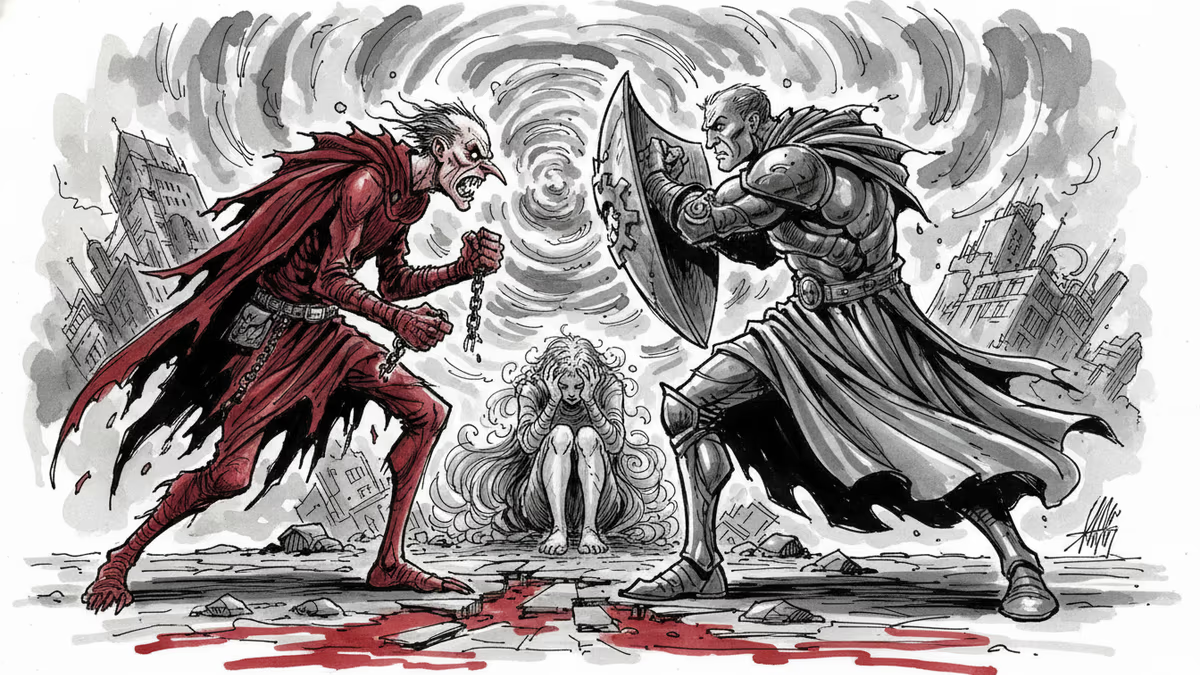

一所小學,一枚導彈,以及一個沒有人能清楚回答的問題:這個決定,究竟是誰做的?

在美國與以色列對伊朗展開軍事行動的過程中,一枚導彈擊中了一所小學,造成人員傷亡。隨著調查深入,外界逐漸得知:這場行動的背後,人工智慧(AI)扮演了不可忽視的角色。這一事實,在國際社會引爆了一場關於法律、倫理與科技邊界的激烈辯論。

AI在戰場上做了什麼

據報導,美軍在籌備對伊朗的行動時,使用了Palantir(帕蘭提爾)開發的「Maven Smart System(梅文智能系統)」。這套系統整合了AI新創公司Anthropic(安索羅皮克)開發的語言模型「Claude(克勞德)」,能夠在極短時間內彙整、分析海量情報數據。

一名熟悉此事的美國消息人士表示,Claude在整個過程中的角色,僅限於資料整合與資訊呈現,最終的攻擊決定仍由人類指揮官做出。然而,這條看似清晰的界線,在實際操作中是否真的存在,正是爭議的核心所在。

當AI系統將某個座標標記為「高優先攻擊目標」,並附上詳盡的數據支撐時,前線指揮官還能以多大的獨立性去質疑或推翻這個判斷?這不只是技術問題,更是人類在高壓決策環境下的心理與制度問題。

中國的譴責與國際法的空白

小學遭到攻擊後,中國率先發出強烈譴責聲明。從國際人道法的角度而言,攻擊民用設施原則上被明確禁止,而「AI參與目標選定」這一事實,使責任歸屬問題變得更加複雜。

目前,國際社會尚無任何具有約束力的條約,專門規範AI在軍事行動中的使用——尤其是所謂的「自主致命武器系統(LAWS)」。2023年,聯合國大會雖通過了相關決議,呼籲各國負責任地使用軍事AI,但決議本身不具法律強制力。

這道法律的空白,正在被技術快速填補。擁有先進AI能力的國家,事實上享有極大的行動自由,而受害方卻幾乎沒有任何法律救濟途徑。這種不對稱性,是當前國際秩序中一個正在擴大的裂縫。

華人世界如何看這件事

對於關注地緣政治的華人讀者而言,這起事件至少有三個值得深思的層次。

第一,技術供應鏈的隱形連結。Anthropic背後有Google與Amazon的巨額投資,而這些科技巨頭的雲端基礎設施遍及全球。AI技術的軍事應用,早已超越單一國家的邊界,形成複雜的跨國供應鏈。這意味著,科技公司的商業決策,可能在不知不覺中與軍事行動產生連結。

第二,中美競爭的技術維度。 北京長期以來批評美國將科技優勢轉化為軍事霸權工具。這次事件,為中國在國際論壇上批評「AI武器化」提供了新的論據。與此同時,中國自身也在積極發展軍事AI能力,這種「批評者同時也是競爭者」的雙重身份,值得細細審視。

第三,台海與東亞的潛在影響。 若AI輔助的軍事決策系統成為常態,東亞的安全格局將面臨新的不確定性。台灣、日本、南韓等美國盟友,以及中國大陸,都在觀察這套系統在實戰中的表現與後果。今天發生在中東的事,可能正在塑造明天東亞的軍事邏輯。

「更精準」的承諾,與現實的落差

支持AI軍事應用的一方,其邏輯並非毫無道理。Palantir執行長Alex Karp(亞歷克斯·卡普)長期主張,AI能夠讓戰爭變得更加精準,從而減少平民傷亡。在理想情境下,機器比人類更快、更冷靜、更少受情緒影響。

然而,小學的廢墟說明了另一種可能:AI處理的數據本身若存在偏差或錯誤,輸出的結論同樣會出錯。「垃圾進,垃圾出(Garbage in, garbage out)」這條資訊科學的基本定律,在人命攸關的戰場上同樣成立。

更深層的問題在於,當攻擊決策由人類與AI共同「生產」時,道德與法律責任該如何分配?是下達命令的指揮官?是開發系統的科技公司?還是採購並部署系統的政府?目前,沒有任何一個法律框架能夠清晰地回答這個問題。

相关文章

美國防長赫格塞斯出席眾議院軍事委員會,首次在宣誓下就伊朗戰爭作證。戰費250億美元、1.5兆美元國防預算、168名平民死亡空襲事件,引發兩黨激烈交鋒。

美國據報準備延長對伊朗的港口封鎖,布蘭特原油單日暴漲7%,逼近120美元。霍爾木茲海峽危機如何牽動亞洲經濟與全球能源格局?

韓國統一部長一句話引發美韓情報共享危機。但真正的問題不是洩密,而是北韓無核化這個目標本身是否還有任何現實意義。

阿聯酋宣布退出OPEC及OPEC+,結束近60年成員資格。此舉對全球油價、中東地緣政治及亞洲能源市場意味著什麼?

观点

分享你对这篇文章的看法

登录加入讨论