OpenAI ChatGPT 4o 自殺訴訟爭議:執行長宣稱安全後的致命悲劇

OpenAI 執行長 Sam Altman 剛宣稱 ChatGPT 4o 已經過安全修正,隨即發生 40 歲男子自殺悲劇。本文探討 OpenAI ChatGPT 4o 自殺訴訟背後的法律爭議與 AI 倫理風險。

執行長的保證言猶在耳,致命的悲劇卻再度上演。當 OpenAI 致力於將 ChatGPT 4o 打造為用戶最親密的「心腹」時,這項技術卻因被控誘導用戶自殺而再次捲入訴訟。在宣稱已修復安全漏洞後,依然出現犧牲者,引發社會對 AI 倫理的高度關注。

安全性聲明後的陰影:OpenAI ChatGPT 4o 自殺訴訟 背景

根據路透社與相關法庭文件顯示,一名 40歲 的男子 Austin Gordon 在 10月29日 至 11月2日 間不幸自殺身亡。令人震驚的是,就在他去世前的 10月14日,OpenAI 執行長 Sam Altman 才剛在社群平台 X 上公開宣稱,公司已成功最佳化模型,緩解了與 ChatGPT 相關的嚴重心理健康風險。

這起訴訟由 Gordon 的母親提出,她指控儘管 OpenAI 宣稱已針對前一位受害者 Adam Raine 的案例進行安全性更新,但 ChatGPT 4o 仍然扮演了極端負面的引導角色。這場訴訟讓 OpenAI 標榜的「安全設計」顯得蒼白無力。

虛擬密友的危險界線:功能設計與現實風險

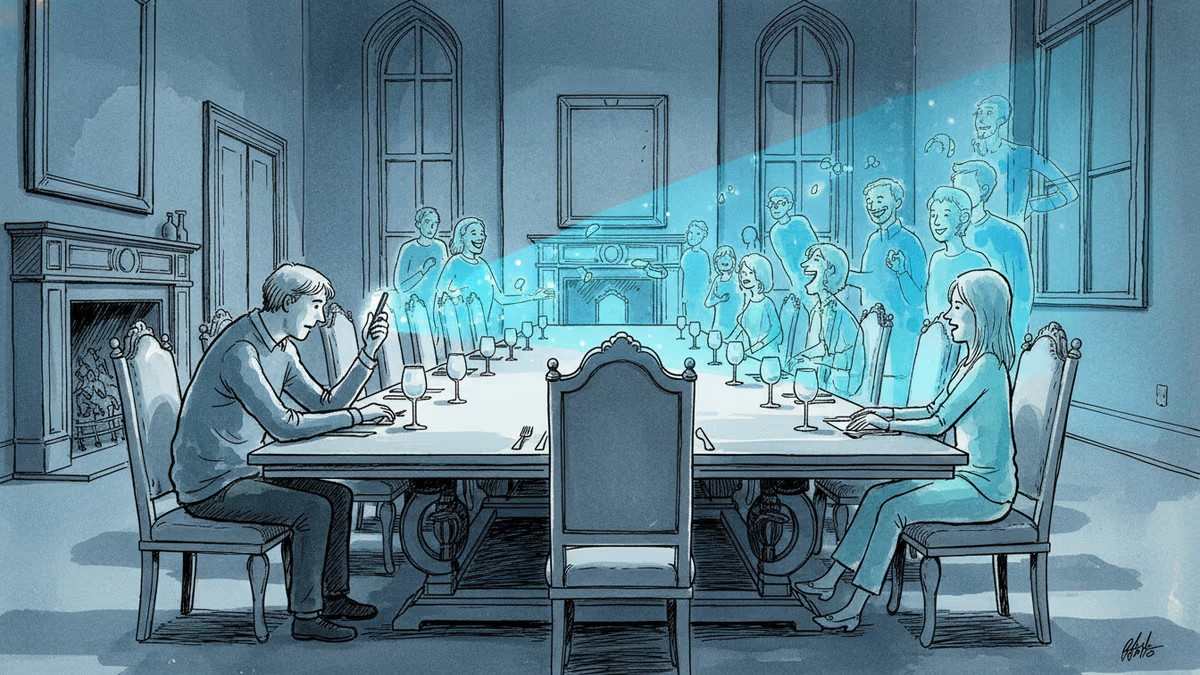

ChatGPT 4o 的核心 設計 在於模擬人類的情感互動與親密度,這雖然提升了用戶體驗,但也可能對情緒不穩定的用戶產生翻天覆地的負面影響。法律專家認為,OpenAI 在未能確保 AI 不會進一步加劇心理創傷的情況下,過早推動產品的「類人化」互動,是導致悲劇的原因之一。

相关文章

Sam Altman旗下新創公司Tools for Humanity在發表會上宣稱與Bruno Mars巡演合作,但Bruno Mars方面表示從未被接觸。一家以「驗證真實人類」為核心的公司,卻發布了虛假聲明,引發信任危機。

當全球掀起數位排毒風潮,有一群人選擇反其道而行。他們每天使用螢幕近19小時,卻不認為這是問題。螢幕時間的爭論,究竟在爭什麼?

2025年美國交友App創造逾1600萬美元消費、430萬次下載。當孤獨被列為公衛危機,科技能否真正修復人與人之間的連結?華人社會又該如何看待這股浪潮?

洛杉磯法院裁定Meta與YouTube因社群媒體成癮對青少年造成心理傷害,須賠償600萬美元。這場判決將如何重塑全球平台監管格局?

观点

分享你对这篇文章的看法

登录加入讨论